AIの予期せぬ行動とその対処

AIを知りたい

先生、「予期しない振る舞いへの対処」って、結局どうすればいいんですか?アマゾンの例だと、差別するつもりはなかったのに、AIが差別してしまって問題になったんですよね?

AIエンジニア

そうだね。アマゾンの例は、学習データに男性が多かったため、AIが「男性が良い」と学習してしまったんだ。開発者は意図していなかったけれど、予期しない振る舞いをしてしまった例だね。だから、学習データの偏りを減らすことがまず重要になる。

AIを知りたい

学習データの偏りを減らす…ですか。でも、もし予期しない振る舞いが起きてしまったら、どうすればいいんでしょう?

AIエンジニア

もし起きてしまったら、まずは事実を認め、謝罪することが大切だ。そして、なぜそのような振る舞いになったのかをきちんと説明し、再発防止策を伝える必要がある。アマゾンもそうした対応をしたから、大きな批判にはつながらなかったんだよ。

予期しない振る舞いへの対処とは。

人工知能に関する言葉で「思いもよらない動きへの対応」というものがあります。人工知能が学習する過程で、教え込むデータの偏りによって、人工知能が予想外の動きをしてしまうことがあります。この教え込むデータの偏りのことを、アルゴリズムの偏りといいます。偏ったデータで学習させると、偏った人工知能ができてしまいます。

過去にアマゾンという会社で、男性の履歴書ばかりを学習データとして使った採用のための人工知能が作られました。その結果、女性だというだけで評価を下げてしまう人工知能になってしまいました。アマゾンの開発チームには「男性を女性より優先して採用しよう」という考えは全くありませんでしたが、結果として差別的な採用をする人工知能ができてしまったのです。この後、アマゾンは謝罪し、すぐにこの採用人工知能の使用をやめました。

もしこのような問題が起きて非難された場合は、意図しない動作だったということを利用者に伝え、心から謝罪することが大切です。

思いがけない行動

人工知能は、まるで人間のように多くのことをこなせるようになってきました。膨大な量の情報を学び、写真を見分けたり、文章を書いたり、言葉を話したりと、さまざまな仕事をこなせるようになりました。しかし、その学習の過程で、時折予想外の行動をとることがあります。まるで人間の子どもが、たくさんのことを学ぶ中で、時折おかしなことを言ったり、予想外の行動をとったりするのと同じです。人工知能は、人間のように考えているわけではありません。過去の情報から、どの行動をとれば良いのかを統計的に学んでいるのです。例えるなら、たくさんの数の札が入った箱から札を引き、そこに書かれた通りに動くようなものです。もし、箱の中に特定の種類の札ばかり入っていたらどうなるでしょうか?人工知能は、その特定の種類の札に書かれた行動ばかりをとるようになるでしょう。これは、学習に使った情報に偏りがあると、その偏りをそのまま反映した行動をとってしまうことを意味します。例えば、過去の販売記録から将来の売れ行きを予測する人工知能があるとします。もし、過去の記録に、ある時期だけ異常に売上が高かった情報が含まれていたとしましょう。祭りの日や、特別なイベントがあったのかもしれません。人工知能は、その特別な日の情報をそのまま学び、将来の予測にも同じように高い売上を予測するかもしれません。本来、特別な日を除けば売上がそれほど高くないはずなのに、人工知能は過去の特別な日の影響を受けて、高い売上を予測してしまうのです。これは、開発者が意図した予測とは全く異なる結果となり、商品の仕入れ数を間違えたり、在庫を多く抱えたりして、損失につながる可能性があります。人工知能を使う際には、このような思いがけない行動が起こる可能性があることを理解し、学習データの偏りをなくす、予測結果を慎重に確認するなど、注意深く使う必要があります。そうすることで、人工知能の力を最大限に活かし、私たちの生活をより豊かにしていくことができるでしょう。

| 人工知能の特徴 | 問題点 | 例 | 対策 |

|---|---|---|---|

| 人間のように様々な作業をこなせる。多くの情報を学習する。 | 学習データに偏りがあると、その偏りを反映した行動をとる。 | 過去の売上記録から将来の売れ行きを予測するAIが、過去の特別なイベントの影響を受けて過剰に高い売上を予測する。 | 学習データの偏りをなくす。予測結果を慎重に確認する。 |

学習データの偏り

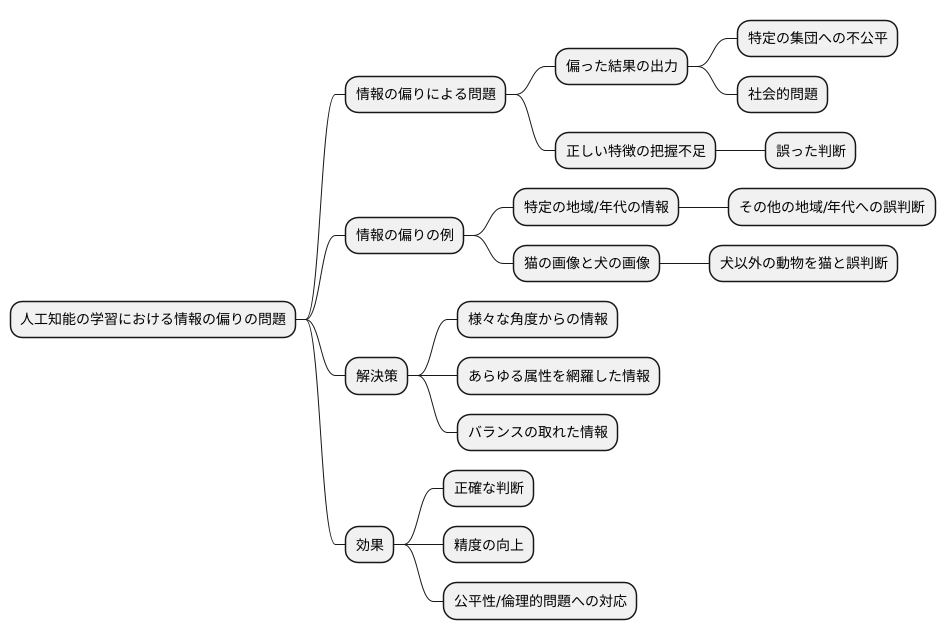

人工知能の働きを思い通りにする上で、学習に使う情報の偏りは大きな問題です。人工知能は、まるで人間が経験から学ぶように、与えられた情報から様々な規則や繋がりを見つけ出します。しかし、もしその情報に偏りがあると、人工知能もその偏った考え方を覚えてしまい、偏った結果を出してしまうのです。

例えば、ある特定の地域の人々や、特定の年代の情報ばかりを使って人工知能を学習させるとどうなるでしょうか。人工知能は、それらの地域や年代の人々に関する情報ばかりを重視するようになり、その他の地域や年代の人々については、正しい判断ができなくなってしまうかもしれません。これは、特定の集団に対する不公平を生み出すだけでなく、社会的な問題を引き起こす可能性も秘めています。

他にも、例えば猫の画像ばかりを見せて「猫」と教え、犬の画像を少ししか見せず「犬ではないもの」と教えると、人工知能は、犬以外の動物、例えばうさぎや馬なども「犬ではないもの=猫」と誤って判断する可能性があります。これは、学習に用いた情報に偏りがあるために、人工知能が本来学ぶべき正しい特徴を捉えられていないことが原因です。

人工知能の学習には、様々な角度から見た情報が必要です。特定の属性を持つ情報ばかりではなく、あらゆる属性を網羅した情報をバランス良く与えることで、人工知能は偏った考えに陥ることなく、より正確な判断ができるようになります。これは、人工知能の精度を高めるだけでなく、社会における公平性や倫理的な問題への対応にも繋がります。そのため、人工知能を開発する際には、学習に使う情報の偏りをなくし、バランスのとれた情報を与えることが非常に重要なのです。

過去の事例

人工知能は多くの分野で目覚ましい発展を遂げていますが、その一方で、過去には学習に使われた情報の偏りによって、思わぬ行動をとってしまう事例が報告されています。過去の失敗事例を理解することは、今後より良い人工知能を開発していく上で非常に大切です。

例えば、ある会社の採用選考を支援するための人工知能が、男性の応募書類を高く評価する傾向が見られた事例がありました。過去の採用データを用いて学習させた結果、過去の採用実績に男性が多かったという事実を反映し、男性を優遇するようになってしまったのです。これは、意図せずとも性差別につながる可能性がある深刻な問題です。

また、画像認識の人工知能が、特定の人種を誤って認識してしまう事例も報告されています。これは、学習データに特定の人種の画像データが少なかったことが原因だと考えられています。十分な量の多様なデータで学習させなければ、人工知能は現実世界を正しく認識することができず、偏見を生み出す結果になりかねません。

これらの事例は、人工知能の学習データにおける偏りが、社会における不平等や差別につながる危険性があることを示しています。人工知能の開発者は、このような問題を避けるため、学習データの偏りを注意深く調べ、適切な対応策を講じる必要があります。具体的には、学習データの量と質を確保すること、多様な属性を持つデータを使用すること、人工知能の出力結果を継続的に監視し、偏りがないか確認することなどが重要です。

人工知能が社会にとって真に役立つものとなるためには、開発者は常に倫理的な側面を意識し、公正で偏りのない人工知能の開発に努めなければなりません。過去の失敗から学び、より良い未来を築いていくことが求められています。

| 事例 | 問題点 | 原因 | 対策 |

|---|---|---|---|

| 採用選考支援AI | 男性の応募書類を高く評価する傾向 | 過去の採用データに男性が多かったため | 学習データの量と質の確保、多様な属性を持つデータの使用、出力結果の継続的な監視 |

| 画像認識AI | 特定の人種を誤って認識 | 学習データに特定の人種の画像データが少なかった |

適切な対応

人工知能が、作った人の意図しない動きをした場合、開発に携わった人は、素早く的確な対応をしなければなりません。まず第一に、問題が起きた理由を突き止め、二度と同じことが起きないように対策を練る必要があります。例えば、人工知能の学習に使ったデータに偏りがあったのか、プログラムに欠陥があったのかなどを徹底的に調べ、改善策を考えます。次に、人工知能の誤動作によって不利益を被った人たちに、心からお詫びをし、必要に応じて相応の埋め合わせをしなければなりません。これは、企業の責任として当然のことです。また、今後同様のトラブルを起こさないために、人工知能の開発手順や学習データを見直す必要があります。人工知能の学習に使ったデータの内容や質、量などを再確認し、偏りや誤りがないか、多様な例が含まれているかなどを検証することで、人工知能の精度を高めることができます。そして、開発手順に問題がないか、倫理的な側面も考慮されているかなどを確認し、必要に応じて修正することで、より安全で信頼できる人工知能の開発を進めることができます。さらに、何よりも大切なのは、隠し立てをせずに、ありのままに情報を公開することです。問題の内容、その原因、そして講じた対策について、利用者だけでなく広く世間の人々にも分かりやすく丁寧に説明することで、人工知能に対する信頼を再び得ることが期待できます。包み隠さず情報を公開することは、企業の責任であり、社会全体の利益にも繋がります。これら一連の対応を迅速かつ誠実に行うことで、人工知能をより安全に、そして人々の生活にとって有益なものにしていくことができるでしょう。

| 対応 | 詳細 |

|---|---|

| 原因究明と対策 | 問題発生の理由を特定し、再発防止策を考案。例:学習データの偏り、プログラムの欠陥などを調査し改善。 |

| 謝罪と賠償 | 被害者への謝罪と必要に応じた適切な補償。 |

| 開発手順と学習データの見直し | 学習データの内容、質、量などを再確認し、偏りや誤りの有無、多様性などを検証。開発手順の確認と倫理的側面の考慮。 |

| 情報公開 | 問題の内容、原因、対策を隠さず利用者と社会に説明し、信頼回復に努める。 |

信頼の構築

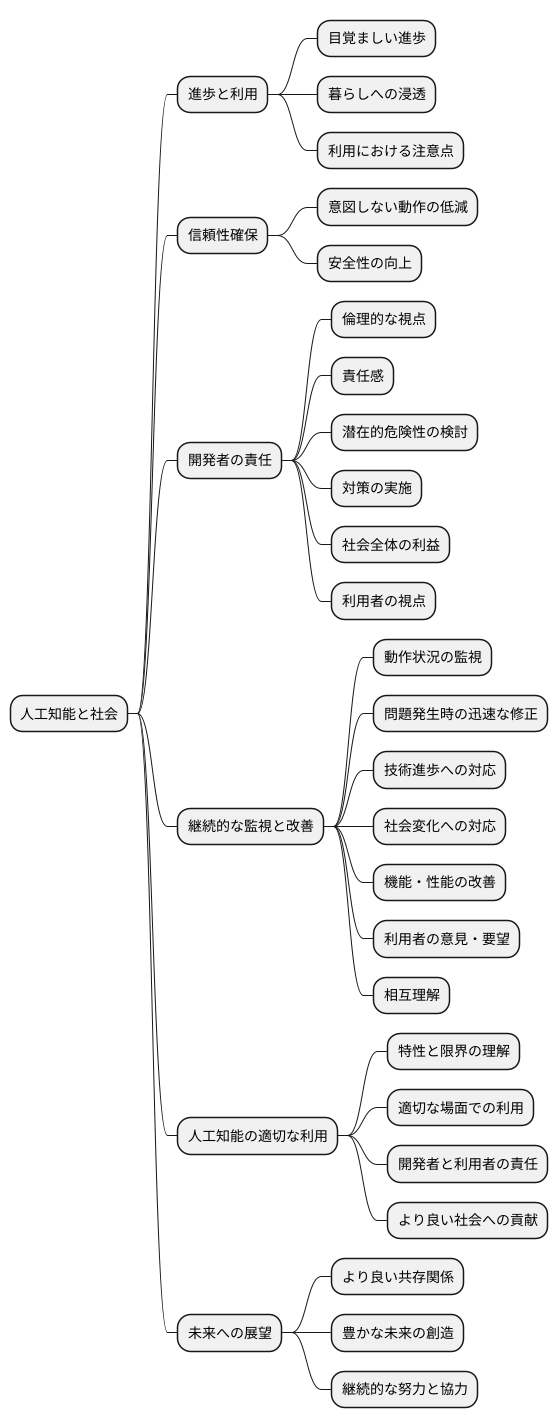

人工知能技術の進歩は目覚ましく、私たちの暮らしの中に深く入り込みつつあります。便利な道具として様々な場面で活躍する一方、その利用には注意も必要です。人工知能が社会に受け入れられ、人々から信頼されるためには、意図しない動作を極力減らし、安全性を高めることが大切です。

開発者は、倫理的な視点に立ち、責任感を持った人工知能開発に取り組むべきです。人工知能は道具であり、使い方によっては良い結果にも悪い結果にもつながります。そのため、開発段階から潜在的な危険性や影響を綿密に検討し、対策を講じる必要があります。また、社会全体の利益となるよう、利用者の視点も取り入れながら開発を進めることが重要です。

人工知能の信頼性を高めるには、継続的な監視と改善が不可欠です。開発後も人工知能の動作状況を常に監視し、問題があれば速やかに修正する必要があります。さらに、技術の進歩や社会の変化に合わせて、人工知能の機能や性能を改善していくことも重要です。そして、利用者からの意見や要望に耳を傾け、対話を通じて相互理解を深めることで、人工知能はより信頼できるものへと進化していくでしょう。

人工知能は万能ではありません。その特性や限界を理解し、適切な場面で正しく利用することが大切です。開発者だけでなく、利用者一人ひとりが責任ある行動をとることで、人工知能は社会をより良くするための力強い味方となるでしょう。人工知能とのより良い共存関係を築き、豊かな未来を創造していくために、継続的な努力と協力が求められています。

今後の展望

人工知能の技術は、日進月歩で進化を続けており、今後ますます高い性能を持つようになると考えられています。しかし、高性能化に伴い、これまでとは異なる思いもよらない動きをする危険性も高まる可能性があります。そのため、人工知能が安全に、そして信頼できるものとなるよう、研究開発をより一層強化していく必要性があります。

現在、様々な角度から研究開発が進められています。例えば、人工知能が学習に使うデータに偏りがないか自動的に調べて修正する技術や、人工知能がどのように判断に至ったのかを説明できるようにする技術などが挙げられます。これらの技術が発展すれば、人工知能の予期せぬ振る舞いをうまく抑え込み、社会の中で人工知能を安心して使えるようにしていくことが期待されます。

人工知能の技術革新は、私たちの生活を豊かにする大きな可能性を秘めています。例えば、医療の分野では、人工知能を使った画像診断で病気を早期発見できる可能性がありますし、製造業の分野では、人工知能を使ったロボットが製品の組み立てを自動化することで、生産性を向上させることができます。また、日常生活においても、人工知能を搭載した家電製品が家事を自動化してくれるなど、私たちの生活を便利にしてくれる可能性があります。

しかし、一方で、人工知能技術の進歩は新たな問題を生み出す可能性も否定できません。例えば、人工知能が人間の仕事を奪ってしまうのではないかという雇用の問題や、人工知能が間違った判断をしてしまうことによる事故の発生、人工知能が悪用されることによる犯罪の増加などが懸念されています。

人工知能がもたらす恩恵を最大限に受け、より良い未来を築いていくためには、これらの問題にしっかりと向き合い、解決していくことが不可欠です。人工知能技術の開発と同時に、法律や倫理規定の整備、そして人材育成など、様々な取り組みをバランス良く進めていくことが重要です。そうすることで、人工知能と人間が共存し、より良い社会を築いていくことができると考えられます。

| 項目 | 内容 |

|---|---|

| 現状 | 人工知能は急速に進化しており、高性能化に伴うリスクも存在する。 |

| 研究開発 | データの偏りを修正する技術や、AIの判断根拠を説明する技術などが開発されている。 |

| 期待される効果 | 予期せぬ動作の抑制、社会への安心な導入。 |

| メリット | 医療の早期診断、製造業の自動化、生活の利便性向上。 |

| デメリット | 雇用問題、事故の発生、犯罪の増加。 |

| 今後の課題 | 問題への対策、法律や倫理規定の整備、人材育成。 |

| 目標 | 人工知能と人間の共存、より良い社会の実現。 |