学習の停滞:プラトー現象を理解する

AIを知りたい

先生、勾配降下法で『プラトー』っていう言葉が出てきたのですが、どういう意味でしょうか?

AIエンジニア

そうですね。『プラトー』とは、勾配、つまり坂の傾きがほとんどない平坦な場所のことを指します。山登りで例えると、山頂でも谷底でもない、平らな場所に迷い込んでしまうようなものです。

AIを知りたい

平らな場所だと、何が問題なのでしょうか?

AIエンジニア

勾配降下法は、坂を下るように最適な値を探していく方法です。平らな場所では、どちらに進んでいいのか分からなくなり、迷子になってしまうんです。一度迷子になると、なかなか抜け出せなくなり、正しい値にたどり着くのが難しくなります。これを『プラトーに陥る』と言います。

プラトーとは。

人工知能に関わる言葉で「停滞期」というものがあります。これは、人工知能の学習方法の一つである勾配降下法において、緩やかな平らな場所(鞍点と呼ばれる)に落ちてしまうことを指します。まるで谷底のような場所で、一度この停滞期に入ってしまうと、そこから抜け出すのがとても難しくなります。そのため、様々な工夫が必要となります。

プラトーとは

機械学習では、まるで登山家が山頂を目指すように、最適な解を見つけ出すための手法を用います。その中でも勾配降下法という手法は、現在の位置から最も急な下り坂を下るように進んでいくことで、最適な解、すなわち山頂を目指します。しかし、この下山中には、平坦な高原のような場所に迷い込むことがあります。これが、いわゆる「プラトー」と呼ばれる現象です。

プラトーは、勾配、つまり下りの傾きがほとんどない平坦な領域です。傾きがないということは、どちらの方向に進んでいいのかわからなくなることを意味します。登山家は霧の中に迷い込んだように、進むべき方向を見失い、立ち往生してしまいます。機械学習のアルゴリズムも同様に、この平坦な領域で方向を見失い、学習の進捗が止まってしまいます。まるで道に迷った旅人が、いつまでたっても目的地にたどり着けないような状態です。

この平坦な領域は、鞍点と呼ばれることもあります。鞍点は、馬の鞍のように、ある方向から見ると谷底、別の方向から見ると尾根のように見える特殊な場所です。谷底のように見える方向に進めば最適な解に近づけますが、尾根の方向に進めば、いつまでも最適な解にたどり着けません。プラトー、すなわち鞍点に陥ると、一見すると学習が完了したように見えることがあります。しかし、実際には最適な解には到達しておらず、モデルの性能は十分に発揮されていない状態です。このプラトー現象は、機械学習における大きな課題であり、モデルの性能向上を妨げる大きな壁となっています。そのため、このプラトーをいかに回避するかが、機械学習の重要な研究テーマの一つとなっています。

発生の要因

学習の停滞、いわゆるプラトー現象は、様々な要因が複雑に絡み合って発生するため、その原因を特定し、適切な対策を講じるのは容易ではありません。要因の一つとして、学習の速さを決める学習率の設定が挙げられます。学習率が大きすぎる場合は、最適な解を大きく超えてしまい、最適解の周辺で振動を繰り返すだけで、解に収束しないことがあります。逆に学習率が小さすぎる場合は、最適解へ近づく速度が遅くなり、プラトーに陥りやすくなります。一度プラトーに陥ると、そこから抜け出すのが難しく、学習が進まなくなってしまいます。

次に、モデルの構造もプラトー現象に影響を与えます。モデルが複雑になりすぎると、調整すべきパラメータの数が増え、パラメータ空間が高次元になります。高次元のパラメータ空間では、最適解を見つけるのがより困難になり、プラトーに陥る可能性が高まります。単純なモデルでは表現力が不足し、複雑なモデルでは学習が停滞しやすいため、モデルの複雑さと学習の効率性のバランスを考える必要があります。

さらに、学習に用いるデータの質も重要な要素です。データにノイズ、つまり不要な情報が多く含まれている場合や、特定の傾向に偏ったデータを用いている場合は、学習がスムーズに進まず、プラトー現象が発生しやすくなります。質の高いデータを用いることで、学習の停滞を防ぎ、より良い結果を得ることができます。これらの要因が単独で、あるいは複数組み合わさってプラトー現象を引き起こすため、様々な角度からの分析が必要です。

| 要因 | 問題点 | 結果 |

|---|---|---|

| 学習率 | 大きすぎる: 最適解を超え、振動を繰り返す 小さすぎる: 最適解への接近速度が遅く、プラトーに陥りやすい |

学習の停滞 |

| モデルの構造 | 複雑すぎる: パラメータ空間が高次元になり、最適解探索が困難、プラトーに陥りやすい 単純すぎる: 表現力が不足 |

学習の停滞 |

| 学習データの質 | ノイズが多い、特定の傾向に偏っている: 学習がスムーズに進まず、プラトーに陥りやすい | 学習の停滞 |

プラトーからの脱出

学習が停滞する状態、いわゆる「プラトー」は、機械学習において誰もが直面する課題です。この停滞期から脱却し、より良い結果を得るためには、様々な工夫を凝らす必要があります。

まず、基本的なアプローチとして「学習率の調整」があります。学習の初期段階では、大きな学習率を設定することで、モデルは学習データの特徴を大まかに捉え、急速に学習を進めることができます。しかし、学習が進むにつれて、この大きな学習率はモデルを最適な状態から遠ざけてしまう可能性があります。プラトーに差し掛かった段階では、学習率を小さく調整することで、より細かい精度で最適な値へと近づけることができます。ちょうど、山の頂上を目指す登山家が、最初は大きな歩幅で登り、頂上が近づくにつれて歩幅を小さくしていく様子に似ています。

次に、「勢い」を利用する「モーメンタム」という手法も有効です。これは、過去の学習で得られた勾配の情報を現在の勾配に反映させることで、まるでボールが坂道を転がり落ちるように、学習をスムーズに進める効果があります。プラトーに陥った状態は、浅い谷底に落ち込んだ状態に例えられますが、モーメンタムはこの谷底から脱出するための勢いを与えてくれます。

さらに、近年では「Adam」や「RMSprop」といった、より高度な最適化手法も注目を集めています。これらの手法は、各パラメータに対して個別に学習率を調整することで、より効率的な学習を実現します。これは、登山において、足場の状態に合わせて歩幅や足の運び方を変えることに似ています。

その他にも、モデルが学習データに過剰に適応してしまうのを防ぐ「正則化」や、「ドロップアウト」といった手法も、プラトー対策として有効な場合があります。これらの手法は、学習データの些細なノイズに惑わされずに、本質的な特徴を捉えるのに役立ちます。

| 手法 | 説明 | 例え |

|---|---|---|

| 学習率の調整 | 学習の初期は大きく、プラトーに陥ったら小さく調整する。 | 山の頂上を目指す登山家が、最初は大きな歩幅で登り、頂上が近づくにつれて歩幅を小さくしていく。 |

| モーメンタム | 過去の勾配の情報を現在の勾配に反映させることで、学習をスムーズに進める。 | ボールが坂道を転がり落ちるように、谷底から脱出するための勢いを与える。 |

| Adam / RMSprop | 各パラメータに対して個別に学習率を調整する。 | 足場の状態に合わせて歩幅や足の運び方を変える。 |

| 正則化 / ドロップアウト | 過学習を防ぎ、本質的な特徴を捉える。 | 学習データの些細なノイズに惑わされずに、本質的な特徴を捉える。 |

具体的な対策

学習の停滞、いわゆるプラトー現象は、様々な場面で発生する課題です。この現象への対策は、対象とする問題や扱うデータの種類によって適切な方法を選ぶ必要があります。画を認識するようなタスクでは、データ拡張という手法が有効です。これは、元となる画像データに様々な変換を加えることで、データの量を擬似的に増やす手法です。例えば、画像を回転させたり、拡大縮小したり、左右反転させたりすることで、新しい画像データを作り出します。このようにしてデータを増やすことで、学習が特定のデータのみに偏ることを防ぎ、プラトー現象を回避しやすくなります。

一方、言葉を扱うタスクでは、別の対策が必要です。例えば、単語の意味を数値で表す「分散表現」を学習する際に、プラトー現象に陥ることがあります。これは、ある単語が他の単語に比べて極端に多く出現する場合に起こりやすいです。例えば、「です」「ます」のような助詞は、文章中に頻繁に登場しますが、これらの単語に学習が偏ってしまうと、他の重要な単語の特徴を捉えにくくなります。このような場合は、単語の出現回数に応じて学習の度合いを調整するなどの工夫が求められます。よく出る単語の影響を抑え、珍しい単語も適切に学習できるようにすることで、プラトーを乗り越え、精度の高い分散表現を獲得できます。

このように、プラトー対策は画一的な方法ではなく、個々の課題に合わせた最適な方法を選ぶことが重要です。様々な手法を試し、問題に最適な解決策を見つけるには、試行錯誤を繰り返すことが必要不可欠です。

| タスクの種類 | プラトー現象の原因 | 対策 |

|---|---|---|

| 画像認識 | 学習データの偏り | データ拡張(回転、拡大縮小、左右反転など) |

| 自然言語処理(単語の分散表現学習) | 特定の単語(例:助詞)の過剰な出現による学習の偏り | 単語の出現頻度に応じた学習の重み付け調整 |

更なる探求

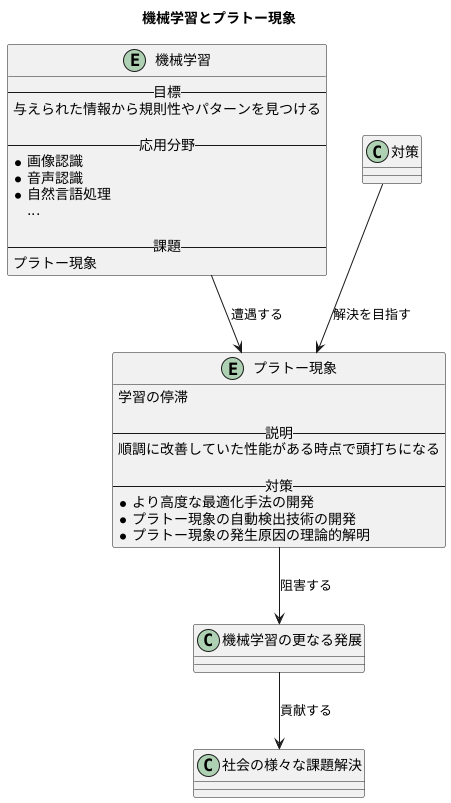

機械学習という技術は、まるで人が学ぶように、与えられた情報から規則性やパターンを見つける技術です。この技術は、画像認識や音声認識、自然言語処理など、様々な分野で目覚ましい成果を上げています。しかし、機械学習にも、学習の停滞という壁が存在します。これが、プラトー現象と呼ばれるものです。

プラトー現象とは、学習が進むにつれて、それまで順調に改善していた性能が、ある時点で頭打ちになり、停滞してしまう現象を指します。まるで、山を登る途中で、平坦な plateau に遭遇してしまうようなものです。この現象は、機械学習における重要な課題であり、世界中の研究者がその解決に取り組んでいます。

現在、プラトー現象を乗り越えるための様々な研究が行われています。例えば、より高度な最適化手法の開発です。機械学習は、膨大なデータの中から最適な解を見つけ出す必要がありますが、その過程は複雑で、しばしば局所的な最適解に囚われてしまいます。これを避けるために、より高度なアルゴリズムが研究されています。また、プラトー現象を自動的に検出する技術の開発も進められています。学習の停滞をいち早く察知することで、適切な対策を迅速に講じることが可能になります。

プラトー現象の発生原因を理論的に解明する研究も重要です。なぜ学習が停滞するのか、そのメカニズムを深く理解することで、より効果的な対策を立てることができます。まるで、山の地形を詳しく調べることで、より安全で効率的な登山ルートを見つけ出すようなものです。

これらの研究は、機械学習の更なる発展に不可欠です。プラトーという壁を乗り越えることで、機械学習はより高度な処理能力を獲得し、社会の様々な課題解決に貢献していくでしょう。今後の研究の進展に、大きな期待が寄せられています。

まとめ

機械学習は多くの分野で目覚ましい成果を上げていますが、その学習過程には様々な困難が伴います。中でも、学習の停滞を意味するプラトー現象は、性能向上を阻む大きな壁として立ちはだかります。

プラトー現象は、勾配がほぼゼロになり、学習が進まなくなる状態です。まるで平坦な高原地帯を彷徨うように、最適な解を見つけることができず、モデルの性能は頭打ちになります。この現象は、特に勾配降下法を用いた学習で顕著に現れます。勾配降下法は、勾配を頼りに最適な解へと進む方法ですが、勾配がなくなると進むべき方向を見失ってしまうからです。

では、どのようにしてこのプラトー現象に対処すれば良いのでしょうか。まず、学習率の調整が重要です。学習率が大きすぎると最適な解を飛び越えてしまい、小さすぎるとプラトーから抜け出せません。適切な学習率を見つけることが、学習の停滞を避ける第一歩です。

次に、最適化手法の見直しも効果的です。勾配降下法以外にも、様々な最適化手法が開発されています。例えば、慣性項を導入することで、局所的な最適解に陥りにくくするモーメンタム法や、パラメータごとに学習率を調整するAdamなどが挙げられます。これらの手法を適切に選択することで、プラトー現象の影響を軽減できます。

さらに、学習データの質も重要な要素です。データに偏りがあったり、ノイズが多いと、モデルは適切な学習を行うことができません。データの量を増やす、データの前処理を丁寧に行うなど、データの質を高める努力も欠かせません。

プラトー現象は、機械学習の最適化における大きな課題ですが、様々な対策を講じることで、その影響を最小限に抑えることができます。今後の研究により、更に効果的な手法が開発され、機械学習は更なる進化を遂げることでしょう。

| 問題点 | 原因 | 対策 |

|---|---|---|

| プラトー現象 (学習の停滞) | 勾配がほぼゼロになり、学習が進まなくなる。勾配降下法において、進むべき方向を見失う。 |

|