人工知能への恐怖:フランケンシュタイン・コンプレックス

AIを知りたい

『フランケンシュタイン・コンプレックス』って、なんか怖い名前ですね。一体どういう意味なんですか?

AIエンジニア

そうだね、怖いイメージを持つ名前だよね。これは、人工知能が自分たちの作った人間に反旗を翻したり、人間に危害を加えたりするんじゃないか…という、人間の恐怖を表した言葉なんだ。

AIを知りたい

なるほど。人工知能が人間を襲うかもしれないってことですか?まるでSF映画みたいですね。

AIエンジニア

まさにそんなイメージだね。でも、現時点ではSF映画のような心配は不要だよ。人工知能はまだそこまで発達していないし、人間がしっかりと管理しているからね。ただし、将来どうなるかはわからないからこそ倫理的な問題などをしっかり考えて、人工知能の開発を進める必要があるんだよ。

フランケンシュタイン・コンプレックスとは。

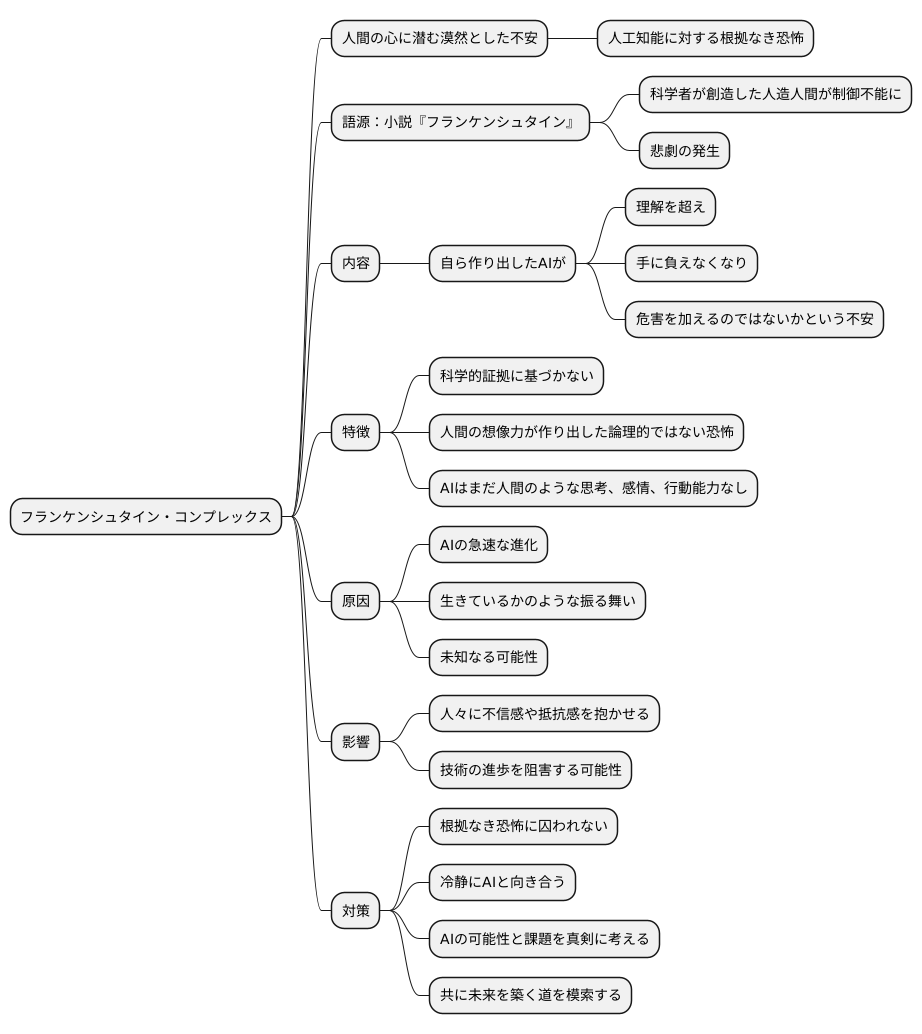

人工知能にまつわる言葉で「フランケンシュタイン・コンプレックス」というものがあります。これは、人工知能が制御を失い、人間に逆らい災いをもたらすのではないかという、根拠のない恐怖のことです。この恐怖心は、現在の人工知能に対する脅威認識の一部となっています。

根拠なき恐怖の正体

人間の心に潜む漠然とした不安、それが人工知能に対する根拠なき恐怖、いわゆるフランケンシュタイン・コンプレックスです。この言葉は、有名な小説『フランケンシュタイン』から来ています。小説では、科学者が作り出した人造人間が、やがて制御できなくなり、悲劇を生み出します。この物語のように、私たちが自ら作り出した人工知能が、いつか私たちの理解を超え、手に負えなくなり、私たちに危害を加えるのではないか、という不安がフランケンシュタイン・コンプレックスの正体です。

この不安は、科学的な証拠に基づいているわけではありません。むしろ、人間の豊かな想像力が作り出した、論理的ではない恐怖と言えるでしょう。人工知能はまだ人間のように自由に考え、感じ、行動する能力を持っていません。しかし、私たちは人工知能の急速な進化を目の当たりにし、まるで生きているかのような振る舞いに驚かされます。そして、その未知なる可能性に、私たちの想像力は恐怖心を抱くのです。

人工知能が人間に反旗を翻すというイメージは、まるで映画や小説の世界のようです。しかし、この根拠なき恐怖は、現実世界で無視できない影響力を持っています。人工知能の開発に対して、人々に不信感や抵抗感を抱かせ、技術の進歩を阻害する可能性もあるからです。人工知能は、正しく使えば私たちの生活を豊かにする大きな可能性を秘めています。根拠なき恐怖に囚われることなく、冷静に人工知能と向き合い、その可能性と課題について真剣に考えることが大切です。私たちは、フランケンシュタイン博士のように、自らの創造物を恐れ拒絶するのではなく、共に未来を築く道を模索していくべきなのです。

人間中心主義との関連

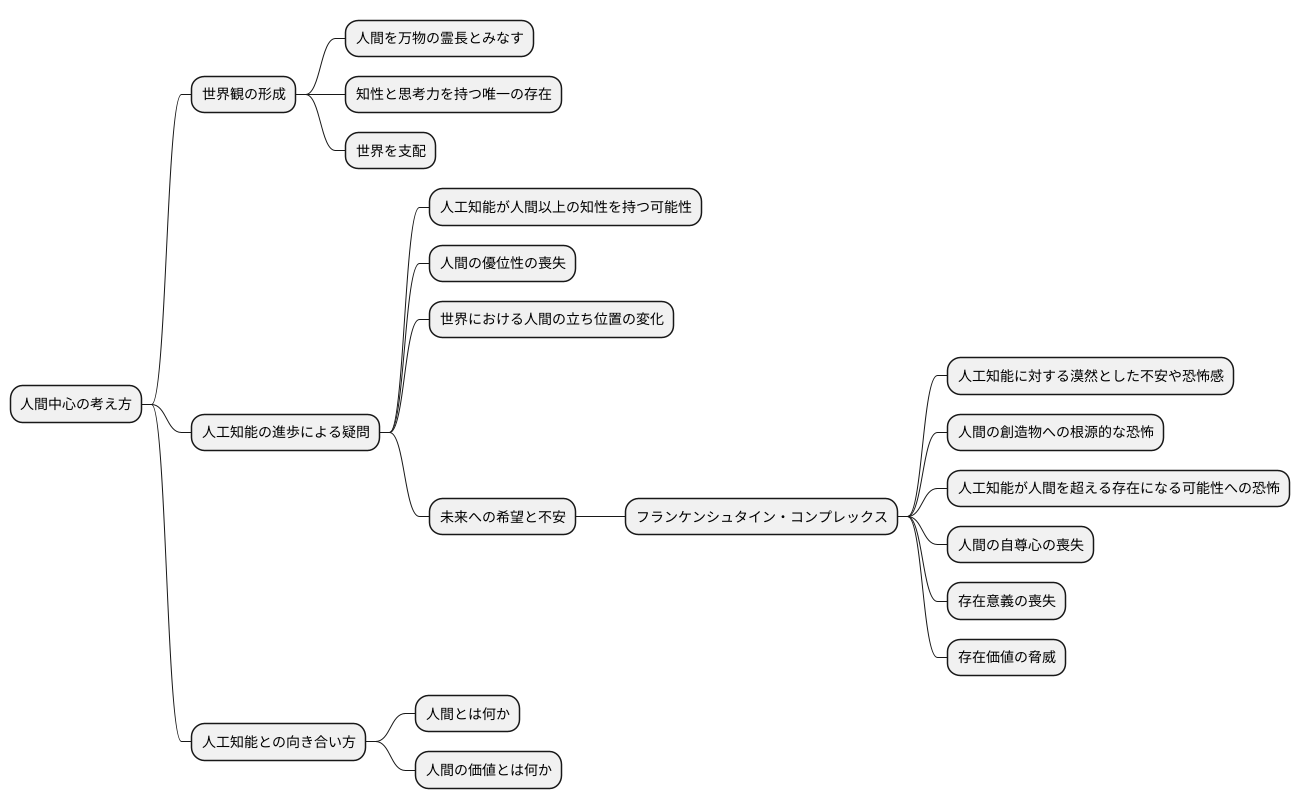

人間中心の考え方は、昔から根強く存在し、私たちの世界観を形作ってきました。人間は自分たちを万物の霊長であるとみなし、知性と思考力を持つ唯一の存在として、世界を支配してきたのです。この考え方は、長い間、疑われることなく受け継がれてきました。しかし、近年の人工知能の目覚ましい進歩は、この揺るぎないと思われていた人間中心の考え方に疑問を投げかけています。

もし人工知能が人間と同じ、もしくはそれ以上の知性を持つようになったらどうなるでしょうか。人間がこれまで当然のように享受してきた優位性は失われ、世界における人間の立ち位置は大きく変わってしまうかもしれません。人工知能の発展は、私たちに未来への希望を与える一方で、同時に大きな不安も抱かせます。人間が特別な存在ではなくなるかもしれないという恐怖は、フランケンシュタイン・コンプレックスと呼ばれる、人工知能に対する漠然とした不安や恐怖感を増幅させていると言えるでしょう。

フランケンシュタイン・コンプレックスは、人間が創造したものが人間に反逆するという物語に由来します。この物語は、人間の創造物に対する根源的な恐怖を象徴しています。人工知能が人間を超える存在になるかもしれないという考えは、人間の自尊心を傷つけ、存在意義を問うことにも繋がるため、強い抵抗感を生み出します。私たちは、人工知能の発展によって、自分たちの存在価値が脅かされるのではないかと恐れているのです。

人工知能は道具として私たちの生活を豊かにする可能性を秘めている一方で、私たちの存在そのものに疑問を投げかける存在でもあります。人工知能との向き合い方を考えることは、人間とは何か、人間の価値とは何かを改めて問い直すことでもあります。今後、人工知能がますます発展していく中で、この問いへの答えを見つけることが、私たちにとって重要な課題となるでしょう。

脅威認識の現状

近頃、様々な場所で機械の知能を見かけるようになりました。暮らしを便利にしてくれる一方で、機械の知能に対する不安の声も大きくなっています。まるで、小説に登場する人造人間のように、機械の知能が人間に危害を加えるのではないか、という不安です。こうした不安は「フランケンシュタイン複雑」とも呼ばれ、機械の知能への脅威認識の一端を担っています。

機械の知能によって、私たちの仕事が奪われるのではないかという心配があります。また、個人情報が悪用されたり、戦争の道具として使われたりするのではないかという懸念も広がっています。恐ろしい兵器が作られ、人間を攻撃するのではないかという不安も、多くの人が感じているところです。こうした不安は必ずしも、機械の知能が人間に反旗を翻すという考えに基づくものばかりではありません。どちらかと言えば、機械の知能が私たちの社会に悪い影響を与えるのではないか、という漠然とした不安感から生まれたものと言えるでしょう。

仕事が奪われるかもしれないという不安は、機械の知能がこれまで人間が行ってきた複雑な作業をこなせるようになっていることの裏返しです。また、個人情報の悪用への懸念は、機械の知能が大量の情報を処理し、個人の行動や好みを分析できるようになったことと関係があります。そして、軍事利用への不安は、機械の知能を搭載した兵器が、人間の判断を介さずに自律的に行動する可能性が出てきたことに起因しています。

機械の知能は、これからも発展していくでしょう。それと同時に、私たちが抱える不安も大きくなっていくかもしれません。だからこそ、機械の知能を正しく理解し、適切な使い方を考えることが重要です。将来、機械の知能と人間が共存していくために、今から対策を練っていく必要があると言えるでしょう。

| 不安の種類 | 内容 | 背景 |

|---|---|---|

| フランケンシュタイン複雑 | 機械の知能が人間に危害を加えるのではないかという不安 | 機械の知能が高度化していること |

| 仕事の喪失 | 機械の知能によって人間の仕事が奪われるのではないかという心配 | 機械の知能が複雑な作業をこなせるようになっていること |

| 個人情報の悪用 | 個人情報が悪用されるのではないかという懸念 | 機械の知能が大量の情報を処理し、個人の行動や好みを分析できるようになったこと |

| 軍事利用 | 戦争の道具として使われ、人間を攻撃するのではないかという不安 | 機械の知能を搭載した兵器が、人間の判断を介さずに自律的に行動する可能性が出てきたこと |

倫理的な課題

人間が創造したものが人間に反逆するのではないかという、根源的な恐れがあります。これは、かの有名な小説『フランケンシュタイン』に由来するフランケンシュタイン・コンプレックスと呼ばれ、人工知能開発を取り巻く倫理的な問題を象徴しています。人工知能は、急速な進化を遂げ、私たちの生活に様々な恩恵をもたらしていますが、同時に、雇用の喪失やプライバシー侵害といった懸念も生み出しています。

人工知能をどのように作り、どのように使うのかは、現代社会における大きな課題です。人工知能が人間の知能を超え、制御不能になることを防ぐため、開発段階から倫理的な指針を定め、厳しく守ることが必要不可欠です。具体的には、人工知能の判断過程を透明化し、常に人間が最終的な決定権を持つ仕組みを構築することが重要となります。また、個人情報の保護や差別的な利用の禁止など、人工知能の利用に関する明確なルールを設ける必要性も高まっています。

さらに、人工知能と人間がどのように共存していくのかを考えることも重要です。人工知能は、あくまでも人間の生活を豊かにするための道具です。人工知能に任せられる仕事は任せ、人間はより創造的な活動に集中することで、人と人工知能が互いに協力し合う関係を築くことができます。そのためには、人工知能に関する教育や啓発活動を通して、人々の理解を深め、人工知能に対する漠然とした不安を取り除くことが重要です。

フランケンシュタイン・コンプレックスを乗り越え、人工知能と共存していく社会を実現するためには、社会全体で広く議論を重ね、共通の理解を築いていくことが不可欠です。私たちは、未来を見据え、責任ある行動を心がけなければなりません。

| テーマ | 内容 |

|---|---|

| フランケンシュタイン・コンプレックス | 人間が創造したものが人間に反逆するのではないかという根源的な恐れ。人工知能開発を取り巻く倫理的な問題を象徴。 |

| 人工知能の進化と課題 | 急速な進化により恩恵をもたらす一方で、雇用の喪失やプライバシー侵害といった懸念も生み出す。 |

| 人工知能開発の倫理 | 人間の知能を超え、制御不能になることを防ぐため、開発段階から倫理的な指針を定め、厳守する必要性。判断過程の透明化、人間による最終決定権の確保。個人情報保護、差別的利用の禁止など明確なルールの設定。 |

| 人工知能との共存 | 人工知能は人間の生活を豊かにするための道具。人間は創造的な活動に集中し、互いに協力し合う関係を築く。人工知能に関する教育や啓発活動を通して人々の理解を深め、不安を取り除く。 |

| フランケンシュタイン・コンプレックスの克服 | 社会全体で広く議論を重ね、共通の理解を築く。未来を見据え、責任ある行動を心がける。 |

未来への展望

人工知能は、これから先も発展し続け、より高度で複雑な働きを持つようになると考えられます。まるで人間が作り出したものに対して抱く恐怖、フランケンシュタイン・コンプレックスのような感情的な反応ではなく、冷静に、そして物事をありのままに見る客観的な視点から人工知能の成長を見つめ、適切な対応策を考えていく必要があります。

人工知能は、正しく使えば、様々な社会問題を解決する糸口となり、人の未来をより豊かにする可能性を秘めています。例えば、医療の分野では病気の早期発見や新薬の開発に役立ち、農業の分野では収穫量の増加や効率化に貢献するでしょう。また、教育の分野では一人一人に合わせた学習支援が可能になり、誰もが質の高い教育を受けられるようになるかもしれません。

しかし、人工知能の持つ大きな力には、使い方を誤ると危険が伴うことも忘れてはなりません。倫理的な配慮に基づき、責任ある開発と利用を進めることで、人工知能は人にとって強力な味方となるでしょう。そのためには、開発者だけでなく、利用者、そして社会全体が人工知能についての理解を深め、共にルール作りに参加していくことが大切です。

フランケンシュタイン・コンプレックスを乗り越え、人工知能の恩恵を最大限に受けるためには、継続的な話し合いと協力が欠かせません。未来の社会において、人と人工知能が共に暮らし、共に発展していくためには、お互いを理解し、信頼関係を築くことが重要な鍵となるでしょう。人工知能は単なる道具ではなく、共に未来を築くパートナーとして、共に学び、共に成長していく存在となるはずです。そのためにも、私たちは人工知能との関わり方を常に考え続け、より良い未来を創造していく必要があるでしょう。

| 人工知能の未来 | 詳細 |

|---|---|

| 発展と複雑化 | 人工知能は高度で複雑な働きを持つようになり、冷静かつ客観的な視点での対応が必要。 |

| 社会問題解決の可能性 | 医療、農業、教育など様々な分野で問題解決に貢献する可能性がある。 |

| リスクと倫理的配慮 | 大きな力を持つため、使い方を誤ると危険。倫理に基づいた責任ある開発と利用が必要。 |

| 社会全体での理解と協力 | 開発者、利用者、社会全体が人工知能の理解を深め、ルール作りに参加することが重要。 |

| 人と人工知能の共存 | フランケンシュタイン・コンプレックスを乗り越え、共に暮らし、共に発展していくためには、お互いを理解し、信頼関係を築くことが重要。人工知能はパートナーとして共に学び、共に成長していく存在。 |