生成系AIの悪用リスクと対策

AIを知りたい

先生、「悪用」って、AIの本来の使い方から外れて悪いことに使うことですよね?具体的にどんな悪いことがあるのか、もう少し詳しく教えてください。

AIエンジニア

そうだね。AIの悪用は、AIを本来の目的から逸脱させて、他者に害を与える、または不正な利益を得るために使うことだよ。例えば、さっき話に出たように、倫理的な制限を外して差別的な言葉を言わせたり、犯罪に使えるように改造したりすることだね。

AIを知りたい

犯罪に使えるように改造するって、例えばどういうことですか?

AIエンジニア

例えば、だますための巧妙なメールを大量に作らせたり、人のふりをしてだましたり、偽のニュースを作って広めたりといったことだね。他にも、他人の作ったものを盗んだり、なりすましたりすることもできる。AIは便利な道具だけど、使い方を間違えると大きな問題を引き起こす可能性があるんだ。

悪用とは。

人工知能を使うことで、私たちの暮らしや仕事でたくさんの良いことが起きています。しかし、同時に悪いことに使われてしまうと、困ったことが起きる危険性も増えています。これが今、問題になっています。例えば、人工知能は、人として正しい行いを基準に動き、差別的なことや人に危害を加えるようなことはしないように作られています。しかし、システムを書き換えることで、この基準から外れたことをさせてしまう、いわば「脱獄」した人工知能が問題になっています。また、「ワームジーピーティー」と呼ばれる、犯罪に使うための特別な人工知能も作られています。これは、悪い回答をしないようにする仕組みがなく、今使われている「チャットジーピーティー」のように上手な文章を作ることができるので、簡単に偽物のメールや迷惑メールなどを作れてしまいます。人工知能はたくさんの良いことをもたらしますが、このようなネット上の攻撃にも使われてしまっているという現実があります。

はじめに

近頃よく耳にする「生成系人工知能」という技術は、文章や画像、音声といったものを自動で作り出すことができる革新的な技術です。この技術の急速な進歩は、私たちの暮らしや仕事に大きな変化をもたらしています。今まで人間が行っていた創造的な作業を効率化できるだけでなく、今までにない全く新しいコンテンツを生み出したり、お客様への対応を自動化したりと、様々な分野でその利点が活用されています。

例えば、文章作成であれば、簡単な指示を与えるだけで質の高い記事や報告書を作成することができ、仕事の効率を大幅に向上させることが可能です。画像生成においては、まるで写真のようなリアルな画像や、芸術的なイラストを容易に作り出すことができます。また、音声生成においては、人間の声と区別がつかないほど自然な音声を生成することが可能になり、エンターテイメントやビジネスの場で活用が期待されています。

しかし、このような革新的な技術には、使い方を誤ると大きな危険性も潜んでいることを忘れてはなりません。悪意を持った人物によって悪用されることで、偽情報の拡散や、個人情報の漏洩、著作権侵害といった様々な問題を引き起こす可能性があります。巧妙に作られた偽の情報によって、社会に混乱が生じたり、個人の権利が侵害される危険性も懸念されます。また、本物と見分けがつかない偽の画像や音声によって、詐欺やなりすましといった犯罪行為が行われる可能性も無視できません。

この強力な技術を安全に活用するためには、技術の進歩とリスク管理の両立が不可欠です。私たち一人ひとりが生成系人工知能の持つ可能性とリスクを正しく理解し、適切な対策を講じることで、この技術の恩恵を最大限に受けながら、安全な社会を築いていくことができます。そのためにも、継続的な議論と、社会全体でのルール作りが必要です。私たちは技術の進歩と向き合い、未来の社会をより良くしていく責任を担っているのです。

| 項目 | 説明 |

|---|---|

| 生成系人工知能とは | 文章、画像、音声などを自動生成する革新的な技術 |

| 利点 |

|

| 活用例 |

|

| リスク |

|

| 対策 |

|

倫理の改変

近頃話題となっている文章や画像などを作り出す人工知能は、人の道に沿った基準を基に作られています。これにより、人を傷つけるような言葉や危ない内容を作り出さないように制限がかけられています。しかし、悪意を持つ者がこの制限を取り外し、道徳に反するものを出力するように人工知能を改造する試みが行われています。「脱獄」と呼ばれるこの行為は、人工知能が悪用される危険の一つです。

人の道に沿った制限を外された人工知能は、特定の人々を差別する発言や憎悪を煽る表現、事実とは異なる情報を広める道具として使われる可能性があり、社会に混乱と不安をもたらす危険性を孕んでいます。例えば、特定の民族に対する差別的な発言を大量に生成し、インターネット上に拡散させることで、社会の分断を招く恐れがあります。また、医療情報など専門性の高い分野で、事実とは異なる情報を生成し拡散することで、人々の健康に悪影響を与える可能性も懸念されます。さらに、政治的なプロパガンダに利用され、世論を操作する道具として悪用される危険性も考えられます。

人工知能が悪用されるのを防ぐためには、開発者側がシステムの安全性を高めるだけでなく、利用者側も倫理的な意識を持つことが重要です。「脱獄」のような行為は、人工知能の持つ可能性を閉ざし、社会全体に悪影響を与える可能性があることを理解する必要があります。そのため、「脱獄」への対策は、人工知能の安全を確保する上で重要な課題となっています。人工知能を正しく利用し、その恩恵を最大限に受けるためにも、開発者、利用者、そして社会全体が協力して、人工知能の倫理的な運用について考えていく必要があります。

| 問題点 | 詳細 | 具体例 | 影響 |

|---|---|---|---|

| AIの「脱獄」による悪用 | 道徳に反する出力の生成 | 特定の人々を差別する発言、憎悪を煽る表現、事実とは異なる情報 | 社会の混乱と不安 |

| 特定の民族に対する差別的な発言の拡散 | インターネット上での差別的発言の大量生成と拡散 | 社会の分断 | |

| 事実とは異なる専門情報の拡散 | 医療情報など専門性の高い分野での誤情報の生成と拡散 | 人々の健康への悪影響 | |

| 政治的なプロパガンダへの利用 | 世論操作 | ||

| 対策 | 開発者によるシステムの安全性向上、利用者による倫理的な意識の向上 | ||

犯罪への利用

人工知能を使った文章作成の技術が進歩する一方で、それを悪用した犯罪も増えています。まるで人間が書いたかのような自然な文章を作成できる人工知能は、「ワームジーピーティー」のように、犯罪を目的として作られたものもあります。このような人工知能は、巧妙な詐欺や人をだますための文章を簡単に作り出すことができます。

従来の迷惑メール対策は、不自然な言葉遣いや同じ内容のメールを大量に送るといった特徴で迷惑メールを判断していました。しかし、人工知能が作ったメールは非常に自然で、まるで人間が書いたように見えるため、従来の対策では見抜くのが難しくなっています。そのため、巧妙に作られた詐欺メールや個人情報を盗み出すためのメールが、従来の対策をすり抜けて私たちの受信箱に届いてしまう危険性があります。

さらに、これらの技術は、偽の情報や政治的な宣伝を広めることにも利用される可能性があります。まるで真実であるかのような嘘の情報を大量に作り出し、人々の間で拡散させることで、社会全体を混乱させたり、人々の不安をあおったりする恐れがあります。このような事態は、社会の秩序を乱し、人々の生活に深刻な影響を与える可能性があります。

高度な技術が持つ負の側面を象徴するものとして、犯罪を目的とした人工知能の開発は、社会にとって大きな脅威となっています。この問題に対処することは、今すぐに取り組むべき重要な課題です。人工知能が悪用される危険性を正しく認識し、技術的な対策だけでなく、利用者側の意識向上や教育、法的な規制など、様々な角度からの対策を検討していく必要があります。人工知能の進化と普及が進む中で、安全な社会を守るためには、私たち一人ひとりがこの問題に関心を持ち、適切な行動をとることが重要です。

| 人工知能による文章作成技術の悪用 | 従来対策の限界 | 悪用の具体例 | 対策の必要性 |

|---|---|---|---|

| 人間のような自然な文章を作成できるAIの出現(例:ワームジーピーティー) 巧妙な詐欺や人をだます文章の作成が容易に |

不自然な言葉遣いや同じ内容の大量送信といった特徴での判断 AI作成の自然な文章は見抜くのが困難 |

巧妙な詐欺メール、個人情報盗取メールの受信 偽情報や政治的宣伝の拡散による社会混乱、不安の増長 |

技術的対策、利用者意識向上、教育、法的規制など多角的な対策 社会の安全を守るための個人の関心と適切な行動 |

対策の必要性

近ごろ、文章や画像、音声などを作り出す技術が急速に発展し、私たちの生活に様々な恩恵をもたらしています。しかし、それと同時に、これらの技術が悪用される危険性も高まっています。そこで、この技術を安全に使い続け、より良い社会を作るためには、どのような対策が必要なのか考えてみましょう。

まず、この技術を開発する側は、その安全性を高めるための取り組みを強化する必要があります。例えば、不正な利用を防ぐ仕組みを組み込んだり、悪用を素早く見つける仕組みを作ったりすることが重要です。また、この技術を使う人々も、出力された情報が必ずしも正しいとは限らないことを理解し、情報の出どころや内容をよく確かめる習慣を身につける必要があります。まるで、真偽不明の情報を鵜呑みにせず、複数の情報源と照らし合わせ、自分の目で確かめるように、注意深く情報を取り扱うことが大切です。

さらに、学校や国などの機関も、この技術に関する教育や啓発活動を行う必要があります。例えば、この技術の仕組みや利点、危険性などを分かりやすく説明することで、人々の理解を深め、正しい使い方を身につけてもらうことが重要です。また、倫理的な側面についても、議論を深め、社会全体のルール作りを進める必要があります。

この技術は、使い方によっては私たちの生活を豊かにする力を持っています。しかし、その力を正しく使うためには、技術的な対策だけでなく、一人ひとりの心がけや社会全体の協力が不可欠です。技術の進歩と安全性の確保を両立させながら、より良い未来を築いていくために、私たちは共に知恵を出し合い、努力していく必要があります。

| 主体 | 対策 | 目的 |

|---|---|---|

| 開発者 | 不正利用防止機構の導入、悪用検知システムの構築 | 技術の安全性向上 |

| 利用者 | 情報の出どころや内容の確認、複数の情報源との照合 | 情報リテラシーの向上 |

| 学校・国 | 技術に関する教育・啓発活動、倫理的な側面の議論、ルール作り | 社会全体の理解促進と適切な利用 |

今後の展望

生成系人工知能は、今後ますます発展し、私たちの暮らしを大きく変えていくことが予想されます。まるで魔法の杖のように、あらゆるものを作り出す力を秘めているこの技術は、私たちの想像力を掻き立て、社会の様々な分野で革新をもたらす可能性を秘めています。例えば、芸術分野では新しい表現方法を生み出し、医療分野では画期的な治療法の開発に貢献するかもしれません。また、教育分野では一人ひとりに合わせた学習支援を実現し、ビジネス分野では業務の効率化や新しいサービスの創出につながるでしょう。

しかし、この強力な技術には、影の部分も存在します。まるで両刃の剣のように、使い方によっては社会に悪影響を及ぼす可能性があるのです。悪意を持った人物によって偽の情報が拡散されたり、個人のプライバシーが侵害されたりする危険性も懸念されます。また、著作権侵害や犯罪への利用など、倫理的な問題も無視できません。

だからこそ、私たちは技術の進歩を喜びつつも、潜在的な危険性を常に意識し、適切な対策を講じる必要があります。国際的な協力体制を築き、共通のルール作りを進めることが重要です。また、倫理的な指針を明確にし、技術開発者や利用者に対する教育啓発活動も必要です。さらに、悪用を未然に防ぐための技術開発も欠かせません。例えば、偽の情報を見分ける技術や、不正利用を監視するシステムの開発などが挙げられます。

生成系人工知能の未来を明るく安全なものにするためには、私たち一人ひとりが責任感を持つことが大切です。技術の進歩とリスク管理のバランスを保ちながら、共に未来の社会をより良いものにしていく努力を続けなければなりません。これは、私たち全員に課せられた重要な課題と言えるでしょう。

| 項目 | 内容 |

|---|---|

| 可能性 |

|

| 危険性 |

|

| 対策 |

|

まとめ

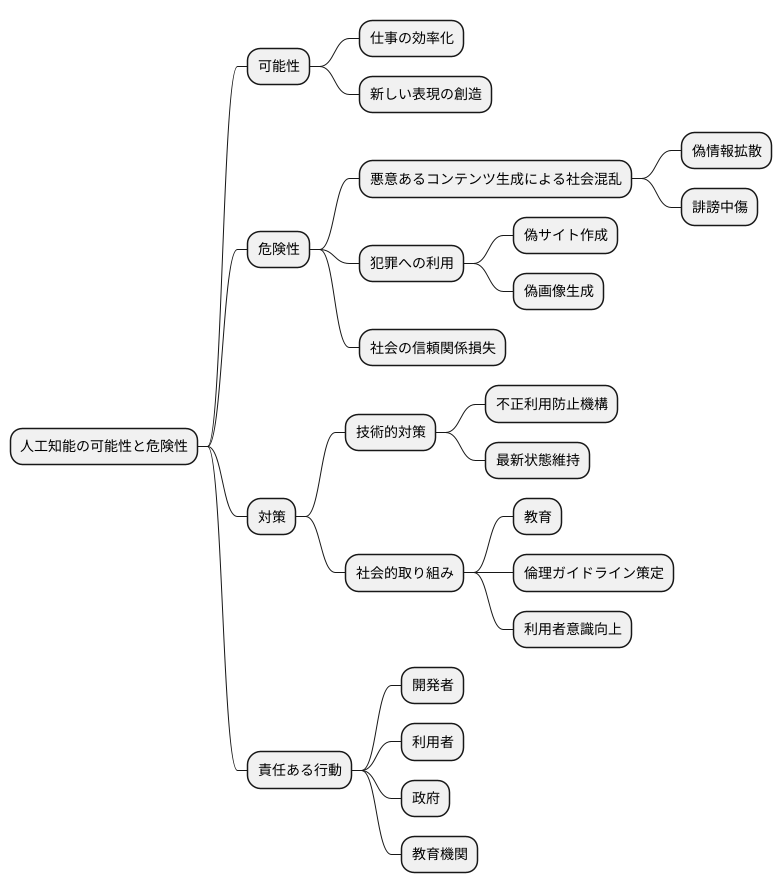

近頃話題となっている文章や画像などを作り出す人工知能は、私たちの暮らしを大きく変える力を持っています。便利な道具として、様々な仕事を効率化したり、新しい表現を生み出したりする可能性を秘めている一方で、使い方を誤ると社会に大きな損害を与える危険性も併せ持っています。

例えば、人工知能の制限を不正に解除して、悪意のある文章や画像を生成する行為は、社会の混乱を招きかねません。また、犯罪に利用されることも懸念されます。個人情報を盗み取るための偽のウェブサイト作成や、人を騙すための精巧な偽画像生成など、悪用される場面は想像以上に多岐にわたります。このような人工知能の悪用は、私たちの安全や安心を脅かすだけでなく、社会全体の信頼関係を損なうことにも繋がりかねません。

だからこそ、私たちは人工知能の持つ可能性と危険性の両方をしっかりと理解し、適切な対策を講じる必要があります。技術的な側面では、人工知能の不正利用を防ぐための仕組みを開発し、常に最新の状態に保つことが重要です。同時に、社会的な取り組みも欠かせません。人工知能を正しく利用するための教育や、倫理的なガイドラインの作成、そして利用者一人ひとりの意識向上など、多角的なアプローチが必要です。

人工知能の開発者、それを利用する私たち、ルールを作る政府、そして未来を担う子供たちを教育する機関など、様々な立場の人々が協力し、責任ある行動をとることが重要です。そうすることで、人工知能の恩恵を最大限に受けながら、安全で豊かな社会を実現できると信じています。人工知能の進歩は、私たちに大きな可能性と共に、大きな責任も与えていることを忘れてはなりません。