AI開発の指針:倫理と議論の重要性

AIを知りたい

先生、「指針の作成と議論の継続」って、何で必要なんですか?AIって便利なものなら、どんどん開発すればいいんじゃないですか?

AIエンジニア

確かにAIは便利だけど、使い方を間違えると悪いことにも使われてしまう可能性があるんだよ。例えば、人の仕事を全部AIが奪ってしまったり、AIが作った偽の情報が拡散してしまったり。そうならないために、みんなでルール作りや話し合いを続けることが大切なんだ。

AIを知りたい

なるほど。でも、ルール作りって難しそうですね。具体的にどんなことを話し合っているんですか?

AIエンジニア

例えば、AIの開発や利用で、人の安全やプライバシーはどうやって守るか、AIが間違った判断をした時、誰が責任を取るのか、といったことを話し合っているんだよ。色々な立場の人が集まって、より良いAI社会を作るために議論を続けているんだ。

指針の作成と議論の継続とは。

人工知能に関わる言葉である「指針作りと話し合いの継続」について説明します。企業や研究者、そして利用者が安心して人工知能を作り、使うためには、法律や道徳に関する指針や話し合いが欠かせません。これに関連して、「人工知能における協力関係」や「人間中心のAI社会原則」といったものがあります。「人工知能における協力関係」は、2016年にアメリカの有名な五つの情報技術企業、フェイスブック、アマゾン、マイクロソフト、グーグル、アイビーエムが作った営利を目的としない団体です。技術の研究や共有、安全性や透明性といった倫理的な問題について話し合うことを目的として活動しています。「人間中心のAI社会原則」は内閣府が作ったもので、人間の尊厳が守られる社会、様々な背景を持つ人々が様々な幸せを追い求められる社会、そして、ずっと続く社会、この三つの考え方を大切にした人工知能の活用を目指す指針です。

安心安全なAI開発に向けて

近頃、人工知能(AI)という技術が、私たちの暮らしを大きく変えつつあります。買い物や情報収集だけでなく、車の自動運転や医療診断など、様々な場面で活用され始めており、将来はさらに生活の多くの部分を担うと予想されています。AIは私たちの生活を便利で豊かにする大きな可能性を秘めていると言えるでしょう。しかし、同時にAI技術には様々な危険性も潜んでいることを忘れてはなりません。

例えば、AIが誤った判断を下した場合、大きな事故につながる可能性があります。自動運転車が歩行者を認識できずに事故を起こしたり、医療診断AIが誤診をして適切な治療が遅れるといった事態は、絶対に避けなければなりません。また、AIが個人情報を不正に利用したり、偏った情報を学習して差別的な判断を下すことも懸念されています。AIによる監視社会の到来や、雇用の喪失といった社会問題も無視できません。

AI技術を安全に開発し、安心して利用するためには、明確なルール作りが不可欠です。どのような開発が許されるのか、どのような利用方法が適切なのか、法律や倫理に基づいた指針を定め、開発者や利用者が守るべき規範を明確にする必要があります。同時に、AI技術は常に進化しているため、指針も定期的に見直し、社会全体の意見を取り入れながら改善していく必要があります。

AI開発に携わる研究者や技術者はもちろんのこと、AIを利用する私たち一人一人も、AIが社会に与える影響について真剣に考え、責任ある行動をとらなければなりません。AIの恩恵を最大限に受けつつ、潜在的な危険性を最小限に抑えるためには、社会全体でAIとの適切な関わり方について議論し、合意形成していくことが重要です。AIの健全な発展は、私たち全員の協力と不断の努力にかかっていると言えるでしょう。

| AIの可能性 | AIの危険性 | AIとどう向き合うか |

|---|---|---|

|

|

|

世界的な取り組みと課題

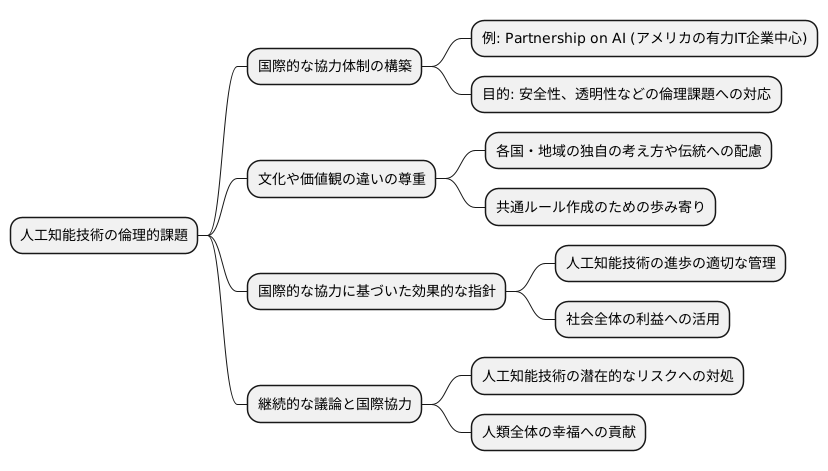

人工知能技術の開発は急速に進歩していますが、それと同時に倫理的な問題への対応も世界中で重要な課題となっています。様々な国や地域で、人工知能が社会に与える影響について真剣な議論が交わされています。

人工知能技術の倫理的な側面への取り組みとして、国際的な協力体制の構築が欠かせません。例えば、アメリカの有力な情報技術企業が中心となって設立した「Partnership on AI」のような団体は、人工知能技術の安全性や透明性といった倫理的な課題に焦点を当てた議論を深めています。この組織のように、国境を越えた協力関係を築くことで、共通の課題に対する解決策を探ることが可能になります。

世界的な連携を進める上で、文化や価値観の違いを尊重することは非常に重要です。それぞれの国や地域には独自の考え方や伝統があり、人工知能技術の利用についても異なる視点が存在します。共通のルールを作るためには、様々な立場を理解し、互いに歩み寄る努力が求められます。

人工知能技術の健全な発展のためには、国際的な協力に基づいた効果的な指針が必要です。この指針は、人工知能技術の進歩を適切に管理し、社会全体の利益に繋がるように活用するための道標となります。世界各国が協力して知恵を出し合うことで、より良い指針を策定し、人工知能技術の未来をより明るいものにしていくことが可能になるでしょう。

人工知能技術は大きな可能性を秘めていますが、同時に潜在的なリスクも抱えています。倫理的な課題に適切に対処するためには、継続的な議論と国際的な協力が不可欠です。世界中の人々が協力し、知恵を共有することで、人工知能技術を人類全体の幸福に役立てることができるはずです。

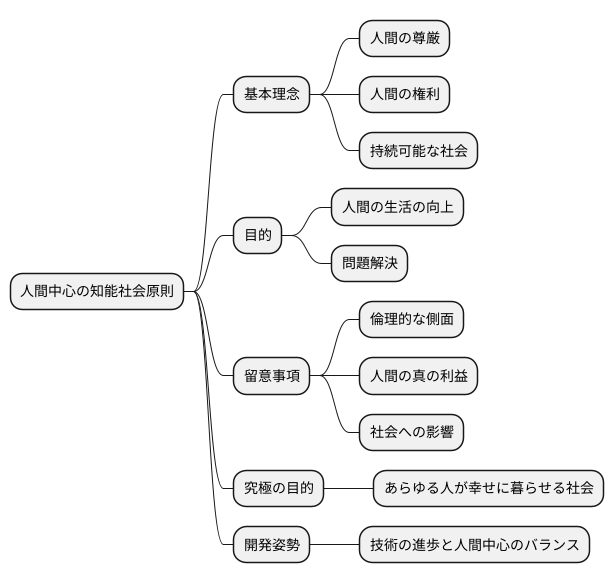

日本の指針:人間中心のAI社会

私たちの国では、人工知能が急速に発展し、社会の様々な場面で活用されるようになってきています。このような流れの中で、内閣府が中心となり「人間中心の知能社会原則」を定めました。この原則は、人工知能の開発や利用において、常に人間にとっての価値を最優先に考えることが重要であることを示しています。

この原則は、人間の尊厳を何よりも大切にするという基本理念に基づいています。人工知能は、人間の生活をより豊かに、便利にするための道具として活用されるべきであり、決して人間を支配したり、人間の権利を侵害するような存在であってはなりません。あらゆる人が、それぞれの人生を幸せに送ることができるように、持続可能な社会を築いていくことこそが、人工知能開発の究極の目的です。

人工知能は、様々な問題を解決し、私たちの暮らしを向上させる大きな可能性を秘めています。しかし、その技術は使い方を誤ると、社会に混乱や不平等をもたらす危険性もはらんでいます。だからこそ、人工知能の開発や利用にあたっては、倫理的な側面を常に意識し、人間にとって本当に有益なものとなるよう、慎重に進めていく必要があります。

この原則は、人工知能開発における日本の姿勢を示す重要な指針となっています。技術の進歩は目覚ましいものですが、私たちは「人間中心」という視点を決して忘れてはなりません。人工知能を正しく導き、社会全体にとって真に役立つものにするためには、一人ひとりがこの原則を理解し、共に未来を考えていくことが大切です。

企業の役割と責任

人工知能という新しい技術を作る、あるいは提供する会社は、人として正しい行いを示す指針に沿って行動する義務があります。これは、技術を使う人にとって安全で、かつその仕組みが分かりやすいものを作るということです。同時に、個人の情報が守られるように細心の注意を払う必要もあります。このような倫理的な問題に、会社は真剣に取り組まなければなりません。

人工知能は私たちの暮らしを豊かにする力を持っています。会社は、この技術の素晴らしい点を広く世の中に伝える役割も担っています。人工知能がどのように役立つのか、どんな可能性を秘めているのかを、分かりやすく説明することで、人々の不安を取り除き、この新しい技術を受け入れてもらいやすくすることができます。

会社が積極的に情報を公開し、倫理にかなった行動をとることは、人工知能技術への信頼を高めることにつながります。例えば、人工知能がどのように学習し、判断するのかを明らかにすることで、人々は安心して技術を使うことができます。また、個人情報がどのように扱われるのか、プライバシー保護にどのように取り組んでいるのかを具体的に示すことも重要です。

人工知能技術は、社会全体に大きな利益をもたらす可能性を秘めています。しかし、その恩恵を最大限に受けるためには、会社が倫理的な責任を果たし、人々の理解と信頼を得ることが不可欠です。技術の進歩と社会の調和を図りながら、より良い未来を築いていくために、会社は重要な役割を担っていると言えるでしょう。

| 責任 | 行動 | 目的 |

|---|---|---|

| 倫理的な行動 | 安全で分かりやすい技術の開発、個人情報の保護 | 技術利用者の安全確保と信頼獲得 |

| 積極的な情報公開 | 人工知能の利点や可能性の説明、技術の仕組みやプライバシー保護への取り組みの公開 | 人々の理解促進と不安解消 |

| 透明性の確保 | 学習方法や判断基準の公開、個人情報の取り扱いの説明 | 技術への信頼向上と安心感の提供 |

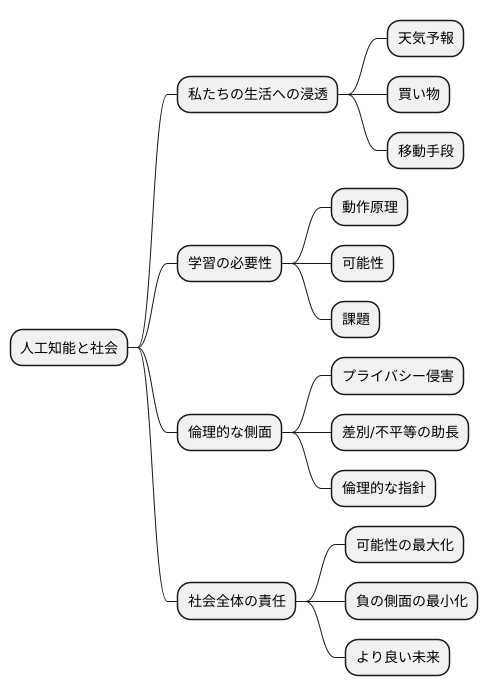

私たち一人ひとりの意識

私たちは今、大きな変化の中にいます。かつては一部の専門家だけが扱っていた人工知能の技術は、私たちの暮らしの様々な場面に入り込み、社会全体を大きく変えつつあります。朝起きて天気予報を確認するのも、買い物をするのも、移動手段を選ぶのも、人工知能の技術が関わっています。もはや、私たちの生活から切り離して考えることはできません。

だからこそ、私たち一人ひとりが人工知能の技術について学ぶことが大切です。どのように動き、どのようなことができるのか、そしてどのような課題があるのかを知る必要があります。人工知能は道具であり、使い方次第で良い結果にも悪い結果にも繋がります。包丁が料理に役立つ道具であると同時に、危険な凶器にもなり得るのと同じです。人工知能も使い方を誤れば、社会に大きな損害を与える可能性があります。

人工知能技術の倫理的な側面を考えることも重要です。人工知能は多くの情報を処理し、私たちの行動を予測することができます。しかし、それは同時に、私たちのプライバシーを侵害する可能性も秘めています。また、人工知能が偏ったデータで学習すると、差別や不平等を助長する恐れもあります。このような問題を避けるためには、どのような倫理的な指針が必要なのか、社会全体で議論を深める必要があります。

人工知能技術の利用は、一部の人たちだけの問題ではありません。社会全体で責任を持って取り組むべき課題です。人工知能が持つ可能性を最大限に活かし、負の側面を最小限に抑えるためには、私たち一人ひとりが倫理的な意識を持って技術と向き合い、より良い未来を築いていく必要があるでしょう。人工知能は、正しく使えば私たちの暮らしを豊かにし、様々な社会問題を解決する力を持っています。未来への希望を胸に、共に知恵を出し合い、より良い社会を創造していきましょう。

継続的な対話と改善

人工知能の技術は、日進月歩で進歩を続けています。それと同時に、これまで考えられなかったような倫理的な問題点が次々と浮かび上がってきています。そこで、人工知能の開発や利用に関する指針や基本的な考え方も、時代の変化に合わせて、常に問い直し、より良いものへと磨き上げていく必要があります。

様々な立場の人々が集まり、自由に意見を交わせる場を設けることが大切です。人工知能の専門家、開発に携わる企業、人工知能を利用する市民、そして政策を担う政府など、あらゆる関係者がそれぞれの考えを共有し、共通の認識を作り上げていく必要があります。そうすることで、実際に役立つ指針を作り、人工知能技術が健全に育っていくよう促すことができます。

継続的な対話は、人工知能技術の進歩に欠かせません。例えば、自動運転技術を考えてみましょう。安全性を高めるためには、事故が起きた時の責任の所在を明確にする必要があります。これは、法律の専門家、自動車メーカー、そして実際に自動運転車を使う人々の間で、何度も話し合いを重ねることで、より良い解決策を見つけることができます。

また、人工知能が人の仕事を奪うのではないかという不安もあります。この問題についても、様々な立場の人々が対話を通じて、新しい仕事を生み出す方法や、人々が新しい技術を習得するための支援策などを検討していく必要があります。

人工知能と人間が共に生きる社会を作るためには、絶え間ない対話と改善が不可欠です。技術の進歩だけでなく、社会全体の変化を捉えながら、より良い未来を目指して、共に歩んでいく必要があるのです。

| 課題 | 関係者 | 必要な行動 |

|---|---|---|

| 人工知能の倫理問題 | 人工知能の専門家、開発企業、市民、政府 | 様々な立場の人々が意見を交わし、共通認識を作り上げる |

| 自動運転技術の安全性 | 法律専門家、自動車メーカー、自動運転車利用者 | 事故時の責任所在を明確化するための話し合い |

| 人工知能による雇用への影響 | 様々な立場の人々 | 新しい仕事を生み出す方法や、人々の技術習得支援策を検討 |