ディープフェイク:真実と虚構の境界線

AIを知りたい

先生、「ディープフェイク」って最近よく聞くんですけど、一体どういうものなんですか?

AIエンジニア

いい質問だね。「ディープフェイク」は、すごく精巧な偽物を作る技術のことだよ。例えば、動画で人の顔を別の人と入れ替えたり、実際には言っていないことを言ったように見せかけたりすることができるんだ。

AIを知りたい

まるで映画の特殊効果みたいですね!でも、そんなことが本当にできるんですか?

AIエンジニア

そう、まるで魔法みたいだけど、機械学習という技術を使っているんだ。たくさんのデータを使ってコンピューターに学習させることで、本物そっくりの偽物を作れるようになってきているんだよ。

ディープフェイクとは。

人工知能に関係する言葉である「ディープフェイク」について説明します。ディープフェイクとは、人の手では作れないほど精巧な偽物の動画や画像、音声を作り出す技術のことです。この技術は、機械学習という分野の中でも特に「深層学習」と呼ばれる高度な技術を使って作られています。そして、ディープフェイクという言葉は、この技術を使って作られた偽物の動画や画像、音声そのものを指す場合もあります。

偽造技術の到来

近年、人工知能技術が急速に発展する中で、巧妙な偽造技術が登場し、大きな注目を集めています。この技術は「深層偽造」と呼ばれ、高度な機械学習を用いて動画や画像、音声を精巧に作り変え、まるで現実の出来事のように見せかけることができます。

深層偽造は、娯楽分野での活用など、良い側面も持っています。例えば、映画製作において俳優の過去の映像を再現したり、吹き替え音声を作成したりする際に役立ちます。また、亡くなった方の姿を映像で再現することで、故人の思い出を鮮やかに蘇らせることも可能です。

しかしながら、深層偽造は悪用される危険性も孕んでおり、社会に深刻な影響を与える可能性があります。例えば、著名人の発言を捏造した動画を拡散することで、社会的な混乱を招いたり、個人の評判を傷つけたりする恐れがあります。また、偽の証拠映像を作成することで、犯罪の冤罪を生み出すリスクも存在します。深層偽造技術の高度化は、真実と虚構を見分けることをより困難にしています。

かつては専門家のみが扱えた高度な編集技術は、今では手軽な道具によって誰もが簡単に利用できるようになりました。誰でも偽の情報を作成し、拡散することが可能になったため、情報操作の危険性はかつてないほど高まっています。この状況において、私たち一人ひとりが情報の真偽を見極める目を養うことが不可欠です。情報の出所や内容の信憑性を注意深く確認し、安易に情報を鵜呑みにしないことが大切です。また、メディアリテラシー教育を充実させることで、偽情報を見抜く力を育むことも重要です。深層偽造という新たな脅威に立ち向かうためには、社会全体で協力し、対策を講じていく必要があります。

| 項目 | 内容 |

|---|---|

| 技術名 | 深層偽造 |

| 概要 | 高度な機械学習を用いて動画や画像、音声を精巧に作り変え、まるで現実の出来事のように見せかける技術 |

| メリット |

|

| デメリット・リスク |

|

| 対策 |

|

技術の仕組み

近頃よく耳にするようになった「にせ動画」ですが、これは一体どのように作られているのでしょうか?実は、この背後には「深層学習」と呼ばれる技術が潜んでいます。深層学習とは、人間の脳の仕組みを模倣した技術で、大量の情報を学習することで、まるで人間のように様々なことを理解したり、新しいものを作り出したりすることができるのです。

にせ動画の作成には、特に「生成網」と呼ばれる深層学習の技術が使われています。この生成網は、本物の動画や画像、音声などを大量に学習することで、その特徴を捉えます。例えば、ある人の顔の作りや表情の変化、声の高さや抑揚など、細かい点まで学習していくのです。そして、学習した結果をもとに、まるでその人が本当に話しているかのような、あるいは行動しているかのような、全く新しい偽物の動画や音声などを作り出すことができるのです。

この技術の驚くべき点は、その精度の高さです。日々進化を続ける深層学習によって、偽物の動画や音声は、肉眼では本物と見分けがつかないほど精巧なものになってきています。そのため、私たちが目にする情報が本当に正しいものなのか、それとも偽物なのかを判断することが、ますます難しくなっています。

インターネット上に溢れる情報に惑わされないためには、情報の出所や信憑性を注意深く確認する習慣を身につけることが大切です。情報源が信頼できる機関や報道機関であるか、他の情報源と一致しているかなどを確認することで、偽の情報に騙されるリスクを減らすことができます。また、公式な発表や信頼できる専門家の意見を参考にすることも、正しい情報を見極める上で重要なポイントです。

| 項目 | 内容 |

|---|---|

| にせ動画の技術 | 深層学習(生成網) |

| 深層学習とは | 人間の脳の仕組みを模倣した技術。大量の情報を学習し、人間のように理解や生成を行う。 |

| 生成網の仕組み | 本物の動画、画像、音声を学習し、特徴を捉え、新しい偽物の動画や音声などを生成する。 |

| 精度の高さ | 肉眼では本物と見分けがつかないほど精巧。 |

| 対策 | 情報の出所や信憑性を確認、信頼できる機関や報道機関の情報源の確認、他の情報源との一致確認、公式発表や専門家の意見の参照。 |

悪用の危険性

人工知能技術の急速な発展によって、本物と見分けがつかないほど精巧な偽動画、いわゆる「ディープフェイク」の作成が容易になってきました。これは、様々な分野で革新をもたらす可能性を秘めている一方で、悪用された場合、深刻な脅威となることが懸念されています。

まず考えられるのが、政治への影響です。選挙期間中に、候補者の発言を捏造した動画を拡散することで、有権者の判断を誤らせ、選挙結果を左右する可能性があります。また、実在しない発言によって特定の候補者を中傷し、名誉を傷つけることも容易になります。このような情報操作は、民主主義の根幹を揺るがす危険性があります。

企業活動への悪影響も懸念されます。例えば、企業の代表者が不適切な発言をしているように見せかけた偽動画を公開することで、企業の信用を大きく失墜させることが可能です。また、株価操作を目的とした偽情報の拡散も容易になり、経済的な損失をもたらす可能性があります。

個人への被害も深刻です。ディープフェイクを使った嫌がらせは既に現実のものとなっており、偽造されたわいせつ動画を拡散されることで、被害者の精神は深く傷つけられます。また、偽の証拠を捏造されることで、犯罪の濡れ衣を着せられるといった冤罪被害に遭う可能性も否定できません。

ディープフェイクの悪用は、社会全体の信頼関係を破壊する恐れがあります。何が真実で何が偽物なのかが分からなくなり、人々は情報に対する不信感を募らせるでしょう。このような社会では、健全な議論や情報共有が難しくなり、社会の停滞を招く可能性があります。ディープフェイクの悪用を防ぎ、健全な情報環境を守るためには、技術的な対策だけでなく、法整備や啓発活動など、社会全体での取り組みが不可欠です。

| 悪影響を受ける対象 | 具体的な悪影響 |

|---|---|

| 政治 | ・選挙結果の操作 ・候補者の中傷、名誉毀損 ・民主主義の根幹を揺るがす |

| 企業 | ・企業の信用失墜 ・株価操作による経済的損失 |

| 個人 | ・嫌がらせ、名誉毀損 ・わいせつ動画の拡散 ・冤罪被害 |

| 社会全体 | ・信頼関係の破壊 ・情報に対する不信感の増大 ・健全な議論や情報共有の阻害 ・社会の停滞 |

対策と課題

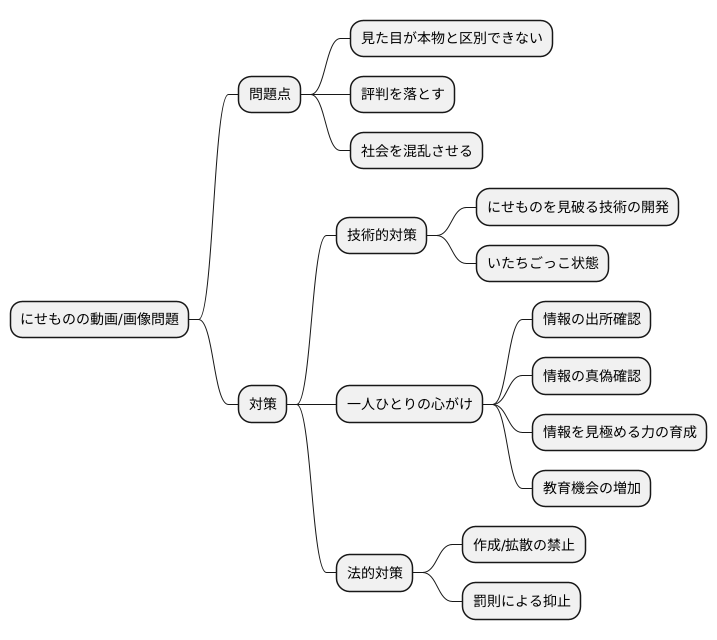

にせものの動画や画像を作る技術が、大きな問題となっています。まるで本物のように見えるため、だまされてしまう人も少なくありません。この技術が悪用されると、人の評判を落とすようなことや、社会全体を混乱させることにつながりかねません。そのため、さまざまな対策が必要です。

まず、にせものを見破る技術の開発が重要です。画像や動画を細かく調べて、作られたものかどうかを判断する技術が研究されています。しかし、にせものを作る技術もどんどん進化しているので、見破る技術も常に改良していく必要があります。まるでいたちごっこをしているような状況です。

技術的な対策だけでなく、私たち一人ひとりの心がけも大切です。インターネットで情報を見る際には、その情報がどこから来たのかを確認する習慣をつけましょう。また、すぐに信じるのではなく、本当に正しい情報なのかどうかをよく考えることも重要です。情報を見極める力を身につけることで、にせものの情報に惑わされにくくなります。学校や地域社会で、情報の見方について学ぶ機会を増やすことも必要です。

さらに、法的な対策も必要です。にせものの動画や画像を作成したり、広めたりすることを禁じる法律を作ることで、悪用を防ぐ効果が期待できます。罰則を設けることで、にせものを作ることをためらわせる力にもなります。

にせものの動画や画像は、私たちの社会にとって大きな脅威です。技術の進歩、一人ひとりの意識改革、そして法律の整備、これらを組み合わせて、被害を防いでいく必要があります。

未来への展望

人の姿を造り出した動画を指す技術は、楽しみや学びといった様々な分野で役立つ可能性を秘めています。例えば、映画作りやゲーム作りでは、より本物に近い映像表現を可能にするでしょう。まるで現実の人物と見分けがつかないほど精巧な映像を作り出すことで、物語の世界観をより深く表現し、見る人に感動を与えることができるはずです。また、学びの場では、歴史上の人物を再現し、まるで生きているかのように授業を行うことで、生徒たちの理解を深める新しい学習方法が生まれるかもしれません。過去の出来事を体感的に学ぶことで、歴史への興味関心を高め、より深い学びに繋がるでしょう。

しかし、このような良い効果を得るためには、使い方を誤ることを防ぐための対策をしっかりと行うことが大切です。人の姿を偽って動画を作ることで、他人を傷つけたり、社会を混乱させたりするようなことが起こる可能性も否定できません。悪意ある使い方から人々を守るためには、技術を作る側、使う側、そして社会全体が協力して、適切なルール作りや倫理的な議論を進めていく必要があるでしょう。どのような使い方が許され、どのような使い方が許されないのか、社会全体で考えていくことが重要です。

私たちは、この新しい技術とどのように付き合っていくべきか、真剣に考える時期に来ています。技術の進歩を止めることはできません。だからこそ、私たちは技術の良い面と悪い面の両方を理解し、正しい使い方を探っていく必要があります。便利な道具も使い方を間違えれば凶器になり得るように、この技術も使い方次第で大きな影響を社会に及ぼします。未来の社会において、人の姿を造り出した動画を作る技術が本当に役立つものとなるよう、知恵を出し合い、より良い未来を築いていく努力が求められています。

| メリット | デメリット | 対策 |

|---|---|---|

|

|

|

真偽を見抜く力

情報があふれる現代社会において、情報の真偽を見抜く力は、私たちが生きていく上で必要不可欠な能力となっています。特に、インターネットやソーシャルメディアの発達により、誰もが手軽に情報を発信、受信できるようになった現代では、真偽不明な情報、さらには意図的に操作された情報が私たちの目に触れる機会が増えています。このような状況下で、情報に踊らされることなく、正しい判断をするためには、情報を見極める目を養うことが重要です。

近年の技術革新は目覚ましく、人工知能を用いた高度な偽造技術が登場しています。例えばディープフェイクと呼ばれる技術は、動画中の人物の顔を別の人物に違和感なく置き換えることが可能です。このような技術を悪用すれば、実在しない人物の発言を捏造したり、実際には起こっていない出来事をあたかも真実のように見せかけることも可能になります。そのため、情報源の信頼性を確認することはもちろんのこと、情報の内容自体にも注意深く目を向ける必要があります。

真偽を見抜く力を養うためには、複数の情報源を比較検討することが有効です。一つの情報源だけを鵜呑みにするのではなく、様々なメディアや機関が発信する情報を比較することで、情報の信憑性を判断することができます。また、その分野の専門家の意見を参考にすることも重要です。専門家は、豊富な知識と経験に基づいて情報を分析し、より正確な判断をすることができます。さらに、感情的な反応に流されず、冷静に情報を分析する習慣を身につけることも大切です。人は感情によって判断が左右されることがあります。特に、ショッキングな情報や、自分の意見と一致する情報に接した際には、客観的な視点を保つように心がけましょう。

情報リテラシー教育の充実も不可欠です。未来を担う子どもたちには、幼い頃から情報の見方や使い方を学ぶ機会を提供する必要があります。学校教育の現場では、メディアリテラシー教育を積極的に取り入れ、情報社会で生き抜くための知識と技能を習得させることが重要です。同時に、家庭や地域社会全体で情報リテラシーを高める取り組みも重要です。子どもたちだけでなく、大人も共に学び続ける姿勢を持つことで、健全な情報社会を実現できるでしょう。

| 課題 | 対策 |

|---|---|

| 情報があふれる現代社会では情報の真偽を見抜く力が必要不可欠。インターネットやソーシャルメディアの発達により、真偽不明な情報や意図的に操作された情報が増えている。 | 情報を見極める目を養うことが重要。 |

| 高度な偽造技術(ディープフェイクなど)により、偽の情報が作られやすくなっている。 | 情報源の信頼性を確認するだけでなく、情報の内容自体にも注意深く目を向ける。 |

| 情報に踊らされることなく正しい判断をすることが難しい。 | 複数の情報源を比較検討する。専門家の意見を参考にする。感情的な反応に流されず、冷静に情報を分析する。 |

| 子どもたちが情報社会で生き抜くための知識と技能を習得する必要がある。 | 情報リテラシー教育の充実。学校教育の現場でメディアリテラシー教育を積極的に取り入れる。家庭や地域社会全体で情報リテラシーを高める取り組みを行う。 |