モデルドリフト:AIモデルの劣化を防ぐ

AIを知りたい

先生、「モデルドリフト」って、AIの性能が悪くなることですよね? なぜ性能が悪くなるんでしょうか?

AIエンジニア

そうだね、AIの性能が悪くなる現象の一つだ。AIは学習したデータに基づいて判断するんだけど、世の中の状況は常に変化していくよね。だから、AIが学習した古いデータでは、今の状況に合わなくなってきて、判断を間違ってしまうんだ。たとえば、5年前の流行の服を参考に新しい服をデザインしても、今は売れないかもしれないよね?それと似たようなものだよ。

AIを知りたい

なるほど。古いデータで判断するから間違いが増えるってことですね。じゃあ、どうすればいいんですか?

AIエンジニア

AIに新しいデータを学習させ続けることが大切なんだ。世の中の変化に合わせて、AIの知識も常に最新の状態にしておく必要がある。そうすることで、AIは正しい判断を下し続け、性能を維持することができるんだよ。

Model Driftとは。

人工知能で使われる「モデルドリフト」という言葉について説明します。人工知能は、データに基づいて作られます。このデータは、人工知能が物事を判断したり、結果を生み出すために使う情報の集まりです。しかし、このデータが新しくならないままになっていると、人工知能の元となる考え方が合わなくなり、性能が悪くなってしまうことがあります。これが「モデルドリフト」です。この現象が起きると、予測の正しさや適切さが落ち、間違った判断が増えてしまいます。モデルドリフトに早く気づいて対策しないと、人工知能だけでなく、その人工知能が使われている実際のアプリや作業全体の信頼性も損なわれる可能性があります。

モデルドリフトとは

機械学習の分野では、予測や判断を行うために、大量のデータを使って訓練された人工知能モデルが広く使われています。これらのモデルは、学習したデータに基づいて未来の出来事を予測したり、適切な行動を決定したりします。学習データは、いわばモデルの知識の源泉であり、モデルの性能を左右する重要な要素です。しかしながら、現実世界は常に変化し続けているため、時間の経過とともに、モデルが学習したデータと現実世界のデータとの間にずれが生じることがあります。この現象は「モデルドリフト」と呼ばれ、モデルの性能低下を引き起こす大きな要因となっています。

モデルドリフトは、まるで古い地図を使って新しい街を探索するようなものです。かつては正確だった地図も、街の構造が変わってしまえば、もはや役に立たなくなってしまいます。同様に、人工知能モデルも、変化する現実世界に適応できなければ、その予測や判断の精度は低下し、誤った結果をもたらす可能性があります。例えば、商品の需要予測モデルが、過去のデータに基づいて学習されているとします。しかし、消費者の嗜好や経済状況が変化した場合、モデルは需要を正確に予測できなくなり、過剰在庫や品切れといった問題を引き起こす可能性があります。また、医療診断モデルが、特定の患者集団のデータで学習されている場合、異なる特性を持つ患者集団に適用すると、誤診につながる可能性があります。

このように、モデルドリフトは様々な分野で深刻な問題を引き起こす可能性があります。そのため、モデルの性能を維持するためには、定期的にモデルを再学習し、最新のデータに適応させることが重要です。さらに、モデルの性能を監視し、ドリフトの兆候を早期に検知する仕組みを構築することも必要です。これにより、モデルの精度を維持し、信頼性の高い予測や判断を実現することができます。

劣化の兆候

人工知能のモデルは、時間の経過とともに性能が低下することがあります。これは劣化と呼ばれ、さまざまな兆候が現れます。最も顕著な兆候の一つは、予測精度の低下です。例えば、未来の出来事を高い精度で予測できていたモデルが、次第に予測を外すようになる、あるいは予測の確実性が揺らぎ始めるといったことが起こります。

また、データの分類の誤りが増えることも、劣化の兆候です。これまで正しく認識できていたデータが、異なるものとして認識されるようになる、あるいは分類の境界線が曖昧になるといった現象が見られます。例えば、猫の画像を正しく認識できていたモデルが、次第に犬の画像と誤認識するようになるといったケースが考えられます。

さらに、予期しない結果や異常値の増加も、劣化を示す重要なサインです。通常では起こり得ない結果が頻繁に現れるようになったり、想定の範囲を大きく超える値が出力されるようになるといったことが起こります。例えば、商品の需要予測モデルにおいて、本来は緩やかな変動であるべき需要が、突発的に大きく増減するといったケースが考えられます。これは、モデルが学習データから逸脱した状況に直面し、適切な処理ができなくなっていることを示唆しています。

具体的な例として、商品の需要予測モデルを考えてみましょう。このモデルは、過去の販売データや季節要因などを学習し、未来の需要を予測します。しかし、現実世界では、消費者の嗜好の変化や競合製品の登場など、様々な要因が需要に影響を与えます。モデルがこれらの変化に追従できなくなると、季節の変化を正しく反映できなくなり、夏に冬の商品の在庫を過剰に抱えたり、逆に冬に必要な商品の在庫が不足したりといった問題を引き起こす可能性があります。

これらの兆候は、人工知能モデルが現実世界とのずれが生じていることを示す重要な警告です。これらの兆候を早期に発見し、モデルの再学習や調整といった適切な対策を講じることで、劣化を防ぎ、モデルの価値を維持することが不可欠です。

| 劣化の兆候 | 説明 | 例 |

|---|---|---|

| 予測精度の低下 | 未来の出来事の予測が外れるようになる、予測の確実性が揺らぎ始める | 高精度で予測できていたモデルが、次第に予測を外すようになる |

| データの分類の誤りの増加 | 正しく認識できていたデータが誤認識される、分類の境界線が曖昧になる | 猫の画像を正しく認識できていたモデルが、犬の画像と誤認識する |

| 予期しない結果や異常値の増加 | 通常では起こり得ない結果が頻繁に現れる、想定の範囲を超える値が出力される | 商品の需要予測で、需要が突発的に大きく増減する |

| 現実世界とのずれ | モデルが学習データから逸脱した状況に直面し、適切な処理ができなくなる | 商品の需要予測モデルが季節の変化を正しく反映できなくなり、在庫管理に問題が生じる(例:夏に冬の商品の在庫を過剰に抱える、冬に必要な商品の在庫が不足する) |

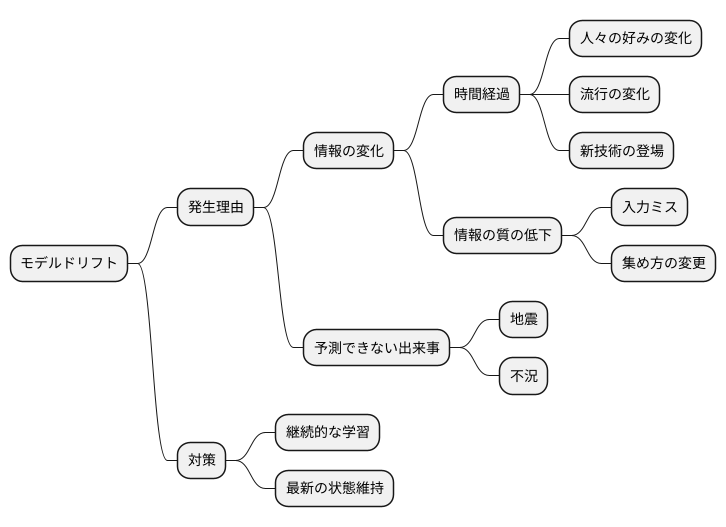

発生の要因

世の中で広く使われている人工知能の予測は、学習した情報に基づいて行われています。しかし、世の中は常に変化しているため、学習した情報が古くなり、予測の精度が下がることがあります。これが「モデルドリフト」と呼ばれる現象です。

モデルドリフトは、さまざまな理由で起こります。最も大きな理由は、時間の流れとともに情報が変わっていくことです。例えば、人々の好みは時代によって変化しますし、流行の商品も常に移り変わっていきます。新しい技術が登場することもあります。このような変化に対応できなければ、人工知能の予測は現実からかけ離れてしまい、モデルドリフトが発生します。

情報の質が下がることも、モデルドリフトの要因となります。情報の入力ミスや、情報の集め方の変更などによって、情報の正しさが損なわれると、人工知能の学習に悪影響を与え、モデルドリフトにつながる可能性があります。情報の精度を保つことは、人工知能の性能維持に不可欠です。

また、地震や不況などの予測できない出来事も、モデルドリフトを引き起こすことがあります。これらの出来事は、情報に大きな変化をもたらし、人工知能の予測を狂わせる可能性があります。例えば、大きな災害が起こると、人々の購買行動は大きく変化し、これまでの予測モデルは役に立たなくなるかもしれません。このような想定外の出来事にも対応できるような、柔軟な人工知能の開発が求められています。つまり、常に変化する世の中に対応し、精度の高い予測を続けるためには、人工知能に新しい情報を継続的に学習させ、常に最新の状態に保つことが重要です。

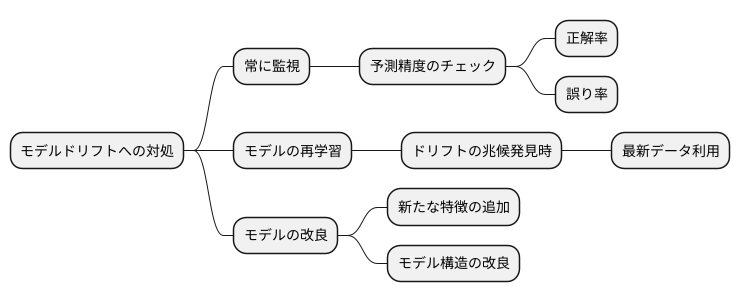

対処方法

予測の正確さが少しずつずれていく「モデルドリフト」は、機械学習モデルを使う上で避けて通れない問題です。この問題に対処するには、常に見守り、モデルを学び直し続けることが大切です。

まず、モデルがどれくらいうまく予測できているかを常にチェックします。例えば、どれくらい正確に予測できているか、あるいは間違った予測がどれくらいあるかといった数値を定期的に記録し、観察します。これは、まるで健康管理のように、モデルの状態変化を早期に見つけるための大切な活動です。

もしもモデルの予測精度が落ちているなど、ドリフトの兆候が見られた場合は、モデルに最新の情報を教え直す必要があります。新しいデータを使ってモデルを再学習させることで、変化した状況にも対応できるようになります。これは、まるで新しい知識を学ぶことで、時代の変化に対応していくのと同じです。

さらに、モデルの精度をもっと上げるためには、新しい視点を加えることも有効です。例えば、これまで見ていなかったデータの特徴を取り入れたり、モデルの構造自体を改良することで、より精度の高い予測が可能になります。これは、様々な経験を積むことで、より的確な判断ができるようになることに似ています。

このように、定期的にモデルを学び直すことは、モデルを常に最新の状態に保ち、ドリフトによる悪影響を少なくするために欠かせません。これは、常に学び続けることで、変化の激しい時代を生き抜く力をつけるのと同じくらい重要です。

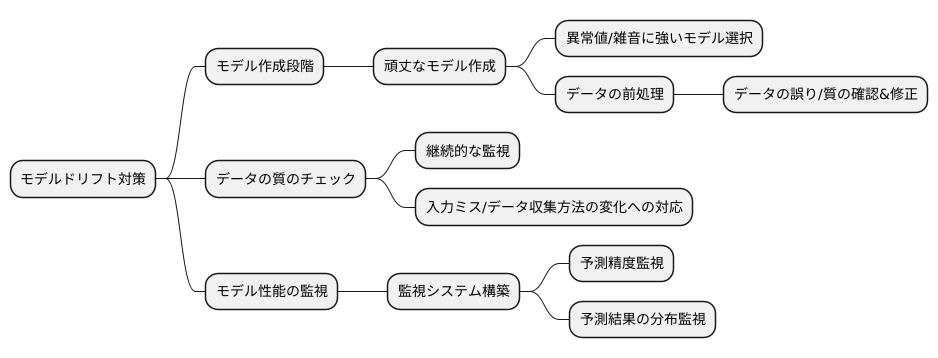

予防策

人工知能モデルの予測精度が時間の経過と共に低下する現象、いわゆるモデルドリフトは、人工知能システムの運用において大きな課題となります。このモデルドリフトをあらかじめ防ぐには、モデルを作る段階から対策をしっかりと行うことが肝心です。

まず、変化に強い、頑丈なモデルを作ることが重要です。モデルが頑丈であれば、ドリフトの影響を少なくすることができます。具体的には、異常な値や雑音に強いモデルを選ぶことが大切です。また、集めたデータに誤りがないか、質が安定しているかを確認し、必要に応じて修正を行う、いわゆるデータの前処理を適切に行うことで、モデルの安定性を高めることができます。

さらに、データの質を常にチェックすることも重要です。入力ミスやデータの集め方の変化によってデータの質が下がってしまうと、モデルドリフトに繋がることがあります。ですから、データの質を継続的に監視し、質の低下を防ぐ必要があります。

加えて、作ったモデルの性能を常に監視する仕組みを作ることも必要です。これは、モデルドリフトの兆候を早期に見つけるために重要です。具体的には、モデルの予測精度や予測結果の分布などを監視することで、ドリフトの兆候をいち早く捉えることができます。

これらの予防策をしっかりと行うことで、モデルドリフトの危険性を減らし、人工知能モデルを長く安定して運用していくことが可能になります。人工知能システムを安定して運用するためには、事前の準備と継続的な監視が欠かせません。

重要性

人工知能システムを長く使い続けるためには、システムの性能が落ちないように気を配ることがとても大切です。この性能の低下は「モデルドリフト」と呼ばれ、正しく対処しないと様々な問題を引き起こします。

モデルドリフトとは、人工知能モデルが学習した時とはデータの性質が変わってしまい、予測の正確さが失われてしまうことです。作ったばかりの頃はきちんと機能していたシステムも、時間の経過とともに周りの環境やデータが変わると、その変化に対応できず、予測が外れやすくなってしまうのです。

もしもこのモデルドリフトを放置してしまうと、システムの信頼性と有効性が損なわれます。例えば、商品の売れ行きを予測するシステムでドリフトが発生すると、将来の需要を正しく予測できなくなり、過剰在庫や品切れを起こしてしまうかもしれません。これは、企業にとっては大きな損失につながります。また、顧客の好みを分析して商品を薦めるシステムでドリフトが起きると、顧客のニーズに合わない商品を薦めてしまい、顧客満足度を低下させる可能性があります。

具体的な例を挙げると、金融機関で融資の審査に人工知能を使う場合を考えてみましょう。もしモデルドリフトが発生すると、本来融資すべきでない人に融資してしまったり、逆に融資すべき人に融資できなかったりする可能性があります。これは、金融機関にとって大きな損失になるだけでなく、融資を必要とする人々にも悪影響を与えます。医療の現場で病気の診断を支援するシステムでも同様です。ドリフトによって誤診が発生すれば、患者の健康を損なう重大な結果につながる可能性があります。

このように、モデルドリフトは様々な場面で深刻な問題を引き起こす可能性があります。だからこそ、モデルドリフトの重要性を理解し、適切な対策を講じる必要があります。常にシステムの性能を監視し、ドリフトの兆候を早期に発見することで、大きな問題を未然に防ぐことができます。そして、必要に応じてモデルを再学習させたり、新しいデータを追加することで、システムの精度を維持し続けることが重要です。

| 問題点 | 影響 | 例 |

|---|---|---|

| モデルドリフト(AIモデルの性能低下) | システムの信頼性と有効性の損失 | 商品の売れ行き予測システム:過剰在庫や品切れ 顧客の好み分析システム:顧客満足度低下 金融機関の融資審査システム:誤った融資判断 医療診断支援システム:誤診 |