説明可能なAI:XAIとは何か?

AIを知りたい

先生、「説明できるAI」ってどういう意味ですか?普通のAIと何が違うんですか?

AIエンジニア

良い質問だね。「説明できるAI」、正式には「説明可能なAI」と言うんだけど、これはAIが出した答えが、なぜそうなるのかを人間にも理解できるように説明してくれるAIのことなんだ。普通のAIは結果しか教えてくれない場合が多いけど、「説明可能なAI」は、その結論に至った理由や過程を説明してくれるんだよ。

AIを知りたい

なるほど。ということは、AIが出した答えが正しいかどうかが分かるってことですね。例えば、病院でAIが診断してくれたときに、その理由が分かれば納得しやすいですね。

AIエンジニア

その通り!まさに医療の分野みたいに、人の命に関わるような場面では特に「説明可能なAI」が重要になってくるんだ。AIの判断が信用できるものなのか、その根拠を知ることで安心してAIを使うことができるようになるんだよ。

XAIとは。

『説明できるAI』つまり『エックスエーアイ』という、AIに関わる言葉について説明します。これは、予測や推定の結果にたどり着くまでの過程を人が理解できるようにした機械学習のモデル、つまりAIそのものを指します。アメリカの国防高等研究計画局の研究から始まった考え方で、AIの予測が人にも分かり、かつ信頼できる技術についての研究を指します。AIがどんな計算をして結果を出したのか分からなければ、たとえ精度が高くても、その予測の根拠が分からなくなってしまいます。これを防ぐために考えられました。例えば、病院で受けた検査結果から、AIが診断や治療方針を示したとしても、その結論を完全に信頼する人は少ないでしょう。判断の過程が分からず、いきなり結論だけを提示されても、自分の健康や命に関わる医療の分野では、多くの人が抵抗を感じてしまいます。そこで、予測の根拠を分かりやすく説明できるモデルとして広まりつつあります。

説明可能なAIの登場背景

近ごろ、人工知能は様々な分野でめざましい発展をとげ、暮らしにも深く入り込みつつあります。買い物をする時、病気の診察を受ける時、車に乗る時など、様々な場面で人工知能の恩恵を受けていることに気づかれる方も多いのではないでしょうか。しかし、従来の人工知能は、高度な計算によって結論を導き出すものの、その思考の道筋が人間には理解しづらいという問題を抱えていました。例えるなら、複雑な計算式を解く魔法の箱のようなものです。答えはすぐに出てきますが、どのような計算が行われているのか、なぜその答えになるのかは全くわかりません。このような、いわゆる「ブラックボックス」問題は、人工知能への信頼を損なう大きな要因となっていました。

例えば、健康診断で人工知能が病気を指摘しても、その理由がわからなければ、医師も患者も安心してその判断を受け入れることはできません。車の自動運転で、人工知能が急ブレーキをかけても、なぜブレーキをかけたのかがわからなければ、運転者は不安を感じるでしょう。また、融資の審査で人工知能が却下した場合、その理由がわからなければ、融資を申し込んだ人は納得できないばかりか、改善点もわかりません。

そこで、人工知能の判断の道筋を人間が理解できるようにする「説明可能な人工知能」、いわゆる説明可能な人工知能の必要性が高まってきました。説明可能な人工知能は、人工知能のブラックボックス問題を解決し、人工知能の信頼性と透明性を高めるための重要な技術として注目を集めています。説明可能な人工知能によって、人工知能がどのように考え、どのような根拠で判断を下したのかがわかるようになれば、私たちは安心して人工知能を利用し、その恩恵をより享受できるようになるでしょう。人工知能が社会に受け入れられ、より良い社会を実現するためにも、説明可能な人工知能の開発と普及が不可欠と言えるでしょう。

| 従来の人工知能 | 説明可能なAI |

|---|---|

| 高度な計算で結論を出すが、思考過程は不明瞭(ブラックボックス) | 判断の道筋を人間が理解できるようにする |

| 信頼性を損なう要因となる | AIの信頼性と透明性を高める |

| 例:医療診断で理由が不明なまま病気を指摘される | 例:医療診断で、AIがどのような根拠で診断したかがわかる |

| 例:自動運転で、なぜ急ブレーキがかかったのか不明 | 例:自動運転で、ブレーキがかかった理由がわかる |

| 例:融資却下の理由が不明 | 例:融資却下の理由が明確に提示される |

説明可能なAIの定義

説明可能な人工知能、つまり説明可能なAIとは、略してXAIと呼ばれ、その名の通り、人が分かるように説明できる人工知能のことを指します。これまでのAIは、膨大な量の情報を複雑な計算によって処理し、結果を導き出す仕組みでした。しかし、その計算の過程は非常に難解で、まるで中身の見えない黒い箱のようでした。そのため、AIがどのように考えて答えを出したのかを人が理解することは困難でした。この、AIの思考過程が分からない状態を、ブラックボックス化と呼びます。

XAIは、このブラックボックス化したAIの問題点を解決するために開発されました。XAIは、結果だけでなく、その結果に至るまでの道筋を明らかにします。例えば、画像認識AIが「これは猫です」と判断した場合、XAIは「耳の形」「目の形」「ひげ」といった、猫だと判断した根拠を具体的に示してくれます。また、AIが特定の行動を推奨する場合も、XAIはなぜその行動が最適なのかを論理的に説明することができます。このように、AIの判断過程を可視化したり、論理的な説明を提供することで、人はAIの判断を理解し、信頼することができるようになります。

XAIは、様々な場面での活用が期待されています。例えば、医療の現場では、AIが診断を補助する際に、その診断根拠が説明できることで、医師の診断をより確かなものにすることができます。金融の分野では、AIが融資の判断をする際に、その判断根拠を説明することで、顧客の理解と納得を得ることができます。このように、XAIは、AIの透明性を高め、人からの信頼を得ることで、AIのより広い普及と社会への貢献につながると考えられています。

| 項目 | 内容 |

|---|---|

| 説明可能なAI(XAI)とは | 人が理解できるように説明できるAI |

| 従来のAIの問題点 | 複雑な計算過程がブラックボックス化しており、AIの思考過程が理解できない。 |

| XAIの目的 | AIのブラックボックス化の解決 |

| XAIの特徴 | 結果だけでなく、結果に至るまでの道筋(根拠)を明らかにする。 |

| XAIの例(画像認識) | 「猫」と判断した根拠として「耳の形」「目の形」「ひげ」などを示す。 |

| XAIのメリット | AIの判断過程を可視化・説明することで、人がAIの判断を理解し、信頼できるようになる。 |

| XAIの活用例(医療) | AIの診断根拠を説明することで、医師の診断をより確かなものにする。 |

| XAIの活用例(金融) | AIの融資判断根拠を説明することで、顧客の理解と納得を得る。 |

| XAIの将来性 | AIの透明性を高め、信頼を得ることで、AIの普及と社会貢献につながる。 |

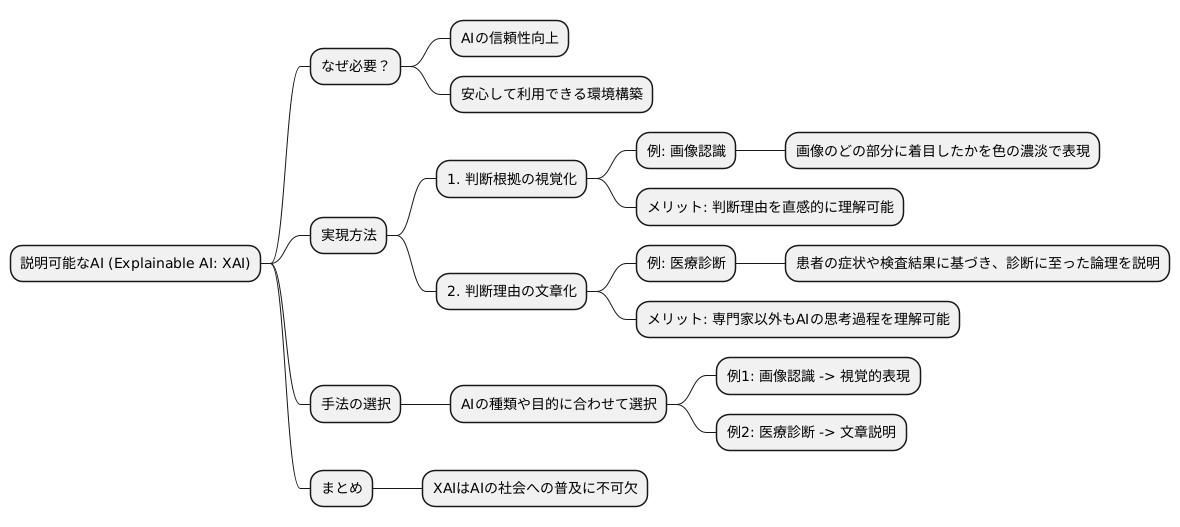

説明可能なAIの仕組み

人工知能がどのように結論に至ったのか、その過程を人間が理解できるようにする技術、説明可能な人工知能、いわゆる説明可能なAIについて解説します。説明可能なAIは、その仕組みを明らかにすることで、人工知能の信頼性を高め、安心して利用できる環境を築くために重要な役割を担っています。

説明可能なAIを実現するための方法は様々ですが、大きく分けて二つの考え方に基づいています。一つは、判断の根拠を視覚的に示す方法です。例えば、画像認識の分野では、人工知能が画像のどの部分に着目したのかを色の濃淡で表現した図を使って示すことがあります。この図を見ることで、人工知能が注目した場所が一目で分かり、判断の理由を直感的に理解することができます。

もう一つの考え方は、判断の理由を文章で説明する方法です。例えば、医療診断の分野では、患者の症状や検査結果に基づいて、人工知能がどのような論理で診断に至ったのかを、人間が理解しやすい言葉で説明するシステムが開発されています。これは、人工知能の思考過程を順を追って説明することで、専門家ではない人にも理解できるようにする試みです。

これらの手法は、人工知能の種類や目的に合わせて適切な方法が選ばれます。例えば、画像認識のように視覚的な情報が重要な場合は、視覚的な表現方法が適しています。一方、医療診断のように複雑な論理に基づく判断が必要な場合は、文章による説明が有効です。このように、状況に応じて最適な方法を選ぶことで、人工知能の判断過程をより分かりやすく説明することができます。そして、説明可能なAIの技術は、人工知能が社会に受け入れられ、より広く活用されるために不可欠なものと言えるでしょう。

説明可能なAIの応用事例

説明できる人工知能は、様々な分野で応用が期待されています。

医療の分野では、病気の診断の補助や治療方針を決める際に役立つと考えられています。例えば、レントゲン写真から病気を診断する際に、人工知能がどのように判断したのかを説明することで、医師の判断を支え、より的確な診断を助けます。また、患者さんにとって、人工知能による診断の過程が理解しやすいため、治療方針への納得感も高まり、医療全体の質の向上に繋がることが期待されます。

お金に関する分野でも、融資の審査や不正なお金の動きを見つける際に、説明できる人工知能が役立ちます。従来、融資の可否はブラックボックス化されている部分が多く、利用者にとって分かりにくいものでした。しかし、人工知能が判断した理由が分かれば、審査の透明性が高まり、利用者からの信頼を得ることに繋がります。また、不正なお金の動きをいち早く見つけることで、金融機関の安全性を高めることにも繋がります。

車の自動運転技術においても、説明できる人工知能の活用が期待されています。自動運転中は、様々な状況に応じて適切な判断をしなければなりません。人工知能がどのような根拠で判断したのかが分かれば、システムの安全性向上に役立ちます。例えば、急ブレーキをかけた理由が「歩行者を検知したため」と分かれば、システムへの信頼性も高まります。さらに、事故が起きた場合でも、原因究明が容易になり、責任の所在を明確化することにも役立ちます。

このように、説明できる人工知能は、様々な分野で人工知能の利用を進め、私たちの社会をより良くする力を持っています。

| 分野 | 説明できるAIの活用例 | メリット |

|---|---|---|

| 医療 | 病気の診断補助、治療方針決定 | 医師の判断支援、患者の納得感向上、医療全体の質向上 |

| 金融 | 融資審査、不正検知 | 審査の透明性向上、利用者からの信頼向上、金融機関の安全性向上 |

| 自動運転 | 状況判断、行動決定 | システムの安全性向上、信頼性向上、事故原因究明の容易化 |

説明可能なAIの将来展望

説明可能な人工知能、すなわち説明可能なAIは、まだ研究開発の途上にある技術ですが、これからの発展に大きな期待が寄せられています。現在の人工知能は、まるで魔法の箱のように、入力に対して出力を返しますが、その思考過程は私たち人間には理解しにくいものです。説明可能なAIは、この魔法の箱を開き、人工知能がどのような理由でその結論に至ったのかを私たちに分かるように説明してくれる技術です。

研究開発がさらに進み、より高度な説明能力を持つ説明可能なAIが実現すれば、人工知能が活躍できる場はさらに広がり、社会における人工知能の役割は今よりもずっと重要になるでしょう。特に、人間の決断に深く関わる分野、例えば医療における診断支援や、司法における判決の判断材料、あるいは自動運転技術による安全な運転支援などにおいては、説明可能なAIの導入は必要不可欠となるでしょう。なぜなら、人の命や人生に関わる重要な判断において、人工知能がなぜその判断に至ったのかを理解することは、信頼性と安全性を確保するために極めて重要だからです。

説明可能なAIは、人工知能と人間が互いに協力してより良い社会を作るための鍵となる技術と言えるでしょう。人工知能がどのように考えているのかを理解することで、私たちは人工知能をより信頼し、より効果的に活用できるようになります。また、人工知能の判断に誤りがあった場合でも、その理由を理解することで修正を行い、より精度の高い人工知能を開発していくことができます。

今後、倫理的な側面も踏まえながら、説明可能なAIの研究開発を進めていくことが重要です。人工知能の信頼性を高め、社会に受け入れられるようにするためには、人工知能がどのように判断しているのかを透明化し、説明責任を果たせるようにする必要があります。より洗練された説明能力を持つ説明可能なAIが実現することで、人工知能は私たちの暮らしをより豊かに、そして安全なものにしてくれると期待されています。説明可能なAIは、人工知能と人間が共存し、共に発展していく未来を築く上で、なくてはならない存在となるでしょう。

| 項目 | 内容 |

|---|---|

| 説明可能なAIとは | 人工知能の思考過程を人間に理解できるように説明する技術 |

| 現状 | 研究開発途上 |

| 将来の期待 | 人工知能の活躍の場を広げ、社会における役割をより重要にする |

| 重要となる分野 | 医療診断支援、司法判断材料、自動運転技術 |

| 必要性 | 人の命や人生に関わる判断における信頼性と安全性の確保 |

| メリット | AIへの信頼向上、効果的な活用、誤りの修正と精度向上 |

| 今後の課題 | 倫理的側面を踏まえた研究開発、AIの透明化と説明責任 |

| 将来展望 | より豊かな暮らしと安全性の向上、人間とAIの共存と発展 |

説明可能なAIと倫理

説明できる人工知能は、技術的な進歩と同じくらい倫理的な側面も大切です。この技術は、人工知能の思考過程を明瞭にすることで、偏見や不公平な判断がないかを確かめる手段となります。これは、人工知能がみんなにとって公平で公正であることを保証するために欠かせません。

たとえば、人工知能が融資の審査を行う場面を考えてみましょう。従来の、思考過程がわからない人工知能では、なぜ融資が否決されたのか理由がわかりませんでした。しかし、説明できる人工知能であれば、その理由を明確に示すことができます。例えば、「収入が基準に満たないため」や「過去の返済履歴に問題があるため」といった具体的な理由が提示されることで、利用者は納得感を得ることができ、再審査の申請や生活改善への取り組みといった対応策を検討することができます。

また、説明できる人工知能は、人工知能を使う人たちの責任を明確にする上でも重要です。人工知能の判断によって損害が生じた場合、その理由を理解し、しかるべき対応をする必要があります。説明できる人工知能は、原因究明と責任の所在を明らかにする役割を果たします。

さらに、説明できる人工知能は、人工知能の倫理的な活用を促し、人工知能と人間が共に生きる社会を作るための土台となる技術と言えるでしょう。人工知能を作る人や使う人は、説明できる人工知能の倫理的な側面にしっかり気を配り、責任ある人工知能の活用を進める必要があります。人工知能が社会にとって有益な存在であり続けるためには、技術的な発展だけでなく、倫理的な配慮が不可欠です。人工知能と人間がより良い未来を築くために、私たちは共に協力していく必要があるでしょう。

| 説明できるAIの利点 | 具体例 | 意義 |

|---|---|---|

| 公平性の確保 | 融資審査で、却下理由を明確に提示(例:収入不足、返済履歴の問題) | 利用者の納得感向上、再審査申請や生活改善の促進 |

| 責任の明確化 | AIの判断による損害発生時の原因究明と責任所在の明確化 | 責任あるAI活用の促進 |

| 倫理的な活用促進 | AIの思考過程を明瞭化し、倫理的な判断を可能にする | AIと人間が共存する社会の基盤構築 |