アルゴリズムバイアス:公平性の落とし穴

AIを知りたい

「アルゴリズムバイアス」って、何だか難しそうですね。具体的にどんなものか、教えてもらえますか?

AIエンジニア

そうですね。「アルゴリズムバイアス」とは、機械学習のプログラムを作る際に、偏った情報で学習させてしまうことで、そのプログラムが偏った答えを出すようになってしまうことを言います。例えば、ある動物を当てるプログラムを作るとして、猫の写真ばかりを見せて「これは猫です」と教え込んだとします。

AIを知りたい

はい、猫の写真ばかり見せて学習させたのですね。それで?

AIエンジニア

そうすると、そのプログラムは、犬や他の動物を見せても「猫」と答えてしまう可能性が高くなります。このように、学習させる情報に偏りがあると、プログラムの答えにも偏りが出てしまう。これが「アルゴリズムバイアス」です。

アルゴリズムバイアスとは。

人工知能に関する言葉である「計算手順の偏り」について説明します。計算手順の偏りとは、偏った学習データを与えたことで、機械学習の計算手順が偏った結果を覚えてしまうことを指します。

アルゴリズムバイアスとは

計算手順の偏りとは、人工知能や機械学習の計算手順が、ある特定の集団に対して不公平な結果をもたらす現象を指します。これは、計算手順が学ぶ情報に偏りがある場合に起こり、結果として現実社会の差別や不平等をそのまま映し出し、あるいはより大きくしてしまう恐れがあります。

例えば、ある会社で社員を選ぶ計算手順が過去の採用情報をもとに学習したとします。もし過去の採用活動において男女の差別があった場合、その計算手順も女性を不利に扱うようになるかもしれません。また、犯罪予測システムで、ある地域での犯罪発生率が高いという過去の情報に基づいて学習した場合、その地域に住む人々を犯罪者予備軍のように扱ってしまう可能性も考えられます。このように、計算手順の偏りは公平性、透明性、説明責任といった倫理的な問題を投げかけるだけでなく、社会的な信頼の低下や法律上の問題にもつながる可能性があるため、その影響を理解し、適切な対策を講じる必要があります。

計算手順の偏りは、単に技術的な問題ではなく、社会的な問題でもあります。なぜなら、計算手順は様々な場面での決定に利用されるようになってきており、人々の暮らしに大きな影響を与えるからです。例えば、融資の審査、就職活動、学校の選抜など、人生を左右するような重要な決定に計算手順が用いられるようになっています。もしこれらの計算手順に偏りがあると、特定の人々が不当に不利な扱いを受けることになりかねません。

計算手順の偏りは、私たちが目指すべき公平で公正な社会の実現を妨げる可能性があるため、重大な問題として認識し、真剣に取り組む必要があります。計算手順が倫理的で責任ある方法で作られ、使われるようにするためには、開発者、利用者、政策を決める人など、あらゆる立場の人々が協力して、計算手順の偏りの問題に取り組む必要があります。また、計算手順の偏りの問題は、技術的な解決策だけでなく、社会全体の意識改革も必要とする複雑な問題です。私たちは、計算手順の偏りが生まれる仕組みを理解し、その影響をできるだけ小さくするための対策を考え、実行していく必要があります。

| 問題点 | 具体例 | 影響 | 対策 |

|---|---|---|---|

| 計算手順の偏り |

|

|

|

バイアスの種類

情報の偏り、いわゆるバイアスは、様々な種類があり、仕組みも複雑です。この偏りは、機械学習のモデルを作る際に用いる学習内容に含まれてしまったり、その作り方に潜んでしまったりします。いくつか例を挙げながら、詳しく見ていきましょう。

まず、「代表性の偏り」は、学習内容に特定の特徴を持つ情報が過剰に含まれている場合に起こります。例えば、ある商品の購入履歴を学習させる際に、特定の年齢層のデータばかりが多いと、その商品を好むのはその年齢層だけだと機械が誤って学習してしまう可能性があります。これは、学習内容全体を正しく表していない情報に偏っていることが原因です。偏りのない多様な情報を学習させることが重要です。

次に、「欠落の偏り」は、特定の特徴を持つ情報が学習内容に不足している場合に起こります。例えば、特定の地域の情報が不足していると、その地域の実情を反映しない予測をしてしまう可能性があります。不足している情報を補完する、あるいはその不足を考慮したモデルを作る工夫が必要です。

さらに、「測定の偏り」は、情報の測定方法自体に問題がある場合に起こります。例えば、アンケート調査で質問の仕方が適切でないと、正しい意見を集められない場合があります。これは、測定方法の正確さを確認し、必要に応じて修正することが大切です。

また、「主観の偏り」は、開発者の個人的な考え方が学習内容やモデルに反映されてしまう場合に起こります。無意識のうちに特定の考え方に基づいたモデルを作ってしまうと、偏った結果を生み出す可能性があります。客観的な視点を持つこと、多様な意見を取り入れることが重要です。

これらの偏りは、単独で現れることもあれば、複数組み合わさってより複雑な問題を引き起こすこともあります。それぞれの偏りの種類と仕組みを理解することで、適切な対策を講じることが可能になります。様々な角度から偏りをチェックし、より正確で公正な結果を得られるように工夫していく必要があります。

| バイアスの種類 | 説明 | 例 | 対策 |

|---|---|---|---|

| 代表性の偏り | 学習内容に特定の特徴を持つ情報が過剰に含まれている場合に起こる | 特定の年齢層の購入履歴データばかりが多い場合 | 偏りのない多様な情報を学習させる |

| 欠落の偏り | 特定の特徴を持つ情報が学習内容に不足している場合に起こる | 特定の地域の情報が不足している場合 | 不足している情報を補完する、不足を考慮したモデルを作る |

| 測定の偏り | 情報の測定方法自体に問題がある場合に起こる | アンケート調査で質問の仕方が適切でない場合 | 測定方法の正確さを確認し、必要に応じて修正する |

| 主観の偏り | 開発者の個人的な考え方が学習内容やモデルに反映されてしまう場合に起こる | 無意識のうちに特定の考え方に基づいたモデルを作ってしまう場合 | 客観的な視点を持つ、多様な意見を取り入れる |

バイアスの影響

計算手順に潜む偏りは、様々な場面で深刻な問題を引き起こし、社会全体の公平性に大きな影響を与える可能性があります。例えば、仕事の選考に計算手順を用いる場合を考えてみましょう。もしその手順に偏りがあれば、特定の属性を持つ人、例えば性別や出身地などによって、不当に不利な評価を受けるかもしれません。これは、能力のある人が機会を逃してしまうばかりか、組織全体の多様性を損なうことにも繋がります。

また、犯罪の発生を予測する計算手順にも同様の問題が潜んでいます。もし偏りがあれば、特定の地域や人種集団が過剰に取り締まりの対象となる可能性があります。これは、偏見に基づく不当な扱いを招き、更には社会の分断を深める危険性も孕んでいます。犯罪を未然に防ぐという本来の目的とは裏腹に、特定の人々に対する不信感を増幅させてしまう恐れがあるのです。

お金を貸すかどうかの審査にも、計算手順が用いられることがあります。もしこの手順に偏りがあれば、特定の属性を持つ人が融資を受けにくくなる可能性があります。これは、事業を始めたい人や家を買いたい人にとって大きな障壁となり、経済的な格差を拡大させる要因になりかねません。公平な機会が提供されなければ、社会全体の活力を失ってしまう可能性があります。

このように、計算手順に潜む偏りは、社会の様々な場面で不平等や差別を助長する可能性があり、その影響は個人だけでなく社会全体に及びます。計算手順は便利な道具ですが、使い方を誤れば大きな害悪をもたらす可能性があることを忘れてはなりません。偏りのない公平な計算手順を作るためには、開発段階から注意深く検証し、常に改善していく必要があります。計算手順が社会にとって真に有益なものとなるよう、私たちは継続的に努力していく必要があります。

| 場面 | 影響 | 結果 |

|---|---|---|

| 仕事の選考 | 特定の属性の人材が不当に不利な評価を受ける | 機会損失、組織の多様性損失 |

| 犯罪発生予測 | 特定の地域・人種集団が過剰に取り締まりの対象となる | 偏見に基づく不当な扱い、社会の分断 |

| 融資審査 | 特定の属性の人が融資を受けにくくなる | 経済格差の拡大 |

バイアスへの対策

情報処理の仕組みの中に潜む偏りを正すには、様々な方法を組み合わせる必要があります。これは、技術的な工夫と、社会全体の意識の変化、両方が必要となる課題です。

まず、技術的な面では、学習に使う情報の偏りを直す技術を開発することが大切です。偏りのない、バランスの取れた情報を用いることで、偏った結果が出ないようにすることができます。また、偏りを自動的に見つける道具を作ることも重要です。このような道具を使えば、情報処理の仕組みに潜む偏りを早期に見つけ、修正することができます。さらに、情報処理の仕組みがどのように動いているのかを分かりやすく示すことも大切です。仕組みが透明であれば、どこに偏りが潜んでいるのかを簡単に見つけることができます。

社会的な面では、情報処理の仕組みを作る人たちに、倫理的な考え方についての教育を行うことが重要です。倫理的な考え方を持つことで、偏りのない仕組みを作ることができます。また、情報処理の仕組みを使う際の手引きを作ることも必要です。利用者側が適切に仕組みを使うことで、偏った結果が生じるのを防ぐことができます。情報処理の仕組みの影響を受ける人々の意見を聞くための場を設けることも重要です。様々な立場の人々の意見を聞くことで、偏りが生じないように配慮することができます。

情報処理の仕組みに潜む偏りを正すには、一つの方法だけでは不十分です。様々な方法を組み合わせ、多角的に取り組む必要があります。技術的な進歩と社会全体の意識の変化を組み合わせることで、偏りの影響をできるだけ小さくし、誰もが平等な社会を実現することができます。情報処理技術は日々進歩しており、新しい偏りが生まれる可能性もあります。そのため、常に新しい技術や知識を学び、対策をより良いものにしていく必要があります。また、社会の変化にも合わせて対策を変えていく必要があります。絶え間ない努力を続けることが、偏りのない、公正な社会を作るために不可欠です。

| 対策 | 具体例 |

|---|---|

| 技術面 | 学習データの偏りを修正する技術開発 |

| 偏りを自動検出するツール開発 | |

| 情報処理機構の動作を透明化 | |

| 社会面 | 開発者への倫理教育 |

| 利用者向けガイドライン作成 | |

| 影響を受ける人々からの意見収集 |

今後の展望

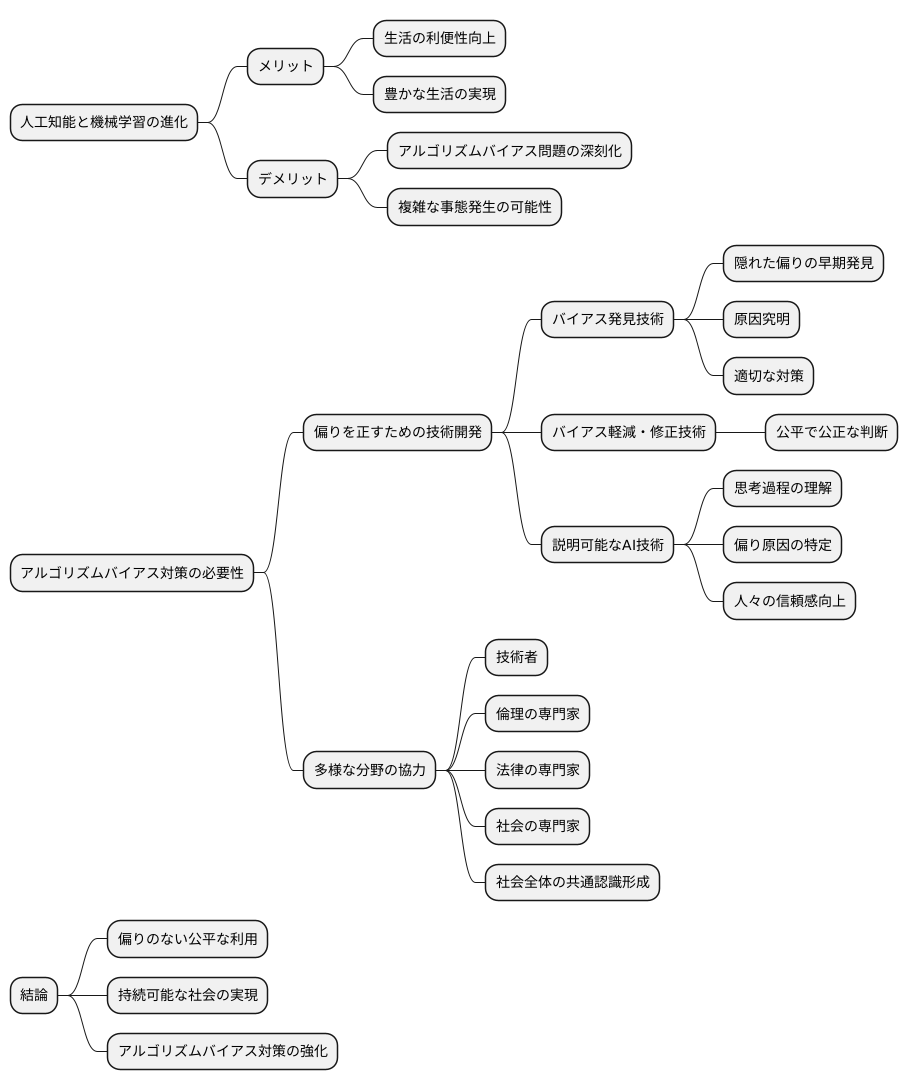

人工知能や機械学習は、まるで生き物のように日々進化を続け、私たちの暮らしの中に深く入り込みつつあります。今後、この技術はさらに発展し、私たちの生活はより便利で豊かなものになるでしょう。しかし、それと同時に、人工知能が持つ偏り、つまりアルゴリズムバイアスの問題は、より複雑化し、深刻な事態を引き起こす可能性も秘めています。そのため、人工知能技術の開発と同時に、バイアスへの対策を強化していく必要があります。

人工知能の偏りを正すためには、まずバイアスを正確に見つける技術の開発が重要です。隠れた偏りをいち早く発見し、その原因を探ることで、適切な対策を立てることができます。同時に、発見された偏りを軽減するための技術開発も必要です。人工知能が公平で公正な判断を下せるよう、偏りを修正する技術の開発が急務です。さらに、人工知能の思考過程を分かりやすく説明できる技術も重要になります。人工知能がどのように判断を下したのかを理解することで、偏りが生じる原因を特定しやすくなり、人々の信頼感も高まります。

アルゴリズムバイアスの問題は、技術的な側面だけでなく、倫理的な側面も持ち合わせています。そのため、技術者だけでなく、倫理の専門家、法律の専門家、社会の専門家など、様々な分野の人々が協力し、議論を深め、社会全体の共通認識を形成していくことが不可欠です。人工知能技術が社会にとって真に有益なものとなるためには、偏りのない公平な利用が不可欠です。私たちは、アルゴリズムバイアスの問題に真剣に向き合い、持続可能な社会を実現するために貢献していく必要があります。これからの技術発展を見据えながら、アルゴリズムバイアスへの対策をより一層強化していくことが、私たちに与えられた重要な使命と言えるでしょう。