ADAM:最適化の賢者

AIを知りたい

先生、ADAMの説明で『勾配の小さい方向にもスムーズに更新が可能』とありますが、どうして勾配が小さい方向にスムーズに更新できるのですか?

AIエンジニア

いい質問だね。RMSpropで使われているvの項が関係しているんだ。vは勾配の二乗和を蓄積していくので、勾配が小さい成分ほど、その二乗和も小さくなる。そして、パラメータ更新時に勾配を√vで割ることによって、勾配の小さい成分ほど相対的に大きな値になる。これが勾配の小さい方向への更新を後押しするんだ。

AIを知りたい

なるほど、勾配の二乗和が小さいほど、割った結果が大きくなるので、更新しやすくなるんですね。でも、もし勾配がずっと0だったら、0で割ることになってしまって更新できないんじゃないですか?

AIエンジニア

鋭い指摘だね。実際には、√vにとても小さい値(数式ではε)を足してから割ることで、0で割るという事態を回避しているんだ。だから、勾配が0でも小さな値で割ることになるので、更新は可能になるんだよ。

ADAMとは。

人工知能で使われる『アダム』という用語について説明します。アダムは、勢いと揺れ幅の調整を組み合わせた最適化の方法です。パラメータ(色々な値)を更新する式は画像の通りで、勢いに関する部分と、揺れ幅に関する部分が含まれています。この仕組みにより、変化の少ない方向にも滑らかに値を更新でき、少なくとも学習は進むので、最初に試すのに向いています。

はじめに

機械学習は、まるで人間の学習のように、与えられた情報から規則やパターンを見つけ出す技術です。この学習過程で重要な役割を担うのが最適化アルゴリズムです。最適化アルゴリズムは、学習の効率と精度を大きく左右する、いわば学習の道案内人と言えるでしょう。数ある道案内人の中でも、ADAMは高い性能と使いやすさで、多くの研究者や技術者に選ばれています。

ADAMは、まるで過去の経験と現在の状況を踏まえて最適な判断を下す賢者のように、効率的に学習を進めます。具体的には、過去の勾配の情報を蓄積し、それを利用することで、より適切な学習の方向へと導きます。また、現在の勾配の情報も考慮に入れることで、局所的な最適解に陥ることなく、より良い解へとたどり着くことができます。

ADAMの大きな利点の一つは、調整すべき設定項目が少ないことです。他のアルゴリズムでは、学習率などのパラメータを適切に設定する必要がありますが、ADAMは自動的に調整を行うため、初心者でも扱いやすいという特徴があります。さらに、様々な種類の機械学習モデルに適用可能であり、画像認識、自然言語処理など、幅広い分野で活躍しています。

このように、ADAMは過去の経験と現在の状況を巧みに組み合わせ、最適な学習の道を切り開く、優れた最適化アルゴリズムです。その使いやすさと高い性能から、今後も機械学習の発展に大きく貢献していくことでしょう。この手軽さと賢さを兼ね備えたADAMを、ぜひあなたの学習にも取り入れてみてください。

| 項目 | 説明 |

|---|---|

| 機械学習 | 与えられた情報から規則やパターンを見つけ出す技術 |

| 最適化アルゴリズム | 学習の効率と精度を左右する重要な要素 |

| ADAM | 高性能で使いやすい最適化アルゴリズム |

| ADAMの特徴 | 過去の勾配情報と現在の勾配情報を活用 自動調整機能で初心者にも扱いやすい 様々な機械学習モデルに適用可能 |

| ADAMの利点 | 調整すべき設定項目が少ない 様々な分野で活用可能 |

| ADAMの将来性 | 機械学習の発展に大きく貢献 |

二つの技を織り交ぜて

二つの技を織り交ぜることで、より早く、より確かな学習を実現する方法があります。それは、まるで二つの長所を持つ技を組み合わせるようなものです。その技の名前は「アダム」と言い、二つの優れた技、「モーメンタム」と「アールエムエスプロップ」の良さを合わせています。

まず、「モーメンタム」は、過去の動きの情報を記憶することで、学習の向きを安定させ、揺れを抑える働きをします。例えるなら、勢いよく進む球が坂道を転がる様子を思い浮かべてください。球は勢いがあるため、小さな凸凹に影響されずに、スムーズに坂を下っていきます。「モーメンタム」もこれと同じように、過去の動きの情報を考慮することで、学習がスムーズに進み、最適な解へとたどり着きやすくなります。

次に、「アールエムエスプロップ」は、過去の動きの大きさの記録を用いて、学習の歩幅を調整する働きをします。過去の動きの大きさを考慮することで、小さな動きの方向にも適切な歩幅で進むことができます。これは、地図上で目的地を目指す際に、地形に合わせて歩幅を変えることと似ています。平坦な道では大きな歩幅で進めますが、険しい道では小さな歩幅で慎重に進みます。「アールエムエスプロップ」も同様に、過去の動きの大きさに合わせて学習の歩幅を調整することで、より効率的に最適な解へと近づきます。

「アダム」は、これらの二つの技、「モーメンタム」の安定性と「アールエムエスプロップ」の効率性を組み合わせることで、より速く、より確実に学習を進めることができます。まるで二つの技を織り交ぜて、より強力な技を生み出したかのようです。これにより、様々な課題に対して、より効果的な学習を行うことが可能になります。

| 技名 | 特徴 | イメージ |

|---|---|---|

| モーメンタム | 過去の動きの情報を記憶し、学習の向きを安定させ、揺れを抑える。 | 勢いよく進む球が坂道を転がる様子。小さな凸凹に影響されずにスムーズに坂を下る。 |

| アールエムエスプロップ | 過去の動きの大きさの記録を用いて、学習の歩幅を調整する。 | 地図上で目的地を目指す際に、地形に合わせて歩幅を変える。平坦な道では大きな歩幅、険しい道では小さな歩幅。 |

| アダム | モーメンタムの安定性とアールエムエスプロップの効率性を組み合わせ、より速く、より確実に学習を進める。 | 二つの技を織り交ぜて、より強力な技を生み出したかのよう。 |

更新式の詳細

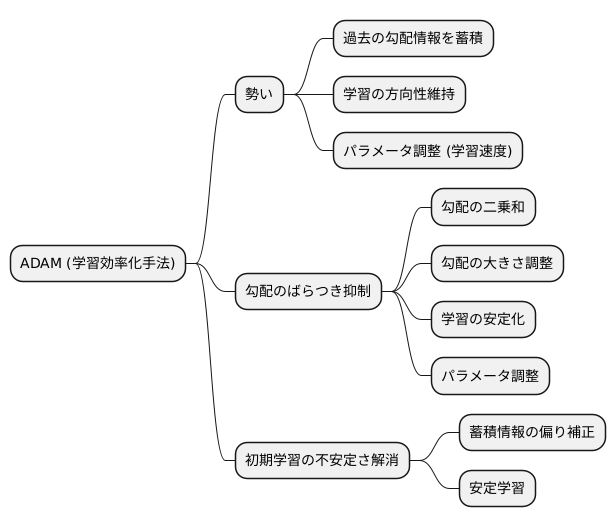

学習の効率を高める手法の一つに、ADAMと呼ばれる更新式があります。この更新式は、これまでの勾配情報をうまく利用することで、より適切な学習を実現します。ADAMは、大きく分けて二つの要素から成り立っています。一つは「勢い」を考慮する要素、もう一つは勾配のばらつきを抑える要素です。

「勢い」を考慮する要素は、過去の勾配の情報を蓄積し、現在の勾配にその蓄積された情報を加えることで、学習の方向性を維持する役割を果たします。まるでボールが坂道を転がるように、過去の勢いを保ちながら学習を進めることで、より速く最適な値へと近づくことができます。この要素は、過去の勾配をどれくらい現在の勾配に反映させるかを調整するパラメータを持っており、このパラメータの値によって学習の速度が変わります。

一方、勾配のばらつきを抑える要素は、勾配の二乗の和を蓄積し、その平方根で現在の勾配を割ることで、勾配の大きさを調整します。これは、学習の過程で勾配が大きくなりすぎるのを防ぎ、安定した学習を実現する役割を果たします。勾配が大きすぎると、最適な値を通り過ぎてしまう可能性があるため、この要素は学習の安定化に大きく貢献します。この要素も、過去の勾配の二乗和をどれくらい現在の勾配に反映させるかを調整するパラメータがあり、このパラメータも学習に影響を与えます。

ADAMは、これらの二つの要素に加えて、初期の学習段階における不安定さを解消するための工夫も取り入れています。学習の初期段階では、蓄積された勾配の情報が少ないため、更新が不安定になりがちです。ADAMは、この問題に対処するために、蓄積された情報の偏りを補正する仕組みを備えています。これにより、初期段階から安定した学習を実現し、最適な値へと効率的に近づくことができます。

このように、ADAMは過去の勾配情報を効果的に活用することで、効率的かつ安定した学習を実現する強力な更新式なのです。

勾配の小さい方向にも対応

多くの学習方法は、目的とするものの値を少しずつ変えながら、より良い値を探し出すという仕組みを持っています。この探し出す過程で、どのくらい値を変えるべきかという指標となるのが勾配です。勾配が大きい方向は、値を大きく変えることで目的のものが大きく改善する可能性が高いことを示しています。逆に、勾配が小さい方向は、値を大きく変えても目的のものはあまり変わらないことを意味します。

多くの学習方法は、この勾配の大きさに比例して値を更新するため、勾配の小さい方向への更新は遅くなってしまいます。まるで緩やかな坂道をゆっくりと進むように、最適な値を見つけるまでに時間がかかったり、時には全くたどり着けなかったりすることもあります。これは学習の停滞と呼ばれ、望ましい結果を得る上での大きな課題となっています。

しかし、ADAMと呼ばれる学習方法は、この問題をうまく解決する方法を持っています。ADAMは、RMSpropと呼ばれる別の学習方法の特徴を取り入れることで、勾配の小さい方向に対しても適切な大きさで値を更新することができます。RMSpropは、過去の勾配の情報を蓄積し、それを利用することで、勾配の変動を滑らかにする働きがあります。これにより、一時的に勾配が小さくなっても、過去の勾配の情報に基づいて適切な更新を行うことができます。

具体的には、ADAMは勾配の二乗平均平方根を計算し、それを用いて更新量を調整します。これにより、勾配の小さい方向でも無視されることなく、適切な大きさで値が更新されます。結果として、学習は停滞することなく、スムーズに最適な値へと近づいていくことができます。特に、勾配が複雑に変化する、まるででこぼこした道のような状況においても、ADAMはその優れた能力を発揮し、効率的に最適な値を探し出すことができます。

| 学習方法 | 勾配の大小と更新量の関係 | 勾配が小さい場合の問題点 | 解決策 | 特徴 |

|---|---|---|---|---|

| 一般的な学習方法 | 勾配の大きさに比例 | 学習の停滞 (最適値への到達が遅い、または到達できない) | – | – |

| RMSprop | 過去の勾配情報を利用し、勾配の変動を滑らかにすることで適切な更新量を決定 | – | 過去の勾配情報を蓄積・利用 | 勾配の変動を滑らかにする |

| ADAM | 勾配の二乗平均平方根を用いて更新量を調整 | – | RMSpropの特徴を取り入れる | 勾配が小さい方向でも適切な大きさで値を更新、複雑に変化する勾配にも対応 |

最初に試すのに最適

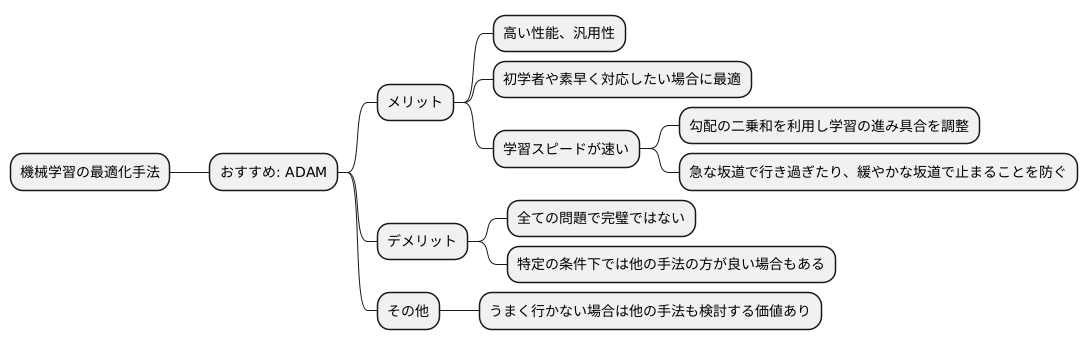

様々な機械学習の場面で、最適な結果を得るためには、適切な最適化手法を選ぶことがとても大切です。数多くの手法の中でも、特におすすめしたいのがADAMです。ADAMは、どんな状況でも高い性能を発揮する、大変便利な手法です。もし、どの手法を選べばよいか迷ったときは、まずADAMを試してみるのが良いでしょう。

ADAMは、勾配の二乗和を利用することで、学習の進み具合を調整するという特徴を持っています。これにより、学習のスピードが速くなり、より良い結果にたどり着きやすくなります。具体的には、過去の勾配情報をうまく利用することで、急な坂道で行き過ぎたり、緩やかな坂道で止まってしまうことを防ぎます。まるで、でこぼこ道を走る車が、自動で速度を調整しながらスムーズに進んでいくようなイメージです。

もちろん、ADAMがすべての問題で完璧に動作するわけではありません。場合によっては、他の手法の方が適していることもあります。たとえば、特定の条件下では、他の手法の方がより速く、より正確な結果を出すかもしれません。しかし、多くの問題において、ADAMは良好な結果をもたらすことが実証されています。そのため、最初の試行としては、ADAMが最適な選択と言えるでしょう。

ADAMを試してみて、思うような結果が得られない場合は、他の手法も検討してみる価値があります。しかし、ADAMの汎用性の高さは、多くの場面で大きなメリットとなります。特に、初心者の方や、様々な問題に素早く対応したい方には、ADAMは強力な武器となるでしょう。まずはADAMを試してみて、その効果を実感してみてください。

まとめ

{学習を効率よく進めるための方法}として、様々な工夫が凝らされています。その中でも、ADAMと呼ばれる手法は、近年注目を集めている、強力な学習方法です。ADAMは、これまでの勾配の記録と現在の勾配を組み合わせることで、より効率的に学習を進めることができます。

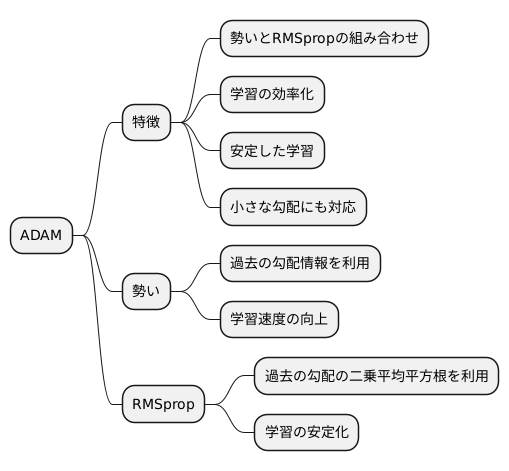

ADAMは、勢いとRMSpropという二つの考え方を組み合わせた手法です。勢いとは、過去の勾配の情報を利用して、現在の勾配を調整する考え方です。まるで、坂道を転がるボールのように、過去の勢いを保ちながら学習を進めることで、学習の速度を向上させることができます。また、RMSpropは、過去の勾配の二乗平均平方根を計算し、それを使って学習の進み具合を調整する考え方です。これにより、学習が不安定になるのを防ぎ、より安定した学習を実現することができます。

ADAMは、これらの二つの考え方を組み合わせることで、勢いによる学習の加速とRMSpropによる安定化の両方の利点を得ることができます。さらに、ADAMは、小さな勾配の方向にも対応できるため、様々な問題において高い性能を発揮します。そのため、最初に試してみる学習方法として、ADAMは最適な選択肢と言えるでしょう。

この記事が、ADAMの理解を深め、機械学習における学習方法の選択に役立つことを願っています。