RNN学習の要:BPTTの仕組み

AIを知りたい

先生、「BPTT」ってなんですか?よく聞くんですけど、難しそうで…

AIエンジニア

そうだね。「BPTT」は「時間を通して誤差を戻す方法」の略で、過去の時点での間違いを修正しながら学習を進める方法なんだ。文章を例にすると、単語の繋がりを考慮して、前の単語の選び方が今の単語にどう影響するかを学習していくんだよ。

AIを知りたい

過去の時点の間違いも修正するんですか?すごいですね!でも、それだとすごくたくさんの計算が必要になりませんか?

AIエンジニア

その通り!たくさんの計算が必要になるし、長い文章だと、最初の頃の単語の影響が薄れてしまうという弱点もあるんだ。だから、改良された方法も色々と考えられているんだよ。

BPTTとは。

人工知能の分野でよく使われる「BPTT」という用語について説明します。BPTTとは、RNNと呼ばれる、時系列データを扱う人工知能の学習方法である誤差逆伝播法を応用したものです。ある時点での誤差は、その時点での正解データとのずれと、次の時点から伝わってくる隠れ層と呼ばれる部分の誤差を足し合わせたものになります。この方法には、全ての時間データが揃っていないと学習できないという欠点があります。

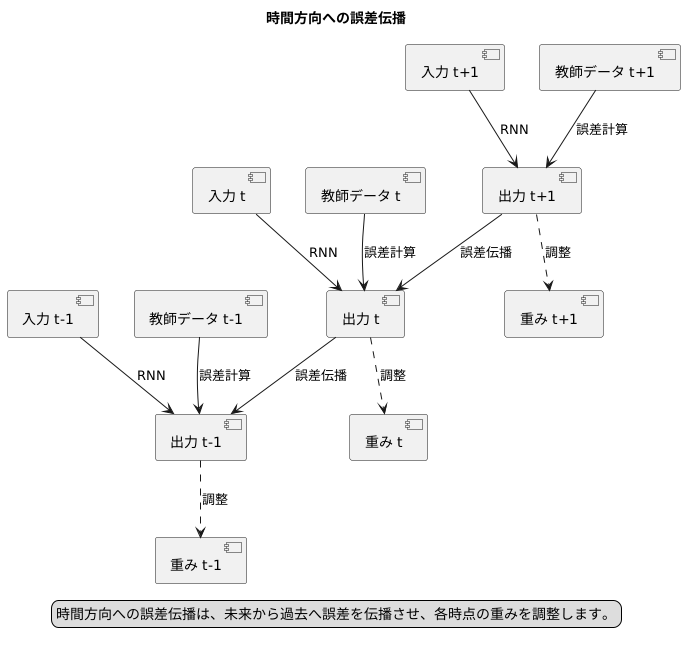

時間方向への誤差伝播

巡り巡る誤差が時を遡るようにネットワークを調整していく様子を想像してみてください。それが、時間方向への誤差伝播と呼ばれる手法です。この手法は、特に過去の情報を記憶しながら、時々刻々と変化するデータの流れを扱うネットワーク、再帰型ニューラルネットワーク(RNN)の学習で重要な役割を担います。

RNNは、過去の情報を持ちながら次の出力を予測するため、通常のネットワークのように、ただ単純に誤差を後ろ向きに伝えるだけでは学習がうまくいきません。なぜなら、現在の出力は過去の入力にも影響を受けているからです。そこで、時間方向への誤差伝播を用いて、時間的な繋がりを考慮した学習を行います。

具体的には、まず各時点での出力と、本来あるべき出力(教師データ)との差、つまり誤差を計算します。そして、この誤差を未来から過去へ、出力側から入力側へと、まるで時間を巻き戻すかのように伝えていきます。

この時、各時点での誤差は、その時点でのネットワークの繋がり具合(重み)を調整するために利用されます。未来の時点での誤差も現在の時点の重みに影響を与えるところが、時間方向への誤差伝播の重要な点です。

このように、時間方向への誤差伝播は、時間的な依存関係を学習できるというRNNの特性を実現するための、なくてはならない手法と言えるでしょう。まるで、過去の出来事が現在の行動に影響を与えるように、ネットワークも過去の情報から未来を予測し、より正確な結果を出せるように学習していくのです。

誤差伝播の仕組み

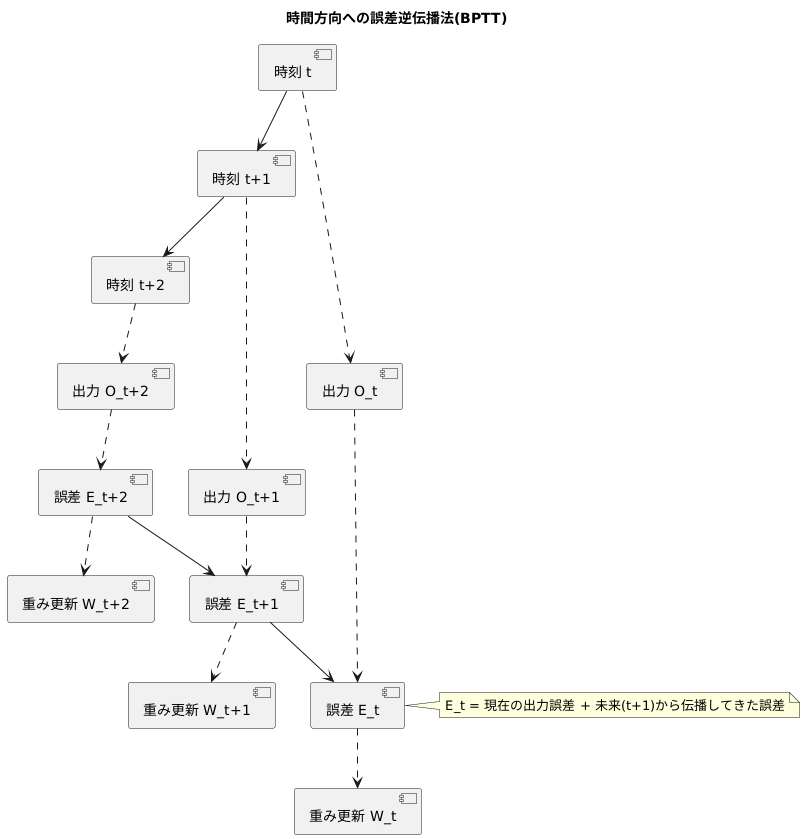

時系列データを扱う再帰型ニューラルネットワーク(RNN)において、学習の鍵となるのが誤差逆伝播法の一種である時間方向への誤差逆伝播法(BPTT)です。BPTTは、出力と正解データとの差である誤差を、時間軸を遡って伝播させることで、ネットワークの重みを調整する手法です。

BPTTにおける誤差は、ある時点での教師データとの誤差と、次の時点の隠れ層から伝わってきた誤差の合計として計算されます。RNNは過去の情報を記憶し、その情報を基に次の時点の出力を生成するため、このような計算方法がとられます。具体的には、ある時点での誤差は、その時点での出力と教師データとの差だけでなく、その誤差が未来の出力にも影響することを意味します。つまり、現在の誤差は、現在の出力に対する誤差と、未来の時点から伝わってきた誤差の影響を受けているのです。

このように、BPTTは時間軸に沿って誤差を逆伝播させることで、RNNが時間的な依存関係を学習できるようにします。例えば、ある文章の単語予測において、現在の単語の予測は、一つ前の単語だけでなく、もっと前の単語にも影響を受けることがあります。BPTTは、このような時間的な依存関係を学習するために、過去の時点からの誤差を現在の時点に伝播させるのです。

誤差の計算は、出力層から入力層に向かって、そして時間方向に沿って行われます。ある時点での重みの更新は、その時点に伝播してきた誤差に基づいて行われます。この誤差は、出力層における誤差だけでなく、未来の時点から逆伝播してきた誤差も含まれているため、重みの更新は、過去の情報と未来の情報の影響を受けていると言えます。このように、BPTTは、時間方向の誤差伝播によって、RNNが時間的なデータの繋がりを学習することを可能にしているのです。

学習に必要なデータ

学習にはデータが欠かせません。その中でも、時間方向に展開されたデータを扱う再帰型ニューラルネットワークの一種であるBPTT(Backpropagation Through Time)という学習手法は、独特のデータ要件を持っています。BPTTは、過去の情報を利用して未来を予測するモデルを作るため、ある時点での予測誤差を計算するために、その未来の時点の情報が必要になります。

例えて言うなら、川の流れを予測するようなものです。ある地点の水位を予測するには、上流の雨量だけでなく、下流のダムの放水量といった未来の情報も影響します。BPTTは、最終的な結果から逆算して、各時点での予測の誤りを修正していくため、全ての時点の情報、つまり川の流れの全体像が把握できていないと、正確な修正ができません。学習を始めるには、川の水源から河口までの全てのデータ、つまり全ての系列データが揃うまで待たなければならないのです。

これは、データが刻一刻と変化する状況では問題となります。刻々とデータが流れ込むような状況では、全てのデータが揃うまで待つのは現実的ではありません。例えば、刻々と変化する株価を予測する場合、全ての取引データが揃うまで待ってから学習を始めては、取引の機会を逃してしまいます。このようなリアルタイム処理や逐次的な学習が必要な状況では、BPTTをそのまま適用することは困難です。

解決策としては、全体を近似的に捉える方法や、ある程度のデータが集まるまで待つ方法が考えられます。前者は、全体像を完璧に把握していなくても、ある程度の予測を可能にする方法で、後者は、短い時間区間で区切って学習を行う方法です。いずれにしても、BPTTの特性を理解し、状況に応じて適切な対処法を選ぶことが重要です。

| 学習手法 | 概要 | データ要件 | 問題点 | 解決策 |

|---|---|---|---|---|

| BPTT (Backpropagation Through Time) | 過去の情報を利用して未来を予測する再帰型ニューラルネットワークの一種。最終的な結果から逆算して各時点の予測誤差を修正。 | 全ての系列データ(水源から河口までの全データ)が必要。 | 刻一刻と変化するデータ(株価など)への適用が困難。リアルタイム処理や逐次学習には不向き。 | 全体を近似的に捉える、またはある程度のデータが集まるまで待つ。短い時間区間で区切って学習する。 |

計算における課題

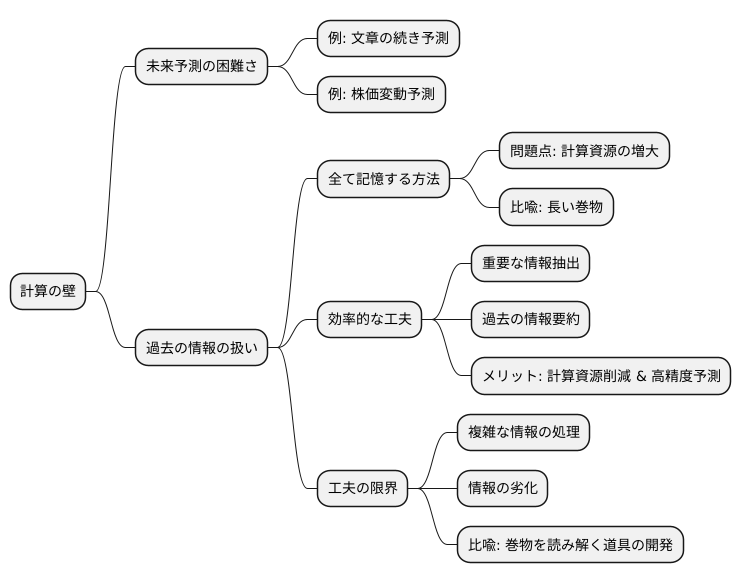

計算を行う上で、いくつかの壁に立ち当たることがあります。特に、過去のできごとを踏まえて未来を予測するような計算では、その壁はより高く、より厚くなってしまいます。例えば、ある文章の続きを予測する、あるいは株価の変動を予測するといったタスクを考えてみましょう。これらのタスクでは、過去の情報が未来の予測に大きな影響を与えます。そのため、過去の情報をどのように扱うかが、予測の正確さを大きく左右します。

一つの方法として、過去の情報を全て記憶し、それを基に計算を行うことが考えられます。しかし、記憶する情報が多くなるほど、計算に必要な時間や資源も増大してしまいます。これは、まるで長い巻物を全て広げて読まなければ、次の展開が予測できないようなものです。巻物が長ければ長いほど、読むのに時間がかかり、場所も必要になります。

この問題を解決するために、過去の情報を効率的に扱う様々な工夫が凝らされてきました。過去の情報を全て記憶するのではなく、重要な情報だけを抽出して記憶する、あるいは、過去の情報を要約して記憶するといった方法です。これらの工夫によって、計算に必要な時間や資源を削減しつつ、高い精度で未来を予測することが可能になります。

しかし、これらの工夫にも限界があります。過去の情報が複雑に絡み合っている場合、重要な情報だけを抽出したり、要約したりすることが難しくなります。また、過去の情報が長い時間に渡って蓄積されている場合、時間の経過とともに情報が劣化し、正確な予測が難しくなることもあります。これらの課題を克服するために、日々新たな工夫が模索されています。まるで、巻物を読み解くための、より優れた道具を開発し続けているかのようです。

改良型RNNとの関係

過去データの影響を時間を遡って学ぶ方法として、時間方向誤差逆伝播法というものがあります。しかし、この方法は学ぶべき情報が古くなればなるほど、その影響が薄れてしまう、あるいは逆に大きくなりすぎてしまうといった問題を抱えていました。これを解決するために、改良型の再帰型ニューラルネットワークが開発されました。代表的なものに、長期短期記憶(LSTM)とゲート付き再帰型ユニット(GRU)があります。

これらの改良型は、情報の取捨選択を行う「ゲート」という仕組みを備えています。ゲートは、どの情報を記憶し、どの情報を忘れるかを判断することで、長い時間の流れの中にあるデータの関係性を効率的に学習することを可能にします。例えるなら、図書館司書のような役割を果たします。重要な書籍は書庫に保管し、不要な書籍は処分することで、書庫の効率的な運用を実現するのと似ています。

LSTMとGRUも、時間方向誤差逆伝播法を使って学習を行います。ゲートの働きによって、古い情報の重要度を適切に調整することで、時間方向誤差逆伝播法が抱える問題を軽減しています。具体的には、影響が薄れすぎるのを防ぐと同時に、影響が大きくなりすぎるのも抑えることで、学習を安定させます。

このように、LSTMとGRUはゲート機構を通じて時間方向誤差逆伝播法をより効果的に活用し、長い時間の流れの中にあるデータの関係性も正確に捉えることができるのです。その結果、従来の手法では難しかった、長い文章の理解や音声認識といった複雑なタスクの処理が可能になりました。

| 項目 | 説明 |

|---|---|

| 時間方向誤差逆伝播法 | 過去データの影響を時間を遡って学習する方法。ただし、情報の古さに応じて影響が薄れたり、大きくなりすぎたりする問題あり。 |

| 改良型再帰型ニューラルネットワーク | 時間方向誤差逆伝播法の問題を解決するために開発された。LSTMとGRUが代表的。 |

| LSTM (長期短期記憶) | ゲート機構を持つ改良型再帰型ニューラルネットワーク。情報の取捨選択を行い、長期的な依存関係を学習可能。 |

| GRU (ゲート付き再帰型ユニット) | ゲート機構を持つ改良型再帰型ニューラルネットワーク。LSTMより簡略化された構造を持つ。 |

| ゲート機構 | 情報の取捨選択を行う仕組み。図書館司書のように、重要な情報を記憶し、不要な情報を忘れることで効率的な学習を実現。 |

| LSTMとGRUの学習方法 | 時間方向誤差逆伝播法を使用。ゲート機構により古い情報の重要度を調整し、学習を安定化。 |

| 効果 | 長い文章の理解や音声認識など、従来の手法では難しかった複雑なタスクの処理が可能に。 |

他の学習方法との比較

巡回型ニューラルネットワーク(RNN)は、時系列データの学習に優れた能力を発揮しますが、その学習方法には様々な種類があります。代表的な学習方法である時間方向誤差逆伝播法(BPTT)は、出力と正解のずれを誤差として捉え、この誤差をネットワークの各層に時間方向に逆向きに伝播させることで学習を進めます。まるで時間を巻き戻すかのように、過去の時点でのネットワークの挙動を修正していく方法です。BPTTは効率的な学習が期待できる一方、長い時系列データを扱う場合、計算量が増大し、勾配消失や勾配爆発といった問題が発生する可能性があります。

BPTTの課題を解決するために、様々な学習方法が提案されています。例えば、実時間巡回学習(RTRL)は、BPTTとは異なり、各時刻において順方向に誤差を伝播させることで学習を行います。そのため、BPTTのように過去の全てのデータを保持する必要がなく、オンライン学習に適しています。つまり、逐次的にデータが入ってくる状況でも、その都度学習を進めることができます。しかし、RTRLはBPTTに比べて計算コストが大きくなる傾向があります。これは、各時刻で誤差を計算するために、より多くの計算が必要となるためです。

また、切断型BPTTは、BPTTの計算コストを削減することを目的とした手法です。BPTTでは、全ての系列データを対象に誤差を逆伝播させますが、切断型BPTTでは、一定の長さで時間を区切り、その範囲内だけで誤差を逆伝播させます。過去のある時点まで遡れば、それ以前の影響は無視できるほど小さくなると考え、計算範囲を限定することで計算量を削減します。このように、切断型BPTTは、BPTTの利点を維持しつつ、計算コストを抑制する工夫が凝らされています。これらの手法は、BPTTの利点と欠点を補いながら、状況に応じて使い分けられています。

| 学習方法 | 説明 | 利点 | 欠点 |

|---|---|---|---|

| BPTT | 出力と正解のずれを誤差として、時間を巻き戻すように過去のネットワークの挙動を修正 | 効率的な学習 | 長い時系列データでは計算量が増大、勾配消失/爆発の可能性 |

| RTRL | 各時刻において順方向に誤差を伝播、オンライン学習に適している | 過去の全データを保持する必要がない、逐次的学習可能 | BPTTより計算コスト大 |

| 切断型BPTT | BPTTの計算コスト削減のため、一定時間で時間を区切り誤差逆伝播 | BPTTの利点維持、計算コスト抑制 | – |