積層オートエンコーダ:過去の深層学習

AIを知りたい

『積層オートエンコーダ』って、オートエンコーダをたくさん重ねるっていう意味ですよね?それってどんな利点があるんですか?

AIエンジニア

そうだね、オートエンコーダを積み重ねることで、より複雑で抽象的な特徴を学習できるようになるんだ。たとえば、一番下の層は単純な線や点の特徴を、その上の層はそれらを組み合わせた図形や模様の特徴を、さらに上の層はもっと複雑な物の特徴を学習していく、といった具合だね。

AIを知りたい

なるほど!でも、たくさんの層を学習させるのは大変じゃないですか?

AIエンジニア

昔は大変だったんだよ。一つずつ層を学習させて、最後に全部を繋げて微調整をしていたんだ。でも、今はコンピュータの性能が上がったから、全部の層を同時に学習させることができるようになって、積層オートエンコーダはあまり使われなくなったんだ。

積層オートエンコーダとは。

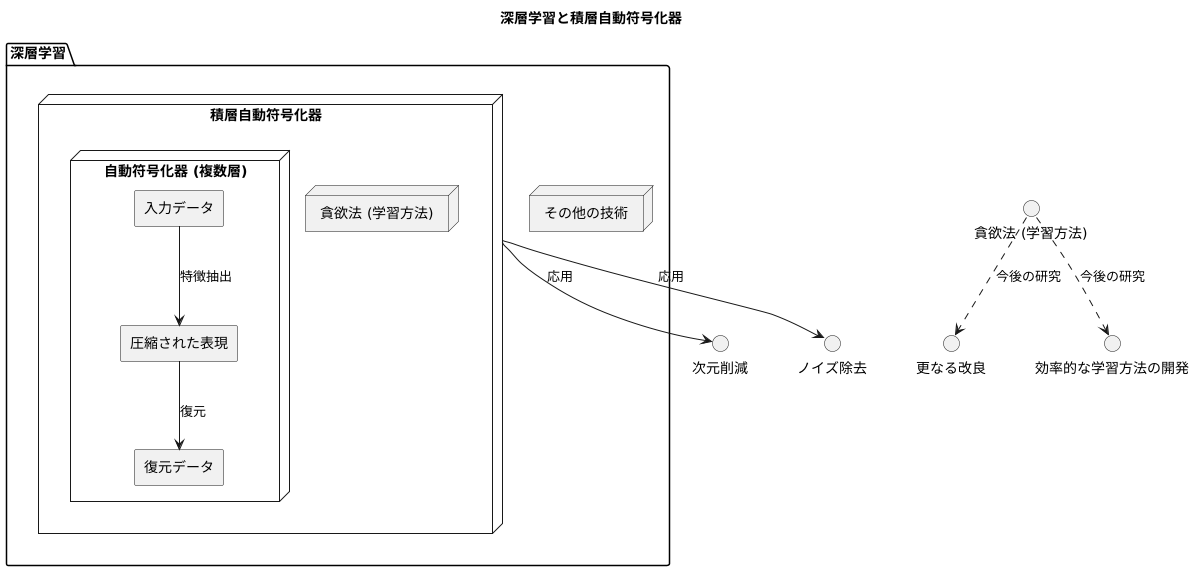

人工知能に関係する言葉、『積み重ね自動符号化器』について説明します。積み重ね自動符号化器とは、自動符号化器をいくつか重ねることで、神経回路網のそれぞれの層で、より高度で抽象的な特徴を学ぶ方法です。学習はまず一段ずつ行い、その後全部を積み重ねて、最後に細かい調整を行います。しかし、今では深い学習の性能が上がり、一段ずつ学習しなくても、同時に全ての層を学習できるようになりました。そのため、積み重ね自動符号化器はほとんど使われなくなりました。

積み重ねの仕組み

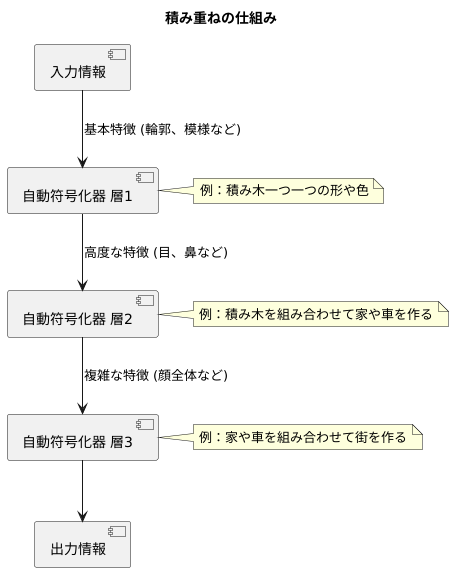

積み重ねの仕組みは、複数の自動符号化器を繋げることで、複雑な情報の表現方法を学ぶ技術です。自動符号化器とは、入力された情報を一度圧縮し、その後その圧縮された情報から元の情報を復元するように学習する仕組みです。この圧縮された情報は、元の情報の重要な特徴を捉えていると考えられています。

積み重ねの仕組みでは、この自動符号化器を何層にも重ねていくことで、より高度で抽象的な特徴を段階的に学習していきます。最初の層では、入力情報の基本的な特徴、例えば絵であれば輪郭や模様などを学習します。次の層では、前の層で学習された特徴を組み合わせて、より高度な特徴、例えば目や鼻などの部品を学習します。さらに次の層では、目や鼻などの部品を組み合わせて、顔全体といった、より複雑な特徴を学習します。このように、層を重ねるごとに、複雑で抽象的な特徴を捉えることができるようになります。

例えるなら、積み木を組み立てるようなものです。最初の層では、一つ一つの積み木の形や色を学びます。次の層では、積み木を組み合わせて、簡単な形、例えば家や車などを作ります。さらに次の層では、家や車を組み合わせて、街全体を作るように、より複雑なものを表現します。

このように、積み重ねの仕組みは、単純な要素から複雑な表現を段階的に学習していくことで、データの本質的な特徴を捉えることができます。この技術は、画像認識や音声認識など、様々な分野で応用されています。

学習の進め方

学習は、積み重ねた構成要素を一つずつ順番に学ぶという、特殊な方法で行います。全体の仕組みを一度に理解するのではなく、一部分ずつ段階的に学習を進めることで、複雑な全体像の把握を容易にします。

最初に、一番下の構成要素にたくさんの情報を与え、入力された情報をそのまま再現できるように学習させます。これは、情報の基礎的な部分をしっかりと捉えるための訓練です。この学習が完了したら、最初の構成要素が作り出した結果を、次の構成要素に渡します。そして、同様に、受け取った情報をそのまま再現できるように学習させます。

これを繰り返すことで、全ての構成要素が順番に学習されます。一つずつ学習を進めるこの方法は、段階的な学習方法と呼ばれ、全体を一度に学習するよりも、学習の安定化と効率化に繋がります。それぞれの構成要素が独立して学習することで、個々の役割が明確になり、全体の学習過程をよりスムーズに進めることができます。

全ての構成要素の学習が完了したら、最後に全ての構成要素を繋ぎ合わせ、全体を微調整する作業を行います。これは、最終的な仕上げのようなもので、各構成要素がバラバラに働くのではなく、連携してより効果的に働くように調整します。これにより、情報の特徴をより的確に捉え、全体の性能を最大限に引き出すことができます。

過去の技術

かつて、深層学習という技術の黎明期には、積層オートエンコーダという手法が重要な役割を担っていました。これは、データを効率的に表現するための技術で、複数の層を積み重ねた構造を持つのが特徴です。それぞれの層は、前の層の出力をより圧縮された形で表現することを目的として学習されます。そして、この圧縮された表現から元のデータに近い形に復元する訓練も同時に行います。この学習を、まず最初の層で行い、次にその学習結果を固定した上で、次の層を学習する、というように順番に積み重ねていくことで、複雑なデータの特徴を捉えることができるようになります。

しかしながら、計算機の処理能力の向上と学習方法の進化により、現在では積層オートエンコーダは主流ではなくなりました。以前は、コンピュータの性能が限られていたため、全ての層を同時に学習させることが困難でした。そこで、積層オートエンコーダのように層ごとに学習を進める方法が有効だったのです。しかし、現代の深層学習では、全ての層を同時に学習させることが一般的です。これは、全体を一括で学習する方が、それぞれの層が全体の中でどのように協調すれば良いかを効率的に学習できるためです。全体を見ながら調整することで、各層が独立して学習するよりも高い性能が得られることが分かっています。

また、近年の深層学習では、膨大な量のデータを用いて学習を行うことが一般的です。積層オートエンコーダのように層ごとに学習を行う場合、各層の学習に多くの時間と計算資源が必要となります。そのため、現代の大量データを用いた学習には適していないのです。このように、積層オートエンコーダは、深層学習の歴史において重要な役割を果たしたものの、現代の技術革新によって、より効率的な手法に取って代わられた過去の技術と言えるでしょう。

| 項目 | 積層オートエンコーダ | 現代の深層学習 |

|---|---|---|

| 学習方法 | 層ごとの学習 | 全体の一括学習 |

| 学習効率 | 低い | 高い |

| 計算資源 | 多く必要 | 比較的少なくて済む |

| データ量 | 少量データ向け | 大量データ向け |

| 現状 | 過去の技術 | 主流 |

利点と欠点

積み重ね自動符号化器には、良い点と悪い点があります。良い点の一つは、段階的に学習を進めるため、学習が安定しやすいことです。まるで、建物を一階ずつ丁寧に建て上げるように、各階層を確実に学習していくため、全体が不安定になることが少ないのです。また、各階層で学習された特徴を目に見える形にすることで、データがどのように表現されているかを理解する手がかりになります。これは、複雑なデータの構造を紐解く際に役立ちます。

しかし、積み重ね自動符号化器には、計算に多くの資源と時間が必要という欠点もあります。各階層を順番に学習していくため、どうしても時間がかかってしまうのです。現代の、より複雑な深層学習の模型と比べると、処理速度の面で遅れをとっていると言えます。特に、膨大な量のデータを扱う際には、この欠点がより顕著になります。まるで、たくさんの荷物を小さな車で何度も往復して運ぶようなもので、効率が悪くなってしまうのです。さらに、各階層ごとに学習を行うため、全体として最適な状態に調整することが難しいという問題もあります。各階層はそれぞれ最適な状態を目指しますが、全体としては必ずしも最適とは言えない状態になることがあるのです。これは、各部署がそれぞれ最適化を目指しても、会社全体としては最適化されていない状態に似ています。特に、大量のデータを使って学習させる場合には、この問題がより深刻になります。

| 項目 | 内容 |

|---|---|

| 良い点 |

|

| 悪い点 |

|

現在の深層学習

近年の深層学習の世界では、大きな変化が起きています。かつて主流だった積み重ね式の自動符号化器に代わり、端から端までを一気に学習させる方法が中心となっています。この方法は、入力された情報から結果が出るまで、全ての層を同時に調整する手法です。全体をまとめて最適化することで、以前の積み重ね式の自動符号化器よりも高い性能を達成できるようになりました。

この変化を支えているのが、計算機の性能向上と画像処理に特化した演算装置の普及です。膨大な量の情報を効率的に学習できるようになったことで、深層学習は大きく進歩しました。これらの技術革新により、積み重ね式の自動符号化器は、最先端の技術ではなくなりつつあります。

しかし、積み重ね式の自動符号化器の考え方は、深層学習の基礎を理解する上で今でも重要な意味を持っています。積み重ね式の自動符号化器とは、入力された情報を圧縮し、その後再び元の情報に復元する仕組みを多層的に積み重ねたものです。それぞれの層で少しずつ情報を抽象化していくことで、複雑な特徴を捉えることができるようになります。この考え方は、現在の深層学習モデルにも受け継がれており、その歴史を学ぶことは、現在の深層学習の理解を深めることに繋がります。過去の技術を学ぶことで、現在の技術の仕組みや限界、そして未来の可能性をより深く理解することができるのです。積み重ね式の自動符号化器は、深層学習の進化を語る上で欠かせない存在であり、その歴史を知ることは、今後の深層学習の発展を考える上でも重要な意味を持つと言えるでしょう。

| 項目 | 内容 |

|---|---|

| 深層学習のトレンド | 積み重ね式の自動符号化器から、端から端までを一気に学習させる方法へ移行 |

| 新しい学習方法 | 入力から出力まで全ての層を同時に調整し、全体を最適化 |

| 変化の要因 | 計算機の性能向上と画像処理特化型演算装置の普及 |

| 積み重ね式自動符号化器の現状 | 最先端ではなくなりつつあるが、深層学習の基礎理解に重要 |

| 積み重ね式自動符号化器の仕組み | 情報を圧縮し、復元する仕組みを多層的に積み重ね、各層で情報を抽象化 |

| 積み重ね式自動符号化器の意義 | 現在の深層学習モデルの基礎となっており、歴史を学ぶことで理解が深まる |

今後の展望

深層学習の世界は常に進歩を続けており、様々な手法が提案され、そして時代と共に変化しています。かつて注目を集めた積層自動符号化器も、現在では最先端の研究の中心からは少し離れてしまいました。しかし、積層自動符号化器が完全に忘れ去られたわけではありません。むしろ、その根底にある考え方や技術は、未来の革新的な技術を生み出すための種子として、今もなお重要な意味を持っています。

積層自動符号化器は、複数の自動符号化器を積み重ねることで、複雑なデータの表現学習を実現する手法です。各層の自動符号化器は、入力データの特徴を捉え、より圧縮された表現に変換します。そして、この圧縮された表現から元のデータを復元するように学習することで、データの本質的な特徴を抽出することが可能になります。積層自動符号化器の学習方法の一つに、各層を順番に学習していく貪欲法があります。この方法は、必ずしも全ての状況で最適な学習方法とは言えないものの、特定の条件下では有効に機能する場合もあります。今後の研究において、この貪欲法の更なる改良や、より効率的な学習方法の開発が期待されます。

また、積層自動符号化器の核となる技術である自動符号化器自体は、現在でも様々な分野で活用されています。例えば、高次元データの次元を削減する技術や、データに含まれるノイズを取り除く技術などに応用されています。これらの技術は、データ解析や画像処理といった分野で広く利用されており、今後も更なる発展が見込まれます。積層自動符号化器の研究で得られた知見は、これらの技術の進化にも貢献する可能性を秘めています。

深層学習の進歩は非常に速く、新しい技術が次々と登場しています。しかし、過去の技術を振り返り、その長所や短所を分析することで、未来の技術開発に繋がる新たな発見があるかもしれません。積層自動符号化器は、深層学習の歴史における重要な一歩であり、その背後にある概念や技術は、今後の深層学習の発展に貢献していくと考えられます。