系列データ処理の革新:Seq2Seqモデル

AIを知りたい

先生、『Seq2Seq』って、何のことですか?難しそうでよくわからないです。

AIエンジニア

そうだな、簡単に言うと、文章を読んで、それから別の文章を作るAIの仕組みの一つだよ。例えば、日本語を英語に翻訳したり、質問に答えたりするのに使われているんだ。

AIを知りたい

文章を読んで、別の文章を作る?具体的にはどんな風にですか?

AIエンジニア

文章をまず分解して意味を理解する部分(エンコーダ)と、理解した意味に基づいて新しい文章を作る部分(デコーダ)の2つの部分からできているんだ。エンコーダで文章のつながりを理解し、デコーダでそのつながりに基づいて、翻訳や質問への回答といった、目的に合った単語を並べていくんだよ。

Seq2Seqとは。

『連続したデータから連続したデータを作る』という仕組み(Seq2Seqと言います)について説明します。この仕組みは、文章などの順番に意味を持つデータを扱うのが得意です。まず、文章を読み込んでその内容を理解する部分(エンコーダと言います)があります。これは、文章全体の流れや意味を掴む役割を果たします。次に、理解した内容に基づいて、目的に合った単語を並べて出力する部分(デコーダと言います)があります。例えば、翻訳であれば、入力された文章の意味を理解し、別の言語で同じ意味の文章を作り出します。

系列から系列への変換

系列から系列への変換は、ある系列データを別の系列データに変換する技術です。 この技術を実現する深層学習モデルの一つに、系列から系列への変換、略して系列変換モデルというものがあります。このモデルは、様々な種類の系列データに対応できるため、応用範囲も広くなっています。

例えば、人間が話す言葉を別の言語に置き換える機械翻訳は、まさに系列変換モデルが活躍する場です。日本語の文章を英語の文章に変換する場合、入力系列は日本語の単語の並び、出力系列は英語の単語の並びとなります。また、人間の声を文字に変換する音声認識も、系列変換モデルを用いることができます。この場合、入力系列は音声データの時間的な変化、出力系列は文字の並びとなります。さらに、長い文章を短い文章にまとめる文章要約にも、この技術が応用されています。入力系列は元の文章、出力系列は要約された文章となります。このように、入力と出力のどちらも系列データであるタスクであれば、系列変換モデルを使うことができます。

系列変換モデルは、入力系列を一度にすべて処理するのではなく、時間的な流れに沿って、一つずつ順番に処理していきます。 例えば、機械翻訳の場合、翻訳したい文章を単語ごとに読み込み、それまでの単語の情報を踏まえながら、一つずつ翻訳語を生成していきます。このように、前の単語の情報を利用することで、文脈を理解した、より自然で正確な変換が可能になります。まるで人間が文章を読むように、単語の繋がりを理解しながら翻訳を進めていくため、高精度な結果が得られるのです。この逐次的な処理方法は、系列データが持つ時間的な依存関係を効果的に捉える上で非常に重要です。

このように、系列変換モデルは、様々な種類の系列データを変換する強力なツールであり、多くの分野で活用されています。今後も、より高度な変換技術の開発が期待されています。

| タスク | 入力系列 | 出力系列 |

|---|---|---|

| 機械翻訳 | 日本語の単語の並び | 英語の単語の並び |

| 音声認識 | 音声データの時間的な変化 | 文字の並び |

| 文章要約 | 元の文章 | 要約された文章 |

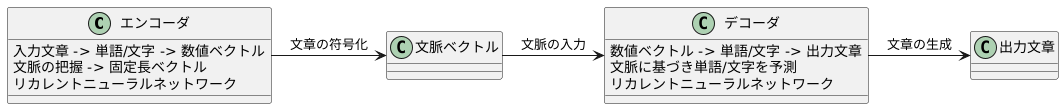

符号化器と復号化器

言葉や文章を機械に理解させるためには、まずそれらを機械が扱える数値データに変換する必要があります。この変換作業を担うのが符号化器、つまりエンコーダです。エンコーダは、入力された文章を一文字ずつ、あるいは単語ごとに分解し、それぞれを数値で表したベクトルに変換します。さらに、エンコーダは、入力された文章全体の文脈、つまり言葉の並びや関係性を捉え、それを一つの固定長のベクトルに圧縮します。このベクトルは文脈ベクトルと呼ばれ、入力文章の重要な情報が凝縮されています。

一方、復号化器、つまりデコーダは、エンコーダが生成した文脈ベクトルを受け取り、それを元に元の文章とは異なる別の文章を生成します。例えば、日本語の文章をエンコーダで処理し、その文脈ベクトルをデコーダに渡すと、対応する英語の文章が生成されます。デコーダも、エンコーダと同様に、数値ベクトルを単語や文字に変換し、それらを繋げて文章を組み立てます。デコーダは、文脈ベクトルに含まれる情報に基づいて、次に来る単語や文字を予測しながら、一つずつ文章を生成していくのです。

エンコーダとデコーダは、どちらもリカレントニューラルネットワークと呼ばれる特殊な人工知能技術を使って作られることが一般的です。この技術は、過去の情報を記憶しながら、時系列データ、つまり時間的な順序を持つデータを処理することに優れています。そのため、文章のような、単語の並び順が重要な意味を持つデータの処理に適しています。エンコーダとデコーダが協力して働くことで、機械はより自然で正確な文章の変換、生成、そして理解が可能になるのです。

文脈ベクトルの重要性

ことばの並びを別の並びに変換する技術は、近年の機械翻訳や文章要約といった様々な分野で活用されています。この技術の中核を担うのが、系列対系列モデル、いわゆる「セクツーセク」モデルです。このモデルは、入力されたことばの並びを一度、意味を圧縮した情報に変換し、それから別の新たなことばの並びを作り出します。この圧縮された情報こそが、文脈ベクトルと呼ばれるものなのです。文脈ベクトルは、入力された文章全体の意味をぎゅっと凝縮した宝箱のようなものです。

この宝箱が持つ情報の質は、出力される文章の質に直結します。宝箱の中身が、入力された文章の重要な情報を的確に捉えていれば、出力される文章も自然で正確なものになります。例えば、「こんにちは、元気ですか?」という入力に対して、「こんにちは。おかげさまで元気です。」という自然な返答を生成するためには、「挨拶」や「相手を気遣う気持ち」といった情報が文脈ベクトルに含まれている必要があります。

反対に、文脈ベクトルが持つ情報が不十分であった場合、出力される文章はちぐはぐなものになってしまうかもしれません。例えば、先ほどの例で文脈ベクトルが「こんにちは」という単語の情報しか捉えられていなかった場合、「こんにちは、こんにちは」のような不自然な返答が生成される可能性があります。つまり、文脈ベクトルは、入力された文章の全体像を理解し、適切な返答を生成するための重要な羅針盤の役割を果たしているのです。

セクツーセクモデルの性能を高めるためには、この文脈ベクトルの質を高めることが何よりも重要になります。より多くの情報をより正確に表現できる文脈ベクトルを作り出すことで、より自然で正確な文章生成が可能となるのです。そのため、現在も様々な研究者たちが、文脈ベクトルの表現方法を改善するための研究に取り組んでいます。より高質な文脈ベクトルを生み出す技術の開発は、機械翻訳や文章要約といった技術の更なる発展に繋がる重要な一歩となるでしょう。

様々な応用

「系列変換」という名の通り、この技術は様々な分野で活用されています。入力された情報を異なる形式の情報に変換する能力は、まさに七変化と言えるでしょう。

まず、言葉の壁を取り払う「自動翻訳」。日本語の文章を入力すると、英語や中国語など、指定した言語の文章に変換してくれます。これは、入力された日本語の単語や文法構造を解析し、対応する外国語の表現に置き換えることで実現しています。まさに言葉の通訳士のような役割を果たしてくれるのです。

次に、「音声認識」。人が話した言葉を文字に変換する技術です。会議の議事録作成や、音声入力による機器操作など、様々な場面で役立ちます。音声を認識し、それをテキストデータに変換することで、私たちの声を文字として記録・活用することを可能にします。まるで、私たちの言葉を書き留めてくれる書記のようです。

そして、「文章要約」。長い文章を短くまとめる作業は、時間と労力を要します。この技術を使えば、長文を入力するだけで、その内容を簡潔にまとめた要約文を生成してくれます。情報の要点をつかみ、効率的に理解する手助けをしてくれるのです。まるで、本の要点をまとめてくれる読書案内人のようです。

さらに、「対話生成」。人間とコンピュータが自然な言葉で会話することを可能にする技術です。過去の会話内容を踏まえ、適切な返答を生成することで、まるで人間同士が話しているかのような自然な対話を実現します。これは、まるで話し相手になってくれる友人のようです。

このように、入力と出力の組み合わせを変えるだけで、様々な用途に活用できるのが、この技術の最大の特徴です。今後、さらに多くの分野で応用され、私たちの生活をより便利で豊かにしてくれるでしょう。

| 技術 | 入力 | 出力 | 用途例 |

|---|---|---|---|

| 自動翻訳 | 日本語の文章 | 英語や中国語など、指定した言語の文章 | 言葉の壁を取り払う |

| 音声認識 | 人が話した言葉 | 文字データ | 会議の議事録作成、音声入力による機器操作 |

| 文章要約 | 長い文章 | 簡潔にまとめた要約文 | 情報の要点をつかみ、効率的に理解する |

| 対話生成 | 人間の発言 | 過去の会話内容を踏まえた適切な返答 | 人間とコンピュータが自然な言葉で会話する |

今後の発展

系列から系列への変換を行う技術である、系列変換モデルは、既に多くの分野で成果を上げており、今後も更なる発展が期待されています。現在、このモデルは、機械翻訳や文章要約、対話システムなど、様々な場面で活用されています。しかし、現状ではまだ課題も残されており、今後の研究開発が重要です。

一つ目の課題は、より長い系列データへの対応です。現状のモデルでは、長大な文章を扱う際に精度が低下する傾向があります。そのため、より長文の系列データにも対応できるモデルの開発が求められています。具体的には、文章の全体的な文脈を理解しながら、詳細な情報も保持できるようなモデルの開発が重要となるでしょう。

二つ目の課題は、より複雑な文脈理解です。人間同士の会話のように、文脈を理解して適切な応答を生成するためには、高度な文脈理解能力が必要です。そのため、より複雑な文脈を理解し、適切な応答を生成できるモデルの開発が重要となります。例えば、過去の会話内容や、話者の感情、周囲の状況などを考慮した応答生成が実現できれば、より自然で人間らしい対話が可能になるでしょう。

系列変換モデルを他の深層学習モデルと組み合わせるという方向性も、今後の発展において重要な役割を果たすと考えられます。例えば、画像認識モデルと組み合わせることで、画像の内容を説明する文章を自動生成するシステムの開発などが期待できます。また、音声認識モデルと組み合わせることで、音声からテキストへの変換だけでなく、音声の内容を理解し、適切な応答を生成するシステムの開発も期待できます。

特に、近年の変換器モデルの登場は、系列変換モデルの発展に大きな影響を与えています。変換器モデルは、従来のモデルよりも高精度で効率的な系列変換を可能にし、機械翻訳の分野などで大きな成果を上げています。これらの技術革新は、今後も継続的に進展していくと考えられ、系列変換モデルは更なる進化を遂げ、様々な分野でより高度な応用が実現されることが期待されます。

| 項目 | 内容 |

|---|---|

| 現状 | 機械翻訳、文章要約、対話システム等で活用 |

| 課題1 | 長い系列データへの対応(長文の精度低下、文脈理解と詳細情報の保持) |

| 課題2 | 複雑な文脈理解(会話、感情、状況考慮) |

| 今後の発展方向 | 他モデルとの組み合わせ(画像認識、音声認識)、変換器モデルの活用 |