LSTM:長期記憶を操るニューラルネットワーク

AIを知りたい

先生、「LSTM」ってよく聞くんですけど、どんなものなんですか?

AIエンジニア

LSTMはね、文章とか、時間とともに変化するデータのパターンを学習するのが得意な技術だよ。 例えば、今日の天気から明日の天気を予測したり、文章の続きを考えたりするのに使われているんだ。

AIを知りたい

へえー。普通の学習と何が違うんですか?

AIエンジニア

普通の学習だと、前のデータの影響がすぐに薄れてしまうことがあるんだけど、LSTMは「記憶する部分」があるから、少し前のデータも覚えていることができるんだ。だから、長い文章の意味を理解したり、複雑な変化を予測したりするのが得意なんだよ。

LSTMとは。

人工知能の分野でよく使われる言葉、「エルエスティーエム」について説明します。エルエスティーエムは、長い時間をかけた短期記憶という意味の言葉の頭文字をとったものです。基本的な仕組みをもつ、情報を順番に処理していく人工知能の技術に、記憶を保存する部品を取り付けたような構造をしています。この部品のおかげで、より長い間の情報を覚えておくことができるようになり、様々な場面で使われています。

はじめに

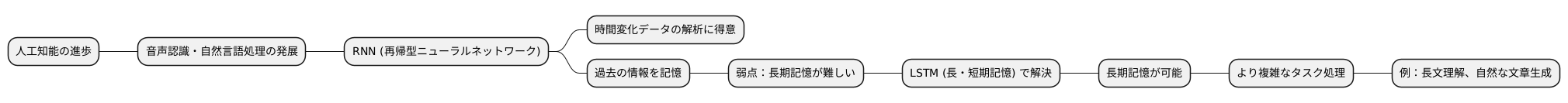

近頃は、人工知能の技術がとても進歩しています。特に、人間が話す言葉を理解したり、音声を認識する技術は目覚ましい発展を遂げています。こうした技術の根幹を支える重要な技術の一つに、再帰型ニューラルネットワークというものがあります。これは、RNNとも呼ばれています。RNNは、時間とともに変化するデータ、例えば、音声や文章といったデータの解析を得意としています。RNNは過去の情報を覚えているため、現在の情報を処理する際に、過去の情報も踏まえて判断することができるのです。これは、まるで人間が過去の経験を基に判断を下すのと似ています。

しかし、初期のRNNには、少し前の情報は覚えていても、ずっと昔の情報を覚えておくことが難しいという弱点がありました。例えるなら、少し前の会話の内容は覚えていても、数日前の会話の内容は忘れてしまうようなものです。この弱点を克服するために開発されたのが、LSTM(長・短期記憶)と呼ばれる技術です。LSTMは、RNNを改良した技術で、長期にわたる情報を記憶しておく能力を備えています。まるで、重要な出来事を日記に記録しておき、必要な時にいつでも見返すことができるように、LSTMは過去の情報をしっかりと記憶し、必要な時に活用することができるのです。

この技術のおかげで、人工知能はより複雑なタスクをこなせるようになりました。例えば、長い文章の内容を理解したり、より自然な文章を生成したりすることが可能になっています。本稿では、LSTMがどのように情報を記憶し、処理しているのか、その仕組みや利点、そして、私たちの生活の中でどのように活用されているのかについて、具体例を交えながら詳しく説明していきます。

長期記憶を保持する仕組み

人間の脳は、必要な情報を長期に渡って記憶し、不要な情報を忘れるという驚くべき能力を持っています。コンピュータの世界でも、このような機能を実現するために様々な研究が行われてきました。その中で、長期記憶を保持する仕組みとして注目されているのがLSTM(長・短期記憶)です。LSTMは、従来のRNN(再帰型ニューラルネットワーク)が苦手としていた長期記憶の保持を可能にする、画期的な技術です。

LSTMの心臓部には、メモリセルと呼ばれる特別な部品があります。このメモリセルは、情報をただ保存するだけでなく、どの情報を記憶し、どの情報を忘れるかという取捨選択も行います。この取捨選択を担っているのが、入力・出力・忘却ゲートと呼ばれる3つの門です。

まず、入力ゲートは、外部から入ってくる新しい情報が、メモリセルに保存する価値があるかどうかを判断します。重要な情報であれば、メモリセルに取り込み、そうでなければシャットアウトします。次に、出力ゲートは、メモリセルに保存されている情報の中で、どの情報を外部に出力するかを決定します。必要な情報だけを選び出し、不要な情報は出力されません。最後に、忘却ゲートは、メモリセルに保存されている情報の中で、どの情報を忘れ、どの情報を保持し続けるかを判断します。古くなった情報や不要になった情報は、忘却ゲートによって消去されます。

このように、3つの門が連携して働くことで、LSTMは必要な情報を長期的に記憶し、不要な情報を適切に忘却することが可能になります。まるで、人間の脳のように、記憶と忘却を巧みに操り、高度な情報処理を実現しているのです。LSTMは、機械翻訳や音声認識など、様々な分野で目覚ましい成果を上げており、今後の更なる発展が期待されています。

従来のRNNとの違い

過去の出来事を覚えていることは、人の脳の優れた機能の一つです。人工知能の分野でも、この記憶の仕組みを再現しようと様々な研究が行われてきました。その中で、再帰型ニューラルネットワーク(RNN)は、過去の情報を現在の判断に活用できるという画期的な仕組みでした。しかし、RNNには弱点がありました。遠い過去の記憶が薄れてしまう「勾配消失問題」です。

例えるなら、RNNは、長い巻物に筆で書き足していくようなものです。巻物が長くなると、最初の頃に書いた文字は薄れて読めなくなってしまいます。RNNも同様に、過去の情報ほど影響力が弱まり、長い文章や複雑な時系列データの解析が苦手でした。そこで登場したのが、LSTM(長短期記憶)と呼ばれる改良版です。LSTMは、RNNに特別な仕組みを追加することで、この問題を解決しました。

LSTMの鍵は、「ゲート機構」と呼ばれる仕組みです。ゲート機構は、まるで門番のように、情報の取捨選択を行います。重要な情報はしっかりと保持し、不要な情報は忘れさせます。どの情報を覚えておくか、どの情報を忘れるかを、LSTM自身で学習していくのです。このゲート機構のおかげで、LSTMはRNNよりも長期的な記憶を保持できるようになりました。

LSTMは、まるで人間の脳のように、重要な情報を記憶し、不要な情報を忘れることができます。このおかげで、従来のRNNでは難しかった、長い文章の理解や、複雑な時系列データの解析が可能になりました。例えば、音声認識や機械翻訳、株価予測など、様々な分野でLSTMは活躍しています。LSTMの登場は、人工知能の記憶能力を大きく向上させ、未来の技術発展に貢献する重要な一歩となりました。

活用事例

長い系列のデータでも関係性を学習できるという特徴を持つ長短期記憶ネットワーク、略してエルエスティーエムは、様々な分野で役立てられています。

まず、私たちが日常的に利用する言葉、つまり自然言語の処理に活用されています。例えば、ある言語を別の言語に変換する機械翻訳は、エルエスティーエムによって精度が向上しました。日本語を英語に、あるいは英語を中国語にといった翻訳作業を、より自然で正確に行うことが可能になっています。また、文章を自動で作る文章生成や、文章に込められた感情を読み取る感情分析にも役立っています。例えば、ニュース記事の要約を自動生成したり、顧客の声から製品への満足度を分析したりといった作業が効率化されています。

次に、音声の認識にも応用されています。私たちが話す言葉を文字に変換する音声のテキスト化や、音声で検索を行う音声検索などは、エルエスティーエムの技術によって支えられています。会議の内容を自動で記録したり、音声で家電を操作したりと、私たちの生活を便利にしてくれる技術です。

さらに、お金に関する分野、つまり金融分野でも活用されています。株価の動きを予測する株価予測や、不正なお金の動きを見つける不正検知などに利用されています。投資判断の材料を提供したり、金融犯罪を防いだりと、経済活動において重要な役割を担っています。

このようにエルエスティーエムは、時間とともに変化するデータを扱う様々な作業において高い成果を期待されています。そして、その応用範囲は今後ますます広がり、私たちの生活をさらに豊かにしてくれるでしょう。

| 分野 | 応用例 |

|---|---|

| 自然言語処理 | 機械翻訳、文章生成、感情分析 |

| 音声認識 | 音声テキスト化、音声検索 |

| 金融 | 株価予測、不正検知 |

今後の展望

長い系列の情報を扱うことができる長短期記憶ネットワーク(LSTM)は、既に様々な分野で成果を上げており、今後の発展も大いに期待されています。

現状では、比較的単純な時系列データの解析に用いられることが多いLSTMですが、将来的にはより複雑なデータの解析にも応用されていくと考えられます。例えば、経済指標や気象データといった複数の要素が絡み合った複雑な時系列データを解析し、将来の予測や意思決定に役立てることが期待されます。また、自然言語処理や音声認識といった分野においても、LSTMはより高度なタスクをこなせるようになるでしょう。文章の意味理解や、自然で滑らかな音声合成といった高度な処理が可能になることで、人と機械とのコミュニケーションはより円滑になるでしょう。

LSTMの学習効率の向上も重要な課題です。現状では、LSTMの学習には大量のデータと時間が必要となるため、より効率的な学習方法が求められています。学習アルゴリズムの改善や、ハードウェアの進化によって、学習にかかる時間や資源を削減することができれば、LSTMの応用範囲はさらに広がるでしょう。また、計算コストの削減も重要な課題です。LSTMは複雑な構造を持つため、計算コストが高くなりがちです。この計算コストを削減することで、より多くの機器でLSTMを利用できるようになり、社会実装が加速すると考えられます。

これらの課題が解決されれば、LSTMはさらに強力な道具となり、人工知能技術の発展に大きく貢献していくことは間違いありません。LSTMが時系列データ解析の新たな扉を開き、未来の人工知能技術を先導していく存在となる可能性は十分にあります。今後のLSTMの進化に、大きな期待が寄せられています。

| 項目 | 内容 |

|---|---|

| 現状 | 比較的単純な時系列データの解析に利用 |

| 将来の応用 | 複雑な時系列データの解析(経済指標、気象データなど) 自然言語処理、音声認識(文章の意味理解、音声合成など) |

| 課題 | 学習効率の向上(大量のデータと時間が必要) 計算コストの削減(複雑な構造のためコスト高) |

| 期待される成果 | 人工知能技術の発展 時系列データ解析の新たな扉を開く 未来の人工知能技術を先導 |

まとめ

長い系列の情報を扱う場合、従来の再帰型ニューラルネットワーク(RNN)では、情報の記憶が薄れていくという問題がありました。これは、時間的な距離が離れると、情報の伝達が弱くなってしまうことに起因しています。この問題を解決するために開発されたのが、長短期記憶ネットワーク(LSTM)です。LSTMは、RNNを改良した構造を持ち、情報を記憶する特別な仕組みを備えています。

LSTMの核心は、「ゲート」と呼ばれる機構です。ゲートは、情報の取捨選択を行う役割を果たします。LSTMには、入力ゲート、出力ゲート、忘却ゲートの3種類のゲートが存在し、これらのゲートが連携して情報を制御します。入力ゲートは、どの情報を記憶セルに追加するかを決定します。重要な情報だけを選択的に記憶することで、不要な情報によるノイズを軽減します。出力ゲートは、記憶セルからどの情報を外部に出力するかを決定します。現在のタスクに関連性の高い情報だけを出力することで、精度の向上に貢献します。忘却ゲートは、記憶セルからどの情報を削除するかを決定します。古くなった情報や不要になった情報を削除することで、記憶容量を効率的に利用します。

これらのゲート機構は、それぞれ固有のパラメータを持ち、学習を通して最適な値に調整されます。これにより、LSTMは、長期的な依存関係を学習することが可能になります。例えば、文章の冒頭に出てきた単語の意味を、文章の末尾で理解するといった処理が可能になります。

LSTMは、自然言語処理の分野で、機械翻訳や文章生成などに活用されています。また、音声認識の分野では、音声データからテキストへの変換などに利用されています。金融分野では、株価予測などにも応用されています。このように、LSTMは様々な分野で応用されており、今後の発展にも大きな期待が寄せられています。LSTMは、人工知能技術の発展を支える重要な技術として、ますます注目を集めていくことでしょう。より高度な人工知能の実現に向けて、LSTMの進化はこれからも続いていくと考えられます。