LeNet:手書き文字認識の先駆け

AIを知りたい

先生、「LeNet」って、どんなものか教えてください。

AIエンジニア

LeNetは、手書きの数字を認識するための人工知能の仕組みの一つだよ。1998年にAT&T Labsで開発されたんだ。数字を99.3%の精度で見分けられるほど優秀なんだよ。

AIを知りたい

そんなにすごいんですね!どうやって数字を見分けているんですか?

AIエンジニア

それはね、画像を細かく見て、重要な特徴を抜き出す「畳み込み層」と「プーリング層」という仕組みを繰り返して、最後に全部をつなぎ合わせて判断する「全結合層」で答えを出すんだよ。今のAIの仕組みと違うのは、使っている計算方法が違うところだね。

LeNetとは。

人工知能に関係する言葉「LeNet」について説明します。LeNetは、1998年にアメリカの電話会社AT&Tの研究所で開発された、画像認識の技術である畳み込みニューラルネットワーク(CNN)の一種です。LeNetは、手書きの文字を99.3%の正확률で識別できます。

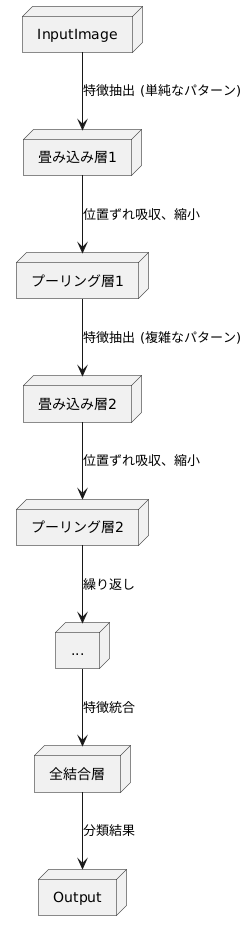

LeNetの仕組みは、画像の特徴を抽出する畳み込み層と、データの量を減らすプーリング層を交互に繰り返すことで、最終的にすべての層がつながった全結合層で結果を出力する形になっています。

今のCNNとLeNetの大きな違いは、使う活性化関数という計算方法にあります。LeNetはシグモイド関数を使っていますが、最近のCNNはReLU関数を使います。また、LeNetはデータを小さくするためにサブサンプリングという方法を使っていますが、今はMaxプーリングという方法が使われています。

LeNetの登場

1998年、エーティーアンドティー研究所から画期的な技術が登場しました。それは、畳み込みニューラルネットワークと呼ばれる、レネットという名の新しい計算模型です。当時、人間が書いた文字を機械に認識させることは非常に難しい問題でした。レネットはこの難題に挑み、99.3%という高い認識率を達成したことで、世界中の研究者から大きな注目を集めました。これは、後の画像認識技術の発展に大きな影響を与えた、まさに画期的な出来事と言えるでしょう。

レネットが登場する以前、機械に文字を認識させるには、人間が文字の特徴を細かく定義し、それを機械に教える必要がありました。例えば、「数字の1は縦線」「数字の8は上下に丸い形」など、一つ一つ丁寧に特徴を設計しなければなりませんでした。これは非常に手間のかかる作業であり、すべての文字を網羅することは容易ではありませんでした。しかし、レネットはデータから自動的に文字の特徴を学習することができるため、人間が特徴を設計する必要がなくなりました。この革新的な手法により、従来の方法よりも高い認識精度と、様々な文字に対応できる柔軟性を実現したのです。

レネットの成功は、深層学習と呼ばれる技術の可能性を示す重要な一歩となりました。深層学習は、人間の脳の神経回路を模倣した複雑な計算模型で、大量のデータから複雑なパターンを学習することができます。レネットはこの深層学習の初期の成功例であり、その後の深層学習研究の発展に大きく貢献しました。現代では、深層学習は画像認識だけでなく、音声認識や自然言語処理など、様々な分野で活用されています。レネットの登場は、まさに現代人工知能技術の礎を築いたと言えるでしょう。

| 項目 | 内容 |

|---|---|

| 技術名 | レネット (畳み込みニューラルネットワーク) |

| 開発元 | エーティーアンドティー研究所 |

| 開発年 | 1998年 |

| 課題 | 機械による文字認識 (当時、非常に困難な問題) |

| 成果 | 99.3% の高い認識率を達成 |

| 従来手法との違い | 人間が文字の特徴を定義する必要がなく、データから自動的に学習 |

| 意義 |

|

LeNetの構造

画像認識の分野で画期的な成果を上げたLeNetは、畳み込み層とプーリング層を交互に重ねる独特な構造を持っています。この構造こそが、LeNetの優れた性能の鍵となっています。

まず、畳み込み層は画像の中から様々な特徴を捉える役割を担います。まるで虫眼鏡で画像の細部を調べるように、小さなフィルターを画像全体に滑らせながら、特定のパターンを探し出します。このフィルターは、例えば、横線や縦線、斜線といった単純な模様を認識するように設定されます。

次に、プーリング層は畳み込み層で抽出された特徴の位置のずれを吸収し、画像の大きさを縮小する役割を果たします。これは、計算の手間を減らすだけでなく、わずかな位置の変化に影響を受けにくいという利点も持ちます。プーリング層では、例えば、小さな領域の中で最も強い特徴だけを残し、他の情報を捨てることで、データ量を圧縮します。

LeNetはこの畳み込み層とプーリング層を複数回繰り返すことで、より複雑で抽象的な特徴を段階的に学習していきます。最初の層では単純な線や角を検出し、次の層ではそれらが組み合わさった模様、さらにその次の層ではより複雑な形といったように、徐々に高度な情報を捉えていきます。

最後に、これらの層で抽出された特徴は、全結合層を通じて出力層に接続されます。全結合層は、これまでの層で得られた情報を統合し、最終的な判断を下す役割を担います。例えば、画像が猫なのか犬なのか、どの数字を表しているのかといった最終的な分類結果を算出します。

この畳み込み層とプーリング層を組み合わせ、段階的に特徴を抽出するLeNetの構造は、後の画像認識モデルの基礎となり、多くのモデルで採用されるようになりました。LeNetの登場は、まさに画像認識技術における大きな転換点と言えるでしょう。

活性化関数

活発化加工は、人工知能の学習において重要な役割を果たします。これは、人間の脳の神経細胞の働きを模倣したものです。神経細胞は、他の神経細胞から信号を受け取ると、それを処理して次の神経細胞に信号を送ります。この処理において、活発化加工は、信号の強さを調整する役割を担います。

初期の人工知能モデルである「レネット」では、「シグモイド加工」と呼ばれる活発化加工が用いられていました。この加工は、入力された値を0から1の範囲の値に変換します。滑らかな曲線を描く変換により、段階的な変化を表現することが可能となります。そして、この段階的な変化が、人工知能に柔軟性を与えるのです。しかし、シグモイド加工には欠点がありました。「勾配消失問題」と呼ばれる現象により、学習の効率が低下することがあったのです。

現在では、「レネット」で使われていたシグモイド加工の代わりに、「修正線形ユニット加工」が広く使われています。この加工は、シグモイド加工よりも計算が単純で、勾配消失問題も起こりにくいという利点があります。そのため、人工知能の学習速度と精度が向上するのです。「レネット」が開発された当時は、修正線形ユニット加工はまだ知られていませんでした。もし知られていたら、「レネット」にも修正線形ユニット加工が採用されていたかもしれません。

このように、活発化加工は人工知能の学習に欠かせない要素であり、時代とともに進化を続けています。より効率的で高精度な学習を実現するために、今後も新しい活発化加工が開発されていくことでしょう。

| 活発化関数 | 説明 | 利点 | 欠点 | 使用モデル |

|---|---|---|---|---|

| シグモイド関数 | 入力値を0から1の範囲に変換する。滑らかな曲線を描く変換で、段階的な変化を表現。 | 人工知能に柔軟性を与える。 | 勾配消失問題により学習効率が低下する可能性がある。 | レネット |

| 修正線形ユニット関数 | シグモイド関数よりも計算が単純。 | 勾配消失問題が起こりにくい。人工知能の学習速度と精度が向上する。 | – | – |

プーリング手法

畳み込みニューラルネットワーク(CNN)において、プーリングは重要な役割を担っています。プーリングとは、画像などの入力データの空間的な大きさを縮小する操作のことを指します。この縮小により、計算量を削減できるだけでなく、過学習を抑える効果も期待できます。初期のCNNであるLeNetでは、プーリングの一種としてサブサンプリングが採用されていました。サブサンプリングは、決められた領域内の画素の平均値を計算することでデータの大きさを縮小します。例えば、2×2の領域を対象とする場合、4つの画素の値を足し合わせ、4で割ることで平均値を求め、その値を新たな画素値として採用します。

しかし、近年のCNNでは、サブサンプリングに代わり、最大値プーリング(Maxプーリング)が主流となっています。最大値プーリングは、決められた領域内における画素値の最大値を取り出す手法です。こちらも2×2の領域を例に取ると、4つの画素値の中から最も大きな値を選択し、新しい画素値とします。最大値プーリングは、サブサンプリングに比べて、より際立った特徴を保持できるという利点があります。画像認識においては、エッジやコーナーなどの情報は特に重要です。最大値プーリングは、これらの重要な情報を効果的に抽出できるため、認識精度向上に貢献します。さらに、計算も単純であるため、処理速度の面でも優れています。

LeNetが開発された当時は、最大値プーリングの利点はまだ広く知られていませんでした。そのため、LeNetではサブサンプリングが用いられていました。しかし、その後の研究によって最大値プーリングの優れた点が明らかになり、現在では多くのCNNモデルで標準的に利用されています。計算量の削減、過学習の抑制、そして重要な特徴の抽出。これらの利点を持つ最大値プーリングは、CNNの発展に大きく貢献していると言えるでしょう。

| プーリング手法 | 計算方法 | 利点 | 採用例 |

|---|---|---|---|

| サブサンプリング | 領域内の画素の平均値 | 計算量の削減、過学習の抑制 | LeNet |

| 最大値プーリング (Maxプーリング) | 領域内の画素の最大値 | 計算量の削減、過学習の抑制、際立った特徴の保持、計算の単純さ | 近年のCNN |

LeNetの功績

手書き数字の読み取りという、かつては困難だった課題において、高い正答率を達成した「レネット」という画期的な技術が登場しました。これは、畳み込みニューラルネットワークという、人間の脳の仕組みを模倣した情報処理方法に基づく、先駆け的な模型です。その簡素な構造は、後の同様の模型の基礎となり、今日の情報処理技術の発展に大きく貢献しました。レネットの登場によって、画像認識という技術分野は飛躍的に進歩し、様々な活用方法が実現しました。

レネットは、情報処理技術の中でも特に注目されている深層学習という分野の歴史において、重要な位置を占めており、その功績は高く評価されています。現代の畳み込みニューラルネットワーク模型は、レネットの設計思想を受け継ぎつつ、様々な改良が加えられています。例えば、層と呼ばれる構成要素の数を増やし、より複雑な構造を持つ模型が開発されています。また、活性化関数と呼ばれる情報の伝達方法や、プーリングと呼ばれる情報を取捨選択する手法も進化し、より高い正答率での認識が可能になっています。レネットは、これらの進化の土台を築いた重要な模型と言えるでしょう。

レネットの成功は、多くの研究者に刺激を与え、深層学習の研究を加速させました。複雑な計算を何層にも重ねて行う深層学習は、まるで人間の脳のように、与えられた情報から特徴を抽出したり、法則性を学習したりすることができます。レネットは、この深層学習の可能性を示しただけでなく、その後の深層学習モデルの設計に大きな影響を与えました。特に、畳み込み層とプーリング層を組み合わせるという基本的な構造は、現代の多くの画像認識モデルでも採用されています。今後も、レネットの設計思想は、様々な分野で応用され、更なる発展を遂げていくでしょう。医療画像診断や自動運転技術など、私たちの生活を豊かにする様々な技術の進歩に、レネットの功績が活かされていると言えるでしょう。

| 項目 | 内容 |

|---|---|

| 技術名 | レネット |

| 課題 | 手書き数字の読み取り |

| 特徴 | 畳み込みニューラルネットワーク(人間の脳の仕組みを模倣) 簡素な構造 後の同様の模型の基礎 |

| 貢献 | 画像認識技術の飛躍的な進歩 情報処理技術の発展 |

| 深層学習における位置づけ | 重要な位置 功績は高く評価 |

| 現代の畳み込みニューラルネットワーク模型との関係 | レネットの設計思想を受け継ぎ、改良が加えられている 層の数増加、より複雑な構造 活性化関数、プーリング手法の進化 |

| 影響 | 深層学習研究の加速 深層学習の可能性を示した 後の深層学習モデルの設計に大きな影響 (畳み込み層とプーリング層の組み合わせ) |

| 今後の展望 | 様々な分野での応用と発展 医療画像診断、自動運転技術など |