GRU入門:簡略化された記憶機構

AIを知りたい

先生、GRUってLSTMを簡単にしたものですよね?具体的にどんなところが簡単になっているんですか?

AIエンジニア

そうだね、GRUはLSTMをよりシンプルにした構造を持っている。LSTMには入力ゲート、出力ゲート、忘却ゲートの3つのゲートがあるのに対し、GRUはリセットゲートと更新ゲートの2つしかない。このゲートの数が減っていることが大きな違いの一つだよ。

AIを知りたい

ゲートの数が減っているんですね。他にLSTMと比べてGRUにはどんな利点があるんですか?

AIエンジニア

ゲートの数が減ったことで、学習に必要な計算量が少なくなり、処理速度が向上するんだ。LSTMは精度が高い反面、計算に時間がかかるという欠点があった。GRUはそこを改善したモデルと言えるね。

GRUとは。

人工知能の分野でよく使われる言葉に「GRU」というものがあります。これは、LSTMという技術をもっと単純にしたものです。LSTMでは、「入力ゲート」「出力ゲート」「忘却ゲート」というものが使われていましたが、GRUでは「リセットゲート」と「更新ゲート」というものが代わりに使われています。LSTMを使う際、たくさんの計算が必要で、特に「セル」と「ゲート」を最適化するのに時間がかかっていましたが、GRUはこの問題を改善しています。

記憶の仕組み

人の脳のように、機械も情報を覚えて使えるようになると、様々なことができるようになります。そのためにGRU(ゲート付き回帰型ユニット)という仕組みが作られました。これは、時間の流れに沿ったデータ、例えば気温の変化や株価の動きなどをうまく処理できる深層学習モデルです。過去の情報を覚えて、未来を予測するのに役立ちます。

GRUは、LSTM(長短期記憶)という少し複雑な仕組みをより簡単に、そして効率よく学習できるように改良したものです。LSTMは、まるで門番のように情報の出し入れや保管を管理する3つのゲート(入力、出力、忘却)を持っています。これらのゲートを複雑に操作することで、様々な情報を覚えたり、思い出したりします。一方、GRUはリセットゲートと更新ゲートという2つのゲートだけで同じような働きをします。

リセットゲートは、過去の情報をどれだけ覚えているかを調整する役割を果たします。過去の情報が今の予測にあまり関係ないと思えば、リセットゲートは過去の情報を忘れさせます。逆に、過去の情報が重要だと判断すれば、その情報をしっかり覚えておきます。更新ゲートは、新しい情報をどれだけ覚えるか、そして古い情報をどれだけ残しておくかを調整する役割を果たします。新しい情報が重要であれば、それを積極的に覚え、古い情報を忘れさせます。それほど重要でない新しい情報であれば、古い情報を優先して覚えておきます。このように、2つのゲートを巧みに使うことで、GRUはLSTMと同じような働きをしながらも、計算の手間を減らし、学習の速度を速くすることに成功したのです。

リセットゲートの役割

記憶の取捨選択を行う「リセットゲート」は、過去の情報をどれくらい現在の状態に反映させるかを決める重要な役割を担っています。このゲートの働きを具体的に見ていきましょう。

過去の情報が現在の状態に不要だと判断された場合、リセットゲートは過去の情報の伝達を抑えます。例えば、文章中で新しい話題に切り替わった時、それ以前の情報はあまり重要ではなくなります。このような場合、リセットゲートは前の話題に関する情報を遮断し、新しい話題の情報に基づいて状態を更新します。いわば、記憶を一度リセットして、新しい情報を取り入れる準備をするようなものです。

逆に、過去の情報が重要だと判断された場合、リセットゲートは過去の情報を積極的に現在の状態に反映させます。例えば、長文読解において、前の段落の内容が現在の段落の理解に不可欠な場合、リセットゲートは前の段落の情報を保持し、現在の段落の情報と合わせて状態を更新します。このように、リセットゲートは状況に応じて過去の情報の取捨選択を行い、適切な状態の更新を実現します。

このリセットゲートの働きによって、「ゲート付き回帰型ユニット(GRU)」と呼ばれる仕組みは、長期的な依存関係を学習しつつ、短期的な変化にも柔軟に対応できます。長期的な記憶が必要な場合は、過去の情報を保持し続け、短期的な変化に対応する必要がある場合は、過去の情報を遮断することで、効率的な学習と予測を可能にしています。この柔軟な情報処理能力が、GRUの大きな特徴の一つと言えるでしょう。

| 過去の情報の重要度 | リセットゲートの動作 | 結果 | 例 |

|---|---|---|---|

| 不要 | 過去の情報の伝達を抑える (遮断) | 記憶をリセットし、新しい情報を取り入れる | 文章中で新しい話題に切り替わった時 |

| 重要 | 過去の情報を積極的に現在の状態に反映させる (保持) | 過去の情報と現在の情報を合わせて状態を更新 | 長文読解において、前の段落の内容が現在の段落の理解に不可欠な場合 |

更新ゲートの働き

情報の取捨選択を行う「更新ゲート」は、過去の情報と現在の情報をどのように組み合わせ、新たな情報を作り出すかを決める重要な役割を担います。このゲートは、過去の情報をどの程度残し、現在の情報をどの程度取り入れるかを調整する働きをします。

たとえば、ある文章の内容を理解しようとしているとしましょう。前の文章の内容が重要で、今の文章の内容はそれほど重要でない場合、更新ゲートは過去の情報を優先的に記憶し、現在の情報はあまり取り込みません。このようにして、重要な過去の情報を保持し続けることができます。

反対に、今の文章の内容が非常に重要で、前の文章の内容はそれほど重要でない場合はどうなるでしょうか。この場合、更新ゲートは現在の情報を積極的に取り込み、過去の情報の重要度を下げます。これにより、状況の変化に柔軟に対応し、最新の重要な情報を反映した理解を可能にします。

更新ゲートの働きを、具体的な例で考えてみましょう。天気予報を例にとると、昨日の天気も今日の天気も重要です。しかし、今日の天気を予測するには、今日の気象情報の方が昨日の天気よりも重要です。この場合、更新ゲートは今日の気象情報をより重視し、昨日の天気の影響を小さくします。

このように、更新ゲートは過去の情報と現在の情報のバランスを巧みに調整することで、適切な判断を下すことを可能にします。過去の記憶を保持しつつ、新しい情報にも適切に反応できるため、長期的な情報の繋がりを理解しながら、変化にも対応できるのです。この柔軟な情報処理こそが、更新ゲートの優れた点と言えるでしょう。

LSTMとの比較

長短期記憶(エルエスティーエム)とゲート付き回帰型ユニット(ジーアールユー)は、どちらも時間的な変化を伴うデータの解析に優れた能力を示します。しかし、両者には構造上の違いがあり、その違いが学習の効率や結果の精度に影響を及ぼします。ジーアールユーはエルエスティーエムに比べて構造が簡素化されており、計算にかかる負担が少なく、学習の速度が速いという利点があります。これは、扱うデータが膨大な場合や、限られた時間で結果を得たい場合に大きなメリットとなります。

エルエスティーエムは、情報の取捨選択や記憶を制御するために3つのゲートと呼ばれる仕組みを用います。これらのゲートは、過去の情報をどれだけ保持するか、現在の情報をどれだけ取り込むか、そしてどのような情報を次の段階に渡すかを調整する役割を担います。しかし、ゲートの数が多いということは、調整すべき項目、つまりパラメータの数が多いことを意味し、学習に時間がかかる原因となります。

一方、ジーアールユーは、更新ゲートとリセットゲートという2つのゲートで同様の機能を実現します。ゲートの数が少ないため、パラメータの数も少なくなり、効率的な学習が可能になります。限られた計算資源でも効果的に学習を進めることができ、特に大規模なデータセットではその差が顕著に現れます。

ただし、常にジーアールユーが優れているわけではありません。解析するデータの種類や、目指す結果によっては、エルエスティーエムの方が高い精度を達成する場合もあります。例えば、非常に複雑な長期的な依存関係を捉える必要がある場合には、エルエスティーエムの持つ表現力の高さが有利に働くことがあります。

そのため、エルエスティーエムとジーアールユーのどちらを選ぶかは、データの特性や解析の目的に合わせて慎重に検討する必要があります。個々の状況に合わせて適切なモデルを選択することで、より効果的な解析を行うことができます。

| 項目 | LSTM | GRU |

|---|---|---|

| ゲート数 | 3 (入力ゲート、出力ゲート、忘却ゲート) | 2 (更新ゲート、リセットゲート) |

| パラメータ数 | 多い | 少ない |

| 学習速度 | 遅い | 速い |

| 計算コスト | 高い | 低い |

| 表現力 | 高い | 低い |

| 長期記憶 | 得意 | やや苦手 |

| 複雑な依存関係 | 得意 | やや苦手 |

| 適用例 | 複雑な長期依存関係の解析 | 大規模データ、高速処理が必要な場合 |

様々な応用事例

ゲート付き回帰型ユニット(GRU)は、様々な分野で活用されている、強力な技術です。その応用範囲は広く、人間が言葉を扱う処理である自然言語処理から、音声を認識する技術、異なる言葉へと変換する機械翻訳まで、多岐にわたります。

機械翻訳では、GRUは特に力を発揮します。文章は、単語が一つずつ並ぶだけでなく、単語同士が互いに影響し合い、全体で意味を成します。GRUはこのような文脈をしっかりと捉えるため、より自然で正確な翻訳を実現できます。従来の手法では、文脈を十分に考慮できず、誤訳が生じやすいケースもありましたが、GRUを用いることでこの課題を解決できるのです。

音声認識の分野においても、GRUは重要な役割を担います。周囲の音や、話す人の癖など、音声データには様々な雑音が含まれています。また、同じ言葉でも人によって発音が異なるため、音声認識システムはこれらのばらつきを乗り越える必要があります。GRUは雑音や発音の違いに強く、頑健な音声認識システムの構築を可能にします。これにより、騒がしい環境でも正確に音声を認識できるようになります。

自然言語処理の分野では、GRUは文章の感情分析や文章の作成といった高度な作業にも利用できます。例えば、商品レビューの文章から、書き手の感情(肯定的か否定的か)を分析することができます。また、小説や詩のような文章を自動で生成することも可能です。GRUは、文章の意味や構造を理解し、人間に近い形で文章を処理できるため、これらのタスクを高精度に行うことができます。

GRUは構造が単純で、学習にかかる計算の量が少ないため、様々な場面で利用しやすいという利点があります。この効率性の高さは、大規模なデータセットを扱う場合や、限られた計算資源しかない場合に特に重要となります。GRUは、今後も様々な分野で活躍が期待される、有望な技術と言えるでしょう。

| 分野 | GRUの役割 | 効果 |

|---|---|---|

| 機械翻訳 | 文脈の把握 | より自然で正確な翻訳 |

| 音声認識 | 雑音や発音の違いへの対応 | 騒がしい環境でも正確な音声認識 |

| 自然言語処理 | 感情分析、文章生成 | 人間に近い文章処理 |

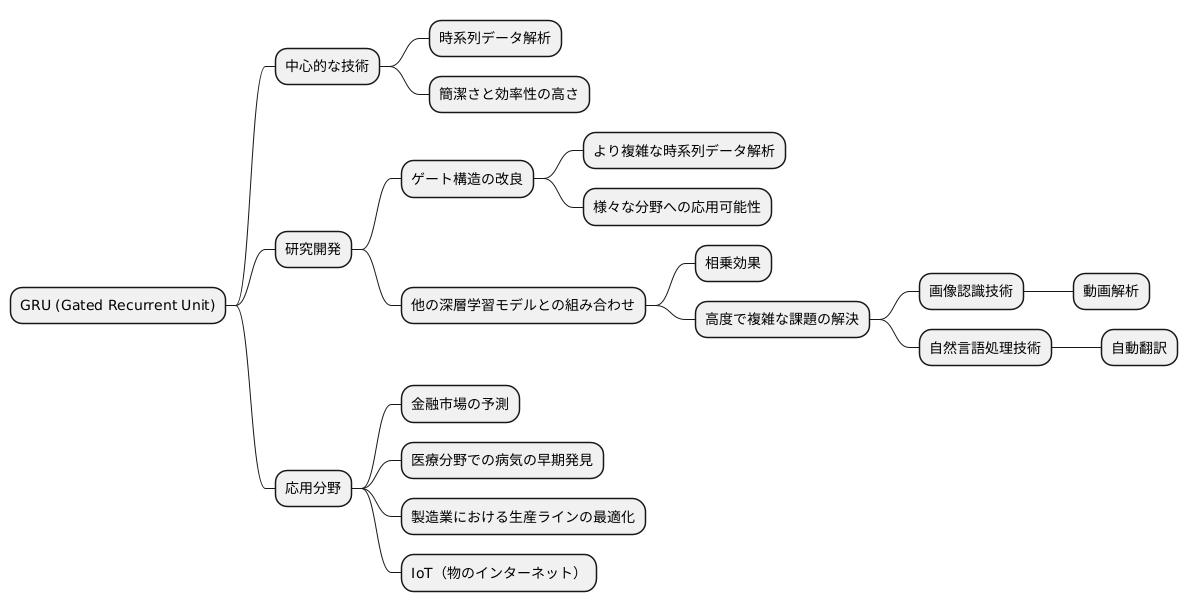

今後の展望

時系列データの解析において、ゲート付き回帰型ユニット(GRU)は中心的な技術として確固たる地位を築きつつあります。その簡潔さと効率性の高さから、多くの分野で利用されており、今後の発展にも大きな期待が寄せられています。

GRUの研究開発は現在も精力的に行われており、更なる性能向上に向けて様々な取り組みが進められています。例えば、GRUの心臓部とも言えるゲート構造に着目し、その改良による効果検証が行われています。ゲート構造の改良によって、これまで以上に複雑な時系列データの解析が可能になると期待されており、様々な分野への応用可能性が広がります。

また、GRU単体での性能向上だけでなく、他の深層学習モデルとの組み合わせによる相乗効果にも注目が集まっています。他の深層学習モデルとGRUを組み合わせることで、より高度で複雑な課題の解決に繋がる可能性があり、現在様々なモデルとの組み合わせが試されています。具体的には、画像認識技術や自然言語処理技術との組み合わせが研究されており、これにより、動画解析や自動翻訳といった複雑なタスクへの応用が期待されています。

GRUは、その簡潔さと効率性の高さから、今後も時系列データ処理の中核技術として、様々な分野で活躍していくことが期待されています。例えば、金融市場の予測や、医療分野での病気の早期発見、製造業における生産ラインの最適化など、幅広い分野での応用が期待されています。膨大なデータを扱うIoT(物のインターネット)の普及に伴い、GRUの重要性は今後ますます高まっていくでしょう。GRUは、データに基づく未来予測を可能にする重要な技術として、私たちの社会をより豊かに、より便利にしていく可能性を秘めていると言えるでしょう。