事前学習で効率的なモデル構築

AIを知りたい

「事前学習」って、どういう意味ですか?難しそうでよくわからないです。

AIエンジニア

そうですね。「事前学習」とは、既に学習済みの知識を新しい学習に活かすこと、つまり予習のようなものと考えてみてください。例えば、一度たくさんの種類の画像を見て学習した人工知能を、鳥の種類を見分ける学習に再利用するといった具合です。

AIを知りたい

鳥を見分けるために、既に学習済みのものを使うってことですか? なぜそんなことをするのですか?

AIエンジニア

はい。ゼロから学習するよりも、既に多くのことを知っている人工知能を少しだけ鳥用に調整した方が、少ないデータで早く学習できるからです。ただし、全く関係ない知識を無理やり使おうとすると、かえって鳥を見分けるのが下手になることもあるので注意が必要です。

事前学習とは。

人工知能分野で使われる「事前学習」という言葉について説明します。事前学習とは、既に学習を終えたお手本の模型を活用する技術のことです。新しい部品を模型に追加して、追加した部品の設定だけを調整することで、別の作業に転用します。これは「転移学習」などと呼ばれます。たとえば、一般的な画像分類の模型を、鳥の種類を見分ける模型に作り変えるといった使い方ができます。事前学習の利点は、少ないデータと短い時間で学習できることです。ただし、あまりにもかけ離れた作業に転用しようとすると、かえって精度が下がるので注意が必要です。

事前学習とは

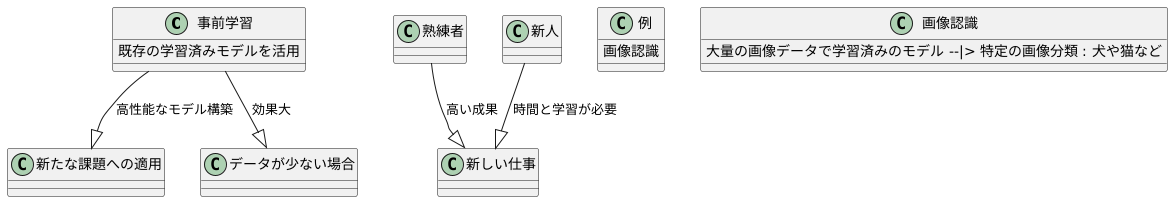

事前学習とは、既に大量のデータで学習を済ませたモデルを、新たな課題に適用するための手法です。例えるなら、様々な経験を積んだ熟練者を新しい仕事に就かせるようなものです。熟練者は既に多くの知識や技能を持っているので、一から仕事を覚える新人よりも早く、高い成果を上げることができます。

同じように、膨大なデータで訓練された既存のモデルは、既に様々な特徴やパターンを学習しています。この既に学習された知識を、新しい課題に転用することで、少ないデータと短い学習時間で高性能なモデルを構築できるのです。特に、新しい課題に使えるデータが少ない場合に、この手法は大きな効果を発揮します。

具体的には、画像認識の分野でよく使われる手法の一つに、大量の画像データで学習させたモデルを、特定の種類の画像、例えば犬や猫の画像を分類するといった、より具体的な課題に適用するといったものがあります。この場合、既に画像データから様々な特徴を抽出して認識する能力を身につけているモデルを、犬や猫の特徴に特化させるように学習させるのです。ゼロから犬や猫の特徴を学習させるよりも、遥かに効率的に高精度な分類モデルを構築することが可能になります。

このように、事前学習は、既に学習済みのモデルを活用することで、学習にかかる時間と労力を大幅に削減し、高性能なモデルを開発するための、大変有効な手法と言えるでしょう。

転移学習との関係

転移学習とは、既に学習済みの知識を新しい課題に活用する学習方法です。例えるなら、小学校で文字の読み書きを習得した後に、専門的な内容の文章を読む学習をするようなものです。既に文字の読み書きという基礎があるため、専門用語の意味を理解することに集中できます。

事前学習は、この転移学習において重要な役割を果たします。膨大なデータで学習させたモデルは、画像認識であれば、色、形、模様といった基本的な特徴を捉える能力が既に備わっています。この学習済みのモデルを別の課題、例えば鳥の種類を判別するタスクに転用することを考えましょう。

鳥の種類を判別する際、一から全ての要素を学習する必要はありません。既に学習済みのモデルは、画像の基本的な特徴を理解しています。そこで、既存のモデルに新たな層を追加し、その層だけを学習させることで、鳥の種類を判別する知識を効率的に獲得できます。つまり、既に学習済みの部分は変更せずに、新しい課題に特化した知識だけを学習させるのです。

具体的には、学習済みのモデルは、既に様々な画像から色、形、模様といった特徴を抽出する能力を身につけています。このモデルに鳥の画像を入力すると、これらの特徴が抽出されます。追加した新しい層は、これらの特徴を基に、鳥の種類を判別する学習を行います。例えば、くちばしの形、羽の色、体の大きさといった特徴を学習し、それらを組み合わせることで、特定の鳥の種類を識別できるようになります。このように、事前学習と転移学習を組み合わせることで、少ないデータでも高い精度で新しい課題を学習できるようになります。

事前学習の利点

学習に使える情報やそのための時間を大きく減らせることが、事前に学習することの最大のメリットです。たとえば、情報集めが大変な状況や、使える計算機材が少ない場合などは特に効果があります。事前に学習しておけば、集めたわずかな情報からでも多くのことを学ぶことができます。まるで、少ない練習時間でも成果を出せる熟練のスポーツ選手のようです。また、すでに学習済みのものを使うことで、特定の情報だけに特化してしまい、新しい情報に対応できなくなることを防ぎ、様々な情報に対応できる能力を向上させる効果も期待できます。これは、基礎学力が高い生徒が応用問題にも対応できるのと同じです。事前に基本的な知識を身につけておくことで、初めて出会う情報に対しても正確な判断ができるようになります。事前に学習しておくことは、まるで地図を持っているようなものです。目的地までの道筋がわからなくても、地図があれば迷わず進むことができます。同様に、事前に学習しておけば、新しい問題に直面しても、すでに持っている知識を活用して解決策を見つけ出すことができます。また、事前に学習することで、試行錯誤にかかる時間を短縮し、効率的に学習を進めることができます。たくさんの料理のレシピを覚えている料理人が、新しい料理を作る際にも既存の知識を応用して効率的に調理できるのと同じように、事前に学習済みのモデルは、新しい情報を学ぶ際にも効率的に学習することができます。これにより、限られた時間の中でより多くの知識を習得することが可能になります。つまり、事前に学習することは、将来の可能性を広げるための強力な手段と言えるでしょう。

| メリット | 説明 | 例え |

|---|---|---|

| 学習時間と情報の削減 | 情報集めが大変な状況や計算機材が少ない場合に効果的。少ない情報から多くのことを学べる。 | 少ない練習時間でも成果を出せる熟練のスポーツ選手 |

| 汎用性の向上 | 特定の情報への特化を防ぎ、様々な情報に対応できる能力を向上させる。 | 基礎学力が高い生徒が応用問題にも対応できる |

| 正確な判断力の向上 | 事前に基本的な知識を持つことで、初めて出会う情報に対しても正確な判断ができる。 | 地図があれば迷わず進める |

| 学習効率の向上 | 試行錯誤の時間を短縮し、効率的に学習を進める。 | 多くのレシピを覚えている料理人が新しい料理を作る際に既存の知識を応用する |

事前学習の注意点

事前学習は、まるで魔法の杖のようにあらゆる問題を解決する万能な技術ではありません。確かに、既に学習済みのモデルを新しい課題に適用することで、学習の手間を省き、より良い成果を期待できます。しかし、この効果は、元の学習内容と新しい課題の関連性が高い場合に限られます。もしも、全く異なる分野に適用しようとすると、期待通りの成果を得られないばかりか、かえって学習の妨げになる可能性も懸念されます。

例として、画像認識の技術を考えてみましょう。写真に写っている物体を正確に識別するように訓練されたモデルは、その能力を音声認識の分野で発揮することは難しいでしょう。これは、まるで日本語の知識を英語の学習にそのまま応用しようとするようなものです。日本語と英語には、確かに共通点も存在しますが、文法や語彙、発音など、異なる点も数多くあります。日本語の知識が、英語学習の全てにおいて役立つとは限らないのと同様に、ある特定の課題に特化して学習されたモデルは、他の種類の課題にそのまま適用できないのです。

同様に、異なる種類の課題にも、それぞれ特有の特徴があります。例えば、画像認識では、画像に含まれる色や形、模様といった視覚的な情報が重要になります。一方、音声認識では、音の高低や長さ、周波数といった聴覚的な情報が鍵となります。これらの情報は、全く異なる性質を持つため、画像認識モデルを音声認識に転用することは、日本語の知識を英語に適用するのと同じように困難です。

したがって、事前学習を行う際には、元の学習内容と新しい課題の類似性を慎重に見極める必要があります。もしも、あまりにもかけ離れた課題に適用しようとすると、学習の効率が著しく低下したり、最終的に得られるモデルの精度が低くなってしまう可能性があります。事前学習は強力な道具ですが、その効果を最大限に引き出すためには、適切な課題を選択し、慎重に適用することが重要です。

| 項目 | 説明 | 例 |

|---|---|---|

| 事前学習の効果 | 元の学習内容と新しい課題の関連性が高い場合に有効 | – |

| 関連性低い場合のリスク | 期待通りの成果を得られないばかりか、学習の妨げになる可能性もある | – |

| 例1:画像認識→音声認識 | 画像認識で訓練されたモデルは音声認識で効果を発揮しにくい | 日本語の知識を英語の学習にそのまま応用するようなもの |

| 例2:画像認識と音声認識の特徴 | それぞれ視覚情報、聴覚情報といった異なる性質の情報が重要 | – |

| 事前学習の注意点 | 元の学習内容と新しい課題の類似性を慎重に見極める必要がある。かけ離れた課題への適用は学習効率低下やモデル精度の低下につながる可能性あり | – |

事前学習の活用例

近年の技術革新により、人工知能は目覚ましい発展を遂げています。この発展を支える重要な技術の一つが事前学習です。事前学習とは、大量のデータを使ってあらかじめモデルを学習させておくことで、特定のタスクに特化した学習をより効率的に行う手法です。この事前学習は、様々な分野で活用されており、人工知能の発展に大きく貢献しています。

例えば、画像認識の分野では、「イメージネット」と呼ばれる膨大な画像データセットを使って学習したモデルが広く使われています。このモデルは、既に多様な物体を認識する能力を持っています。これを土台として、特定の物体をより精密に認識するモデルを作る際に、一から学習させるよりも少ないデータで効率的に学習させることができます。たとえば、犬の種類を判別するモデルを作りたい場合、イメージネットで学習済みのモデルを転用することで、犬の画像データを集める手間を大幅に削減し、高精度な判別モデルを迅速に構築できます。

また、自然言語処理の分野でも事前学習は重要な役割を果たしています。「バート」などのモデルは、インターネット上の膨大なテキストデータを基に学習されています。これにより、これらのモデルは既に言葉の構造や意味を理解しており、文章の分類や質問への回答、文章の翻訳など、様々なタスクに利用できます。例えば、顧客からの問い合わせ内容を自動で分類したい場合、バートを土台として、少ない追加学習データで高精度な分類システムを構築できます。

このように、事前学習は、画像認識や自然言語処理といった様々な分野で不可欠な技術となっています。大量のデータであらかじめ学習させたモデルを転用することで、特定のタスクに特化した高精度なモデルを効率的に開発でき、人工知能の更なる発展を加速させていくと期待されています。

| 分野 | 事前学習モデル | データセット | 活用例 |

|---|---|---|---|

| 画像認識 | イメージネット学習済みモデル | イメージネット(膨大な画像データセット) | 犬の種類判別モデルの構築 |

| 自然言語処理 | バート | インターネット上の膨大なテキストデータ | 顧客からの問い合わせ内容の自動分類 |

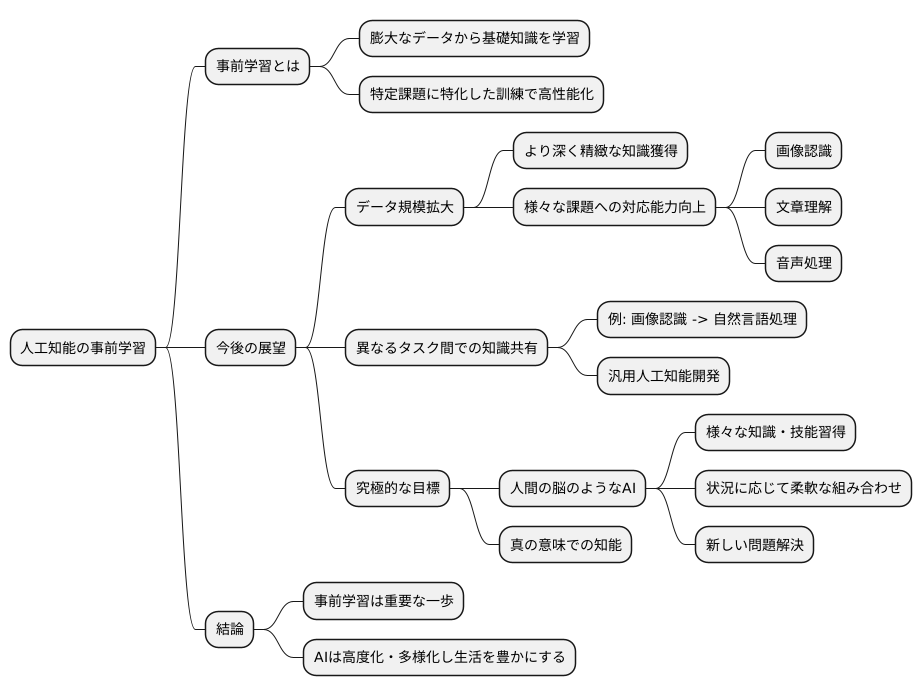

今後の展望

近年の技術革新により、人工知能分野では事前学習という手法が注目を集めています。この手法は、膨大な量のデータから基礎的な知識を事前に学習させ、その後に特定の課題に特化した訓練を行うことで、高い性能を実現するものです。今後の展望としては、まず、学習に用いるデータの規模拡大が挙げられます。より多くのデータで学習することで、モデルはより深く、より精緻な知識を獲得できると期待されます。そして、この大規模データによる学習は、様々な課題への対応能力向上に繋がると考えられます。例えば、画像認識、文章理解、音声処理といった個別のタスクにおいて、飛躍的な精度向上が見込まれます。さらに、異なる種類のタスク間での知識の共有も重要な研究テーマです。例えば、画像認識で学習した形状や色の知識を、自然言語処理における物体認識に活用するといった具合です。このような知識の転移は、個々のタスクの性能向上だけでなく、複数のタスクをこなせる汎用的な人工知能の開発にも貢献すると期待されています。究極的には、人間の脳のように、様々な知識や技能を習得し、状況に応じてそれらを柔軟に組み合わせ、新しい問題を解決できる人工知能の実現を目指しています。これは、特定の課題に特化した従来の人工知能とは一線を画す、真の意味での知能と言えるでしょう。そして、事前学習はこの未来を実現するための、なくてはならない重要な一歩となるでしょう。今後の研究の進展により、人工知能はますます高度化・多様化し、私たちの生活をより豊かにしてくれると確信しています。まるでSFの世界が現実のものとなる日も、そう遠くはないのかもしれません。