学習済みモデル開発:設計と調整

AIを知りたい

先生、「アルゴリズムの設計・調整」って難しそうだけど、具体的にどういうことですか?

AIエンジニア

そうだね、少し難しいけど、料理に例えてみよう。料理を作るにはレシピが必要だよね。アルゴリズムの設計は、このレシピを考えるようなものだよ。どんな材料を、どんな順番で、どんな風に組み合わせるかを決めるんだ。調整はそのレシピをさらに美味しくするために、火加減や調味料の量を微調整するようなものだね。

AIを知りたい

レシピを考えるのと微調整するんですね。先生、レシピを考えるのに、色々な方法があるって聞いたんですが…?

AIエンジニア

その通り!自分で一からレシピを考える方法と、AIに手伝ってもらう方法があるんだ。自分で考える方法は、VGGNet、ResNet、DenseNetといった有名なレシピを参考にしたりするね。AIに手伝ってもらう方法はNASといって、AIが色々なレシピを試して一番良いものを見つけてくれるんだけど、まだ研究段階で時間がかかるんだ。

アルゴリズムの設計・調整とは。

人工知能にまつわる言葉である「計算手順の設計と調整」について説明します。学習済みの模型を作る上で大切なのは、作業内容に合わせて適切な模型を設計・構築し、その模型の細かい設定値を調整することです。模型の繋がりを作る方法は二つあります。一つは人の手で作る方法で、VGGNetやResNet、DenseNetといった多くの設計がこの方法で作られています。もう一つはNAS(ニューラルアーキテクチャサーチ)という方法で、自動的に構造を最適化するものです。NASは人間では思いつかないような強力な模型を生み出す可能性がありますが、探す範囲が広すぎるため計算に多くの時間と資源が必要で、研究途上の部分が多い分野です。

モデル設計の重要性

学習済みの模型を作る仕事では、目的に合った模型の設計と組み立てがとても大切です。模型の出来栄えは、その構造に大きく左右されます。適切な構造を選ぶことで、学習データの特徴をうまく捉え、高い正答率を達成できます。逆に、合わない構造を選んでしまうと、学習がうまく進まなかったり、学習データだけに特化した偏った結果になってしまったりする可能性があります。

例えるなら、家を建てる時の設計図のようなものです。しっかりとした設計図があれば、頑丈で住みやすい家が建ちます。しかし、設計図が不十分だと、家が傾いたり、雨漏りがしたりするかもしれません。模型作りも同じで、良い設計が、良い結果につながるのです。

そのため、模型の設計は、開発の最初の段階で慎重に行う必要があります。入力データの性質や、何を実現したいのかをよく考えて、最適な模型構造を選ぶことが重要です。例えば、画像認識の模型を作る場合、画像の解像度や色数、認識したい対象の複雑さなどを考慮する必要があります。また、音声認識の模型を作る場合は、音声データの音質や長さ、認識したい言語の種類などを考慮する必要があります。

このように、入力データの特性や目的を踏まえた上で、様々な種類の模型構造の中から最適なものを選ぶことが、高性能な学習済み模型を作るための最初のステップとなります。適切な設計は、その後の学習過程をスムーズに進めるだけでなく、最終的な模型の性能を最大限に引き出す鍵となります。言い換えれば、模型設計は、高性能な学習済み模型開発の土台と言えるでしょう。

| 項目 | 説明 |

|---|---|

| 模型設計の重要性 | 学習済み模型の性能を大きく左右する。適切な設計は、高い正答率達成に繋がり、不適切な設計は学習の失敗や偏った結果に繋がる。 |

| 設計の例え | 家の設計図。しっかりとした設計図は頑丈な家を作るように、良い模型設計は良い結果に繋がる。 |

| 設計時の注意点 | 開発の初期段階で慎重に行う。入力データの性質や目的を考慮し、最適な模型構造を選ぶ。 |

| 入力データの考慮事項 (画像認識) | 画像の解像度、色数、認識対象の複雑さ |

| 入力データの考慮事項 (音声認識) | 音声データの音質、長さ、認識したい言語の種類 |

| 設計の目的 | 入力データの特性や目的を踏まえ、様々な模型構造から最適なものを選び、高性能な学習済み模型を作る。 |

| 設計の効果 | 学習過程をスムーズにし、最終的な模型の性能を最大限に引き出す。高性能な学習済み模型開発の土台となる。 |

手動構築と自動最適化

模型の組み立てには、大きく分けて二つのやり方があります。一つは、人の知識と経験を頼りに、一つ一つ手作業で組み立てるやり方です。このやり方では、作り手が色々な組み合わせを試しながら、層の数や種類、層の繋げ方などを細かく調整していきます。ちょうど、熟練した職人が丁寧に部品を組み立てていくようなイメージです。画像を見分ける技術で広く使われている、ブイ・ジー・ジー・ネット、レズ・ネット、デンス・ネットといった模型も、このやり方で組み立てられています。これらの模型は、高い性能を示しており、様々な場面で役立っています。

もう一つのやり方は、自動的に模型の構造を決めるやり方で、ニューラルアーキテクチャサーチと呼ばれています。このやり方は、膨大な数の組み合わせの中から、一番良い構造を見つけ出すことができます。例えるなら、たくさんの部品を組み合わせて、あらゆる形を試せるロボットのようなものです。人の力では到底たどり着けない、画期的な模型の構造を発見できる可能性を秘めています。この自動で組み立てるやり方は、人の手による調整の手間を省けるだけでなく、より高性能な模型を生み出す可能性も秘めているため、近年注目を集めています。ただし、膨大な計算が必要となるため、大きな計算機が必要となります。この計算機の大きさの問題が解決されれば、今後ますます発展していくと期待されています。人の経験に基づく緻密な組み立てと、機械の力による革新的な探索。この二つのやり方が、これからの模型作りを支えていくでしょう。

| 組み立て方 | 説明 | 例 | メリット | デメリット |

|---|---|---|---|---|

| 手作業 | 人の知識と経験に基づき、一つ一つ手作業で組み立てる。層の数や種類、層の繋げ方などを細かく調整。 | VGGNet, ResNet, DenseNet | 高い性能 | 手間がかかる |

| 自動組み立て(Neural Architecture Search) | 膨大な数の組み合わせの中から、一番良い構造を自動的に見つけ出す。 | – | 高性能な模型発見の可能性, 手間がかからない | 膨大な計算が必要 |

ニューラルアーキテクチャサーチの可能性

近年の機械学習、とりわけ深層学習の発展は目覚ましいものがあります。画像を認識したり、言葉を理解したり、音声を判別したりと、様々な分野で目覚ましい成果を上げています。こうした深層学習の中核を担うのが、深層学習モデルと呼ばれるものです。このモデルの良し悪しが、最終的な性能を大きく左右します。これまで、高性能な深層学習モデルを作るには、専門家の知識と経験に基づいた手作業が必要でした。試行錯誤を繰り返しながら、最適な構造を見つけ出す必要があり、多くの時間と労力がかかっていました。

しかし、ニューラルアーキテクチャサーチ(略して「神経構造探索」)という新たな技術が登場し、状況は変わりつつあります。この技術は、自動的に深層学習モデルの構造を探索する技術です。人間が手作業で設計する代わりに、計算機が自動的に様々な構造を試して、最も性能が良い構造を見つけ出すことができます。これは、まるで職人が丹精込めて作品を作る代わりに、自動機械が最適な設計図を描き、製品を作り出すようなものです。

神経構造探索を使うことで、専門家の知識や経験に頼らずとも、高性能な深層学習モデルを開発できるようになります。従来の手法に比べて、開発期間を大幅に短縮できるだけでなく、人間では思いつかないような、斬新な構造を発見できる可能性も秘めています。

神経構造探索は、画像認識の分野で既に成果を上げており、従来の手作業による設計を上回る性能を達成した事例も報告されています。さらに、言葉の処理や音声の認識といった他の分野への応用も期待されています。今後、神経構造探索の研究がさらに進み、技術が発展していくことで、より高性能で、様々な用途に使える深層学習モデルが、次々と生み出されていくと考えられます。そして、私たちの生活は、人工知能によってさらに便利で豊かなものになっていくでしょう。

| 項目 | 内容 |

|---|---|

| 深層学習の発展 | 画像認識、言葉の理解、音声判別など様々な分野で成果 |

| 深層学習モデル | 深層学習の中核、性能を左右 |

| 従来のモデル作成 | 専門家の知識と経験に基づいた手作業、試行錯誤、時間と労力 |

| ニューラルアーキテクチャサーチ(神経構造探索) | 深層学習モデルの構造を自動的に探索する技術 |

| 神経構造探索の利点 | 専門知識不要、開発期間短縮、斬新な構造発見 |

| 神経構造探索の成果 | 画像認識で成果、従来の手作業設計超える性能 |

| 神経構造探索の将来 | 言葉処理、音声認識への応用、高性能モデル開発 |

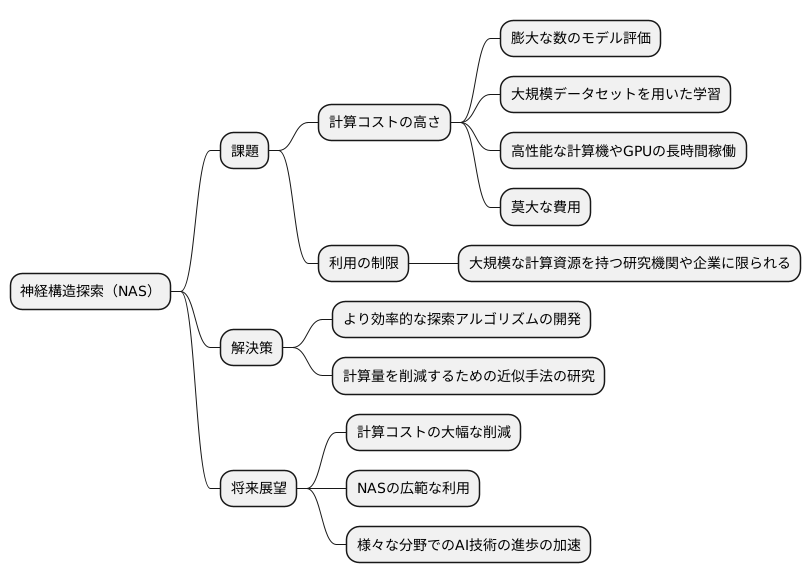

計算コストの課題

{神経構造探索(NAS)は、人間の介入を最小限に抑え、人工知能(AI)モデルの構造を自動的に最適化する技術として大きな期待を集めています。しかし、この革新的な技術には、克服すべき大きな課題が存在します。それは計算コストの高さです。

NASは、AIモデルの構成要素を組み合わせ、様々な構造を生成し、その性能を評価することで最適な構造を見つけ出します。この探索過程では、膨大な数のモデルを評価する必要があり、その度に大規模なデータセットを用いた学習が行われます。そのため、非常に多くの計算資源と時間が必要となります。

具体的には、高性能な計算機やGPU(画像処理装置)を長時間稼働させる必要があり、それに伴う電力消費も無視できません。これらの計算資源は高価であり、莫大な費用がかかります。結果として、現時点ではNASの利用は、大規模な計算資源を持つ研究機関や企業に限られており、一般の研究者や開発者にとっては利用が難しい状況です。

この計算コストの問題は、NASをより広く普及させるための大きな障壁となっています。NASの活用により、様々な分野でAIの性能向上が期待されていますが、計算コストの高さがその実現を阻んでいます。

この課題を解決するために、様々な研究が行われています。例えば、より効率的な探索アルゴリズムの開発や、計算量を削減するための近似手法の研究などが盛んに行われています。これらの研究の進展により、近い将来、計算コストが大幅に削減され、NASがより広く利用できるようになることが期待されています。そうすれば、より多くの研究者や開発者がNASを利用できるようになり、様々な分野でAI技術の進歩が加速すると考えられます。

今後の展望と期待

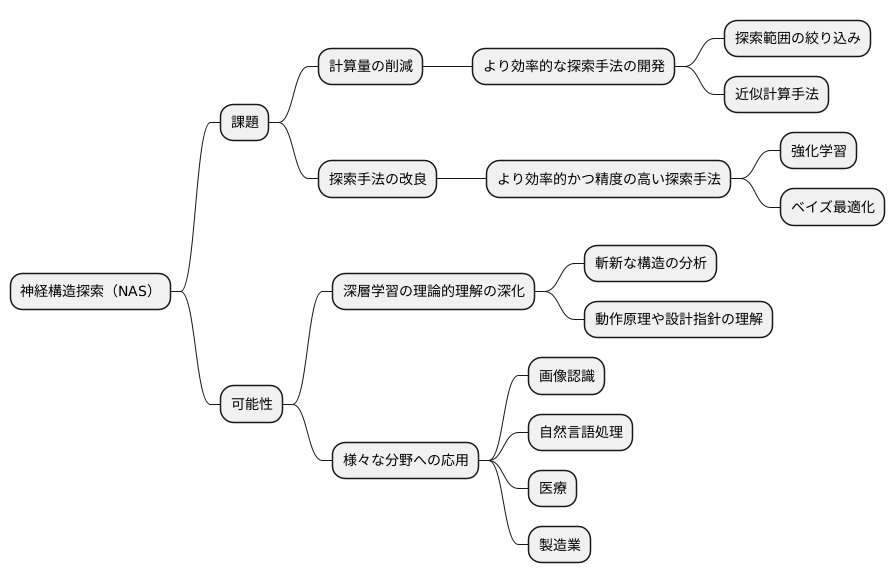

神経構造探索(NAS)は、発展途上の技術であり、多くの課題を孕んでいます。しかしながら、秘めた可能性は計り知れず、今後の発展に大きな期待が寄せられています。

まず、計算量の削減は重要な課題です。現状では、最適な神経構造を見つけるために膨大な計算資源と時間を必要とします。そのため、より効率的な探索手法の開発が求められています。例えば、探索範囲を絞り込む手法や、計算量を抑えつつ精度を維持する近似計算手法などが研究されています。これらの研究成果によって、より少ない計算資源で高性能なモデルを開発できるようになり、NASの適用範囲が大きく広がることが期待されます。

次に、探索手法の改良も重要な研究分野です。現状では、ランダム探索や進化計算などの手法が用いられていますが、これらの手法は必ずしも最適な構造を見つけられるとは限りません。より効率的かつ精度の高い探索手法の開発が求められており、強化学習やベイズ最適化などの応用が期待されています。これらの手法によって、より優れた構造をより短い時間で発見できるようになるでしょう。

NASによって発見された新しい構造は、深層学習の理論的な理解を深める上でも重要な役割を果たすと考えられます。従来、深層学習モデルの構造は、人間の経験や直感に基づいて設計されてきました。しかし、NASによって自動的に設計された構造は、人間の想定を超えた斬新な構造を持つ場合があります。これらの構造を分析することで、深層学習の動作原理や性能向上に繋がる設計指針を理解する手がかりを得られる可能性があります。

さらに、NASは様々な分野への応用が期待されています。画像認識や自然言語処理といった既存の分野だけでなく、医療や製造業など、これまで深層学習の活用が進んでいなかった分野にも応用される可能性があります。それぞれの分野に特化した最適な構造を自動的に発見することで、従来の手法では実現できなかった性能向上や新たな応用が期待されます。

このように、NASは人工知能技術の発展に大きく貢献していくことが期待されています。今後のNASの進展は、人工知能技術の更なる進化を促し、私たちの社会に革新をもたらすでしょう。

調整の重要性

機械学習モデルを作る上で、設計と同じくらい大切なのが調整です。優れた設計であっても、調整を怠ると本来の力を発揮できません。この調整とは、ハイパーパラメータと呼ばれる、学習のやり方を決める設定値を調整することを指します。ハイパーパラメータには、一度に学習に使うデータ量を決めるバッチサイズや、どのくらい大胆に学習を進めるかを決める学習率など、様々な種類があります。これらの値を適切に設定することで、学習はスムーズに進み、より良い結果が得られます。

例えば、学習率が小さすぎると、学習の進みが遅く、なかなか良い結果にたどり着けません。反対に学習率が大きすぎると、最適な状態を飛び越えてしまい、良い結果を得られない可能性があります。バッチサイズも同様で、小さすぎると学習が不安定になりやすく、大きすぎると計算に時間がかかったり、最適な状態を見逃してしまう可能性があります。

このように、ハイパーパラメータの値はモデルの性能に大きく影響します。そのため、様々な値を試して最適な組み合わせを見つける必要があります。この最適な値を探す作業はハイパーパラメータ調整と呼ばれ、様々な手法が開発されています。値を順番に試していく方法やランダムに値を試していく方法、過去の試行結果を参考にしながら効率的に値を探していく方法などがあります。どの手法を使うかは、モデルの複雑さや利用できる計算資源によって適切に選ぶ必要があります。ハイパーパラメータ調整は、時間と計算資源を多く必要とする作業ですが、モデルの性能を最大限に引き出すためには欠かせない重要な作業です。

| ハイパーパラメータ | 説明 | 値が小さすぎる場合 | 値が大きすぎる場合 |

|---|---|---|---|

| バッチサイズ | 一度に学習に使うデータ量 | 学習が不安定 | 計算に時間がかかる、最適な状態を見逃す |

| 学習率 | どのくらい大胆に学習を進めるか | 学習の進みが遅い | 最適な状態を飛び越える |