CEC:長期記憶の立役者

AIを知りたい

先生、CECってなんですか?LSTMで使われていると聞いたのですが…

AIエンジニア

CECはConstant Error Carouselの略で、セルとも呼ばれています。LSTMの心臓部とも言える重要な部分ですね。データを記憶する役割を持っています。

AIを知りたい

データを記憶するということは、具体的にどのような働きをしているのですか?

AIエンジニア

CECは、誤差を一定期間内部に保持し続けることができます。LSTMは時系列データの長期的な依存関係を学習することが得意なのですが、CECはこの長期記憶を実現する鍵となっています。誤差を内部にとどめることで、勾配消失問題を防ぎ、過去の情報をより長く記憶できる仕組みになっています。CECのおかげでLSTMは長い系列データでも前の情報を覚えていられるんですよ。

CECとは。

人工知能で使われる言葉「CEC」について説明します。CECは「セル」とも呼ばれ、LSTMという技術の中で使われています。CECは、計算の過程で生じる誤差を内部に留めておく働きをします。このおかげで、誤差が小さくなりすぎて学習が進まなくなる「勾配消失」という問題を防ぐことができます。

記憶の担い手

記憶とは、過去の出来事や経験を覚えている能力のことです。私たち人間にとって、記憶は日常生活を送る上で欠かせないものです。物を覚える、言葉を話す、道を歩くといった行動は、すべて記憶に基づいています。そして、人工知能(じんこうちのう)の分野でも、記憶の仕組みを模倣(もほう)することで、より高度な機能を実現しようとする研究が進められています。その中で重要な役割を担っているのが、「定誤差回転木」と呼ばれるしくみです。このしくみは、英語のConstant Error Carouselの頭文字をとってCECと呼ばれ、長期・短期記憶(LSTM)ネットワークという技術の中核をなす重要な要素です。LSTMは、深層学習(しんそうがくしゅう)と呼ばれる技術の一種であり、特に時間とともに変化するデータの解析に優れた能力を発揮します。例えば、音声認識や自然言語処理といった分野では、LSTMが重要な役割を担っています。

では、CECはLSTMの中でどのような働きをしているのでしょうか。CECは、まるで遊園地にある回転木のように情報を一定の状態で循環させることで、過去の情報を未来へと伝える役割を担っています。情報を一定に保つことで、重要な情報が時間とともに薄れてしまうのを防ぎ、長期的な記憶を可能にしているのです。回転木に乗っている子供たちが、回転する間もずっと木馬に乗っていられるように、CECは情報を失うことなく保持し続けます。このおかげで、LSTMは過去の情報を基に未来を予測したり、適切な判断を下したりすることができるのです。

CECは、LSTMという複雑なシステムの中で、まるで縁の下の力持ちのように重要な役割を担っています。LSTMの活躍によって、人工知能はますます高度な処理をこなせるようになり、私たちの生活をより豊かにしてくれると期待されています。まるで、過去の出来事を覚えていることで、私たちはより良い未来を築くことができるように。CECという小さな回転木が、人工知能の大きな進歩を支えているのです。

勾配消失問題への対策

深い構造を持つ学習模型を訓練する際、勾配消失問題は避けて通れない難題です。勾配消失とは、模型の出力と正解データとの誤差を、模型の各層に逆向きに伝えていく過程で、誤差の値が層を遡るごとに小さくなり、やがて消失してしまう現象です。これは、誤差が小さくなりすぎると、各層のパラメータの修正量が極めて小さくなってしまい、学習がうまく進まなくなる原因となります。

この勾配消失問題に対処するために、様々な工夫が凝らされています。その一つに、勾配消失問題を緩和する効果を持つ活性化関数があります。例えば、シグモイド関数の代わりに、勾配消失問題が生じにくい、別の活性化関数を用いることで改善が期待できます。また、層の正規化も有効な手法です。これは、各層への入力値を正規化することで、学習の安定化を図る方法です。

さらに、近年注目を集めているのが、特定の構造を持つ学習模型です。例えば、長期的な記憶を保持できる機構を備えた学習模型は、勾配消失問題の影響を受けにくく、長い系列データの学習に適しています。これは、情報を一時的に貯めておく仕組みが、誤差が消失するのを防ぐ役割を果たすからです。まるでダムのように、情報をせき止めて、必要な時に必要な量だけ下流に流すことで、全体の情報の流れを安定させる効果があります。

このように、勾配消失問題への対策は、活性化関数、正規化、そして学習模型の構造といった複数の側面からアプローチすることで、より効果的に解決へと導くことができます。これらの対策を適切に組み合わせることで、深い構造を持つ学習模型でも効率的に学習を進めることが可能になります。

| 対策 | 説明 |

|---|---|

| 活性化関数 | シグモイド関数の代わりに、勾配消失問題が生じにくい活性化関数を用いる。 |

| 層の正規化 | 各層への入力値を正規化することで、学習の安定化を図る。 |

| 特定構造の学習模型 | 長期的な記憶を保持できる機構を備えた学習模型は、勾配消失問題の影響を受けにくく、長い系列データの学習に適している。 |

セルの役割

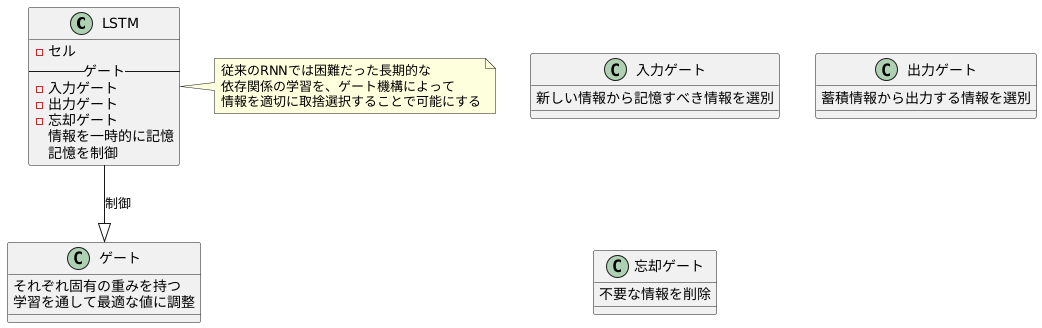

{CECは「セル」とも呼ばれ、長短期記憶ネットワーク(LSTM)の心臓部にあたる重要な構成要素です。セルは、情報を一時的に記憶し、その記憶を制御する役割を担っています。

セルの中には、「ゲート」と呼ばれる特別な仕組みが備わっています。このゲートは、まるで門番のように、情報の出し入れを管理しています。具体的には、どの情報をセルに取り込むのか、どの情報をセルから出力するのか、そしてどの情報をセルの中に保持し続けるのかを、細かく調整しています。

ゲートには主に3つの種類があります。まず「入力ゲート」は、新しく入ってくる情報の中から、セルに記憶させるべき情報を選び出す役割を担います。次に「出力ゲート」は、セルに蓄えられた情報の中から、どの情報を外部に出力するかを決定します。最後に「忘却ゲート」は、セルに記憶されている情報の中から、不要になった情報を削除する役割を担います。

これらのゲートは、それぞれ固有の重みを持ち、学習を通して最適な値に調整されます。つまり、大量のデータを使って学習させることで、どの情報を記憶し、どの情報を忘れるべきかを、LSTM自身が自動的に判断できるようになるのです。

このゲート機構こそが、LSTMの優れた性能の鍵となっています。従来の再帰型ニューラルネットワークでは、長期的な依存関係を学習することが困難でした。しかし、LSTMはゲート機構によって情報を適切に取捨選択することで、長期的な記憶を保持し、より複雑なパターンを学習することが可能になっています。

このように、セルとゲートの巧妙な連携によって、LSTMは高度な情報処理を実現しています。まるで人間の脳のように、必要な情報を記憶し、不要な情報を忘れることで、効率的な学習を可能にしているのです。

情報の保持と更新

コンピュータ上で人間の脳のように情報を処理することを目指した技術に、継続的に情報を処理し更新していく仕組みがあります。この仕組みは、継続誤差学習回路(略して継続学習回路)と呼ばれ、まるで図書館司書のように、情報を整理し、保管し、必要に応じて更新する機能を備えています。継続学習回路は、大きく分けて三つの部分から成り立っています。それは、情報の入り口である入力ゲート、情報の出口である出力ゲート、そして情報を記憶する部屋であるセル状態です。

この継続学習回路が情報を扱う際に鍵となるのが、入力ゲートと忘却ゲートと呼ばれる二つの門です。まず、忘却ゲートは、セル状態に保管されている過去の情報を取捨選択する役割を担います。まるで図書館の書架整理のように、古くなった情報や不要になった情報を整理し、新しい情報のためのスペースを確保します。この忘却ゲートの働きによって、継続学習回路は過去の情報に囚われすぎることなく、変化する状況に対応できる柔軟性を持ちます。

次に、入力ゲートは新しい情報がセル状態に取り込まれる量を調整する役割を担います。図書館に新しい本が運び込まれる際に、全ての本を無条件に受け入れるのではなく、その内容や重要度を評価し、選別するように、入力ゲートは新しい情報がどの程度重要かを判断し、その重要度に応じてセル状態への取り込み量を調整します。

このように、忘却ゲートが古い情報の整理を行い、入力ゲートが新しい情報の取捨選択を行うことで、継続学習回路は限られた記憶容量の中で常に最新の情報を反映した状態を保つことができます。まるで知識豊富な図書館司書のように、継続学習回路は情報を整理し、更新することで、私たちが必要とする情報を的確に提供してくれるのです。

出力ゲートの働き

{中央演算処理装置に保管された情報は、出力ゲートと呼ばれる機構を通して外部へと送られます。}この出力ゲートは、どの情報を、いつ送り出すのかを調整する重要な役割を担っています。中央演算処理装置内には、様々な情報が保管されていますが、全ての情報を常に送り出す必要はありません。状況に応じて、必要な情報だけを選び出し、適切なタイミングで送り出すことで、処理の効率化や正確性を高めることができます。

例えるなら、出力ゲートは、熟練の料理人のような働きをしています。料理人は、たくさんの食材を冷蔵庫に保管しています。しかし、料理を作る際に、全ての食材を使うわけではありません。作る料理に合わせて、必要な食材を、必要な量だけ、必要なタイミングで取り出します。肉を焼く前に冷蔵庫から取り出し、野菜を煮る直前に切るように、タイミングを計ることが重要です。出力ゲートも同様に、中央演算処理装置に保管された情報の中から、必要な情報を選び出し、最適なタイミングで送り出すことで、全体的な処理の効率を高めているのです。

出力ゲートの働きによって、中央演算処理装置は、必要な情報だけを的確に利用することができます。これは、無駄な処理を省き、より速く、より正確な結果を得るために不可欠です。まるで、熟練の料理人が、最高の料理を作り上げるために、食材を厳選し、調理のタイミングを完璧に管理しているように、出力ゲートは、中央演算処理装置が持つ能力を最大限に引き出すために、重要な役割を果たしていると言えるでしょう。

様々な応用

接続時系列誤差(CEC)を備えた長・短期記憶(LSTM)ネットワークは、その優れた能力のおかげで、様々な分野で活躍しています。CECは、LSTMネットワークが長期的な情報をより効果的に扱うことを可能にする重要な技術です。LSTMは、過去の情報を記憶し、現在の情報と組み合わせることで、未来の状態を予測する能力に長けています。このLSTMにCECを組み合わせることで、さらに精度の高い予測が可能になるのです。

音声認識の分野では、CEC搭載LSTMは、音声を認識する際に、過去の音声情報を記憶することで、より正確な認識を実現します。例えば、話し言葉の「えー」や「あのー」といった言い淀みがあっても、文脈を理解し、正確に文字に変換することができます。これにより、音声入力による文字起こしや音声検索の精度が向上し、私たちの生活をより便利にしています。

自然言語処理の分野でも、CEC搭載LSTMは力を発揮します。例えば、機械翻訳では、文章全体の文脈を理解することで、より自然で正確な翻訳を可能にします。また、文章の要約や文章生成など、複雑な言語処理タスクにも活用されています。CECは、LSTMが文章の長期的な依存関係を捉えることを助け、より高度な言語理解を可能にしているのです。

さらに、時系列予測の分野でも、CEC搭載LSTMは重要な役割を担っています。例えば、株価や売上高の予測、天気予報など、過去のデータに基づいて未来の状態を予測する必要があるタスクにおいて、高い精度を実現しています。CECは、LSTMが長期的なトレンドを捉えることを可能にし、より正確な予測を可能にするのです。このように、CEC搭載LSTMは、様々な分野で応用され、私たちの生活をより豊かに、より便利にしています。まるで縁の下の力持ちのように、様々な場面で活躍している、まさに万能選手と言えるでしょう。

| 分野 | CEC搭載LSTMの役割 | 具体例 |

|---|---|---|

| 音声認識 | 過去の音声情報を記憶し、より正確な認識を実現 | 言い淀みがあっても、文脈を理解し正確に文字変換(音声入力による文字起こし、音声検索の精度向上) |

| 自然言語処理 | 文章全体の文脈を理解し、より自然で正確な処理を実現 | 機械翻訳、文章の要約、文章生成など |

| 時系列予測 | 過去のデータに基づいて未来の状態を予測 | 株価や売上高の予測、天気予報など |