二つの情報源を繋ぐ:始点終点注意機構

AIを知りたい

先生、「もとになるものと対象となるものへの注意」ってよく聞くんですけど、どういう意味ですか?

AIエンジニア

良い質問だね。「もとになるものと対象となるものへの注意」とは、翻訳を例に考えると、翻訳前の文章(もとになるもの)と翻訳後の文章(対象となるもの)のそれぞれの単語が、どのように関連しているのかに注意を払う仕組みのことだよ。それぞれの単語がどれくらい影響し合っているかを数値で表すことで、より正確な翻訳ができるようになるんだ。

AIを知りたい

なるほど。でも、なぜ「注意」が必要なんですか?

AIエンジニア

すべての単語が同じように重要とは限らないからだよ。例えば、「私は猫が好きです」を英語に翻訳する場合、「猫」という単語が「cat」に翻訳される際に、「私」や「好き」といった他の単語よりも、「猫」と「cat」の関係に強く注意を払う必要があるよね。そうすることで、より適切な翻訳結果が得られるんだ。

Source-Target Attentionとは。

『もととなる情報』と『対象となる情報』に注目する仕組み、つまり『もと対象注意』について説明します。これは人工知能の分野で使われる用語で、特にトランスフォーマーという仕組みでよく使われます。この仕組みは、質問となる情報と、参照する情報がそれぞれ別の言葉で書かれている場合に、二つの間の関係を理解するために使われます。

二つの情報源を繋ぐ仕組み

二つの情報源を繋ぐ仕組みについて詳しく見ていきましょう。この仕組みは、始点終点注意機構と呼ばれ、異なる二つの情報源を結びつける役割を担います。具体的には、一方の情報源を「始点」、もう一方の情報源を「終点」と捉え、始点の情報に基づいて、終点の情報のどの部分に焦点を当てるべきかを判断する仕組みです。

例として、言葉を別の言葉に変換する作業を想像してみましょう。この場合、変換元の言葉が「始点」、変換先の言葉が「終点」となります。変換元の言葉の一つ一つに着目し、それぞれの言葉に対応する変換先の言葉を探し出す作業を、この仕組みが助けてくれます。例えば、「こんにちは」を英語に変換する場合、「こんにちは」が「始点」であり、「Hello」を含む英文が「終点」となります。この時、「こんにちは」に対応する英語の表現は何かを、始点終点注意機構が判断し、「Hello」に焦点を当てることで、正確な変換を可能にします。

別の例として、絵の内容を言葉で説明する作業を考えてみましょう。この場合、絵が「始点」、説明文が「終点」となります。絵に描かれた様々な要素の中から、説明文で言及すべき重要な要素を、始点終点注意機構が見つけ出します。例えば、絵に猫と木が描かれている場合、説明文が「猫が木に登っています」であれば、猫と木の両方に焦点を当て、それらの関係性を捉えることで、適切な説明文を生成することが可能になります。

このように、始点終点注意機構は、二つの情報源の間の関係性を理解し、重要な情報に焦点を当てることで、様々な作業を効率的かつ正確に行うことを可能にする、強力な道具と言えるでしょう。

注意機構の進化形

注意機構は、情報のどの部分に重きを置くかを自動的に決める仕組みであり、人工知能の分野で広く使われています。例えば、文章を扱う場合、ある単語に注目するとき、文中の他のどの単語との関連が強いかを判断し、重要な単語に大きな重みを与えます。これは、人間の読解と似ています。重要な単語に注目することで、文章全体の理解を深めることができるからです。

従来の注意機構は、一つの情報源、つまり一つの文章や一つの画像などの中で、どの部分に注目するかを決定していました。しかし、始点終点注意機構はこの仕組みをさらに発展させたもので、二つの異なる情報源の間の関係性を捉えることができます。例えば、日本語の文章と英語の文章の対応関係を考えましょう。従来の手法では、それぞれの文章の中で注目すべき単語を見つけるだけでした。しかし、始点終点注意機構では、日本語のある単語が、英語のどの単語に対応しているのかを直接的に捉えることができます。これは、翻訳の精度向上に大きく貢献します。

始点終点注意機構を使うことで、異なる種類の情報源同士の関係性も捉えることができます。例えば、画像と説明文の関係を考えてみましょう。従来の注意機構では、画像の中でどの部分に注目すべきかを決定するだけでしたが、始点終点注意機構では、画像のどの部分が説明文のどの単語に対応しているのかを特定できます。これにより、画像の内容をより正確に理解し、適切な説明文を生成することが可能になります。

このように、始点終点注意機構は、二つの異なる世界を繋ぐ役割を果たします。従来の注意機構が一つの世界の中での関係性を捉えるのに対し、始点終点注意機構は、異なる二つの世界の情報を結びつけることで、より複雑なタスクをこなすことを可能にしました。この技術は、機械翻訳、画像認識、音声処理など、様々な分野で応用され、人工知能の発展に大きく貢献しています。

| 項目 | 説明 | 例 |

|---|---|---|

| 注意機構 | 情報のどの部分に重きを置くかを自動的に決める仕組み。人間の読解と同様に、重要な情報に注目することで全体理解を深める。 | 文章中で、ある単語に着目し、関連性の強い他の単語に重み付けを行う。 |

| 従来の注意機構 | 一つの情報源(文章や画像など)の中で、どの部分に注目するかを決定する。 | 一つの文章内で、どの単語が重要かを判断する。 |

| 始点終点注意機構 | 二つの異なる情報源の間の関係性を捉える。従来の注意機構を拡張し、異なる情報源間の対応関係を把握できる。 | 日本語の文章と英語の文章で、対応する単語同士を結びつける。 画像と説明文で、画像のどの部分が説明文のどの単語に対応するかを特定する。 |

| 始点終点注意機構の利点 | 異なる種類の情報源同士の関係性を捉えることで、翻訳精度向上、画像認識、音声処理など、様々な分野で応用可能。 | 機械翻訳、画像認識、音声処理など |

変圧器モデルとの関係

始点終点注意機構は、近年の深層学習モデルの中でも特に注目を集めている変圧器モデルにおいて、中心的な役割を担う仕組みです。変圧器モデルは、人間の言葉を扱う自然言語処理の分野で目覚ましい成果を上げており、言葉の翻訳や文章の作成など、様々な場面で活用されています。

この変圧器モデルの最も重要な構成要素が、始点終点注意機構です。注意機構は、入力された文章の全ての単語と、出力される文章の全ての単語の関係性を、網羅的に捉えることができます。文章中の各単語は、他の単語との関連性によって意味合いが変化します。例えば「白いご飯」と「白い絵の具」では、「白い」という言葉の意味合いが異なります。始点終点注意機構は、このような文脈に応じた単語の意味の変化を捉えることができるため、より自然で正確な文章の生成を可能にします。

具体的には、始点終点注意機構は、入力文の各単語が、出力文の各単語にどれくらい影響を与えるかを数値化します。この数値は「注意の重み」と呼ばれ、0から1までの値を取ります。注意の重みが大きいほど、その単語間の関連性が強いことを示します。例えば、日本語の「私はご飯を食べます」を英語の「I eat rice」に翻訳する場合、「私」と「I」、「ご飯」と「rice」、「食べます」と「eat」の間の注意の重みが大きくなります。

変圧器モデルは、この始点終点注意機構を用いることで、文脈を考慮した高度な言語理解を実現し、従来のモデルでは難しかった複雑な文章の処理を可能にしました。変圧器モデルの成功は、始点終点注意機構の有効性を示す明確な証拠と言えるでしょう。そして、この機構は今後、様々な自然言語処理技術の発展に大きく貢献していくと考えられます。

| 項目 | 説明 |

|---|---|

| 始点終点注意機構 | 変圧器モデルの中心的な仕組み。入力文の各単語が出力文の各単語にどれくらい影響を与えるかを数値化(注意の重み)することで、文脈に応じた単語の意味の変化を捉える。 |

| 変圧器モデル | 自然言語処理分野で成果を上げている深層学習モデル。言葉の翻訳や文章の作成などに活用される。 |

| 注意の重み | 入力文の単語と出力文の単語間の関連性の強さを示す数値(0~1)。数値が大きいほど関連性が強い。 |

| 効果 | 文脈を考慮した高度な言語理解、複雑な文章の処理が可能になる。 |

| 将来性 | 様々な自然言語処理技術の発展に大きく貢献すると考えられる。 |

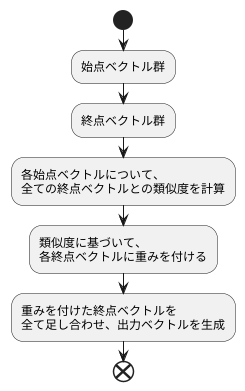

計算の仕組み

計算は、始まりと終わりの二つの点の情報を基に行います。これらの情報は、それぞれ複数の数値を組み合わせたもの(ベクトル)で表されます。

まず、始点のそれぞれのベクトルについて、終点の全てのベクトルとの似ている度合い(類似度)を測ります。この類似度は、二つのベクトルがどれくらい同じ方向を向いているかを数値で示すもので、内積などの計算方法で求めます。

次に、計算した類似度を用いて、終点の各ベクトルに重みをつけます。類似度が高いほど、重みは大きくなります。この重みは、始点のベクトルが終点のどのベクトルに強く注目すべきかを示す重要度のようなものです。

最後に、重みをつけた終点のベクトルを全て足し合わせます。これによって、始点のベクトルに対応する新たなベクトル(出力ベクトル)が作られます。

このようにして、始点の情報に基づいて終点の情報が変化し、二つの情報の間にある関係を捉えることができます。例えるなら、文章の中で特定の単語(始点)が、他のどの単語(終点)と関係が深いかを数値化し、その関係の強さを利用して文章の意味を理解することに似ています。この計算の仕組みは、文章の翻訳や情報の要約など、様々な場面で活用されています。

今後の展望

始点と終点に着目する注意機構は、まだ研究開発の途上にあり、これから様々な発展が期待される技術です。この技術は、文章の特定部分に注目して情報を抽出する際に、始点と終点の関係性を捉えることで、より正確で深い理解を可能にします。

まず、処理速度の向上が重要な課題です。現在の計算方法は、データ量が増えると処理に時間がかかるため、より効率的な計算方法の開発が求められています。例えば、不要な計算を省いたり、計算を並列処理したりする手法が考えられます。これにより、大規模なデータに対しても高速に処理できるようになります。

次に、モデルの改良による表現力の向上も期待されます。複雑な文章や、複数の情報源からなるデータなど、より複雑な関係性を捉えるためには、モデルの構造や学習方法を工夫する必要があります。例えば、文脈情報をより効果的に取り込んだり、異なる種類の情報を統合的に扱うための新たなモデルの開発が進むでしょう。

さらに、応用範囲の拡大も見込まれます。現状では、主に文章を扱う自然言語処理の分野で活用されていますが、画像や音声など、様々な種類の情報を扱うタスクにも応用できる可能性があります。例えば、画像内の物体の関係性を理解する、音声データから重要な情報を抽出するといった応用が考えられます。このように、始点と終点に着目する注意機構は、異なる種類の情報を結びつける強力な道具として、様々な分野で活用されることが期待されます。

これらの発展により、より高度な人工知能の実現に近づくことが期待されます。複雑な情報を理解し、高度な推論を行う人工知能を実現するために、始点と終点に着目する注意機構は重要な役割を果たすと考えられます。

| 課題と展望 | 詳細 |

|---|---|

| 処理速度の向上 | データ量の増加に伴う処理時間の増大に対応するため、効率的な計算方法の開発が必要。例えば、不要な計算の省略や並列処理などが考えられる。 |

| モデルの改良による表現力の向上 | 複雑な文章や複数の情報源に対応できるよう、モデルの構造や学習方法を工夫する必要がある。文脈情報の効果的な活用や、異なる種類の情報の統合的処理などが課題。 |

| 応用範囲の拡大 | 現状は自然言語処理が中心だが、画像や音声など様々な情報処理への応用が期待される。画像内の物体関係の理解や音声データからの重要情報抽出などが例として挙げられる。 |

様々な応用例

始点終点注意機構は、情報を扱う様々な場面で応用され、注目を集めています。特に、言葉を扱う技術においては、その力を発揮する場面が多く見られます。

例えば、言葉を別の言葉に変換する機械翻訳では、この仕組みは、変換元の文章と変換後の文章を結びつける橋渡しのような役割を果たします。変換元の言葉を始点、変換後の言葉を終点として、それぞれの言葉の関係性を細かく分析することで、より自然で正確な変換結果を生み出します。従来の手法では、文全体を均等に扱っていたため、重要な部分とそうでない部分の区別が難しく、誤訳が生じやすいという課題がありました。しかし、始点終点注意機構を用いることで、文脈に応じて重要な箇所に焦点を当てることができるようになり、より高精度な翻訳が可能になりました。

また、長い文章を短くまとめる文章要約の分野でも、この技術は力を発揮します。長い文章を始点、短い要約文を終点として、文章全体の中から重要な情報だけを抜き出すことで、簡潔で分かりやすい要約を作成できます。従来の手法では、単に文の頭の部分など、決まった場所から情報を取り出すことが多かったため、重要な情報が省略されてしまうこともありました。しかし、始点終点注意機構を導入することで、内容を理解した上で重要な部分を見つけ出すことができるようになり、より質の高い要約が作れるようになりました。

さらに、質問に対して適切な回答を返す質問応答システムでも、この技術は重要な役割を担います。質問を始点、回答を終点として、質問の内容に合った的確な回答を生成します。これにより、様々な分野の質問に対して、迅速かつ正確な回答を提供することが可能になります。このように始点終点注意機構は、様々な情報を繋ぎ合わせ、整理することで、多くのタスクを効率化し、私たちの生活をより便利にしてくれる可能性を秘めています。今後、更なる技術の発展と応用範囲の拡大に期待が寄せられています。

| 分野 | 始点 | 終点 | 効果 | 従来手法の課題 |

|---|---|---|---|---|

| 機械翻訳 | 変換元の文章 | 変換後の文章 | より自然で正確な翻訳 | 文全体を均等に扱っていたため、重要な部分とそうでない部分の区別が難しく、誤訳が生じやすい |

| 文章要約 | 長い文章 | 短い要約文 | 簡潔で分かりやすい要約作成 | 決まった場所から情報を取り出すことが多かったため、重要な情報が省略されることもあった |

| 質問応答 | 質問 | 回答 | 質問に合った的確な回答生成 | – |