AIプロジェクトの体制構築

AIを知りたい

先生、「プロジェクト体制の構築」って、ただ人を集めればいいってわけじゃないんですよね?具体的にどんなことを考えないといけないんですか?

AIエンジニア

いい質問だね。プロジェクト体制の構築は、人材を集めるだけでなく、多様な視点を取り入れることが大切なんだ。例えば、人種や性別に偏りがあると、AIがその偏りを学習してしまい、不公平な結果を生み出す可能性がある。アメリカの司法で使われた「COMPAS」というAIが、人種によって再犯率の予測に差が出て問題になったケースもあるんだよ。

AIを知りたい

なるほど、多様な人材を集めることが大切なんですね。他にはどんなことに気をつければいいんですか?

AIエンジニア

そうだね。もう一つ大切なのは、プライバシーへの配慮だ。AIを使う以上、個人情報を取り扱うことになるから、プライバシー保護は非常に重要になる。システムを作る最初の段階からプライバシー対策を組み込む「プライバシー・バイ・デザイン」という考え方がある。後から対策するよりも、最初から考えておくことが大切なんだよ。

プロジェクト体制の構築とは。

人工知能に関わる言葉である「事業の仕組みづくり」について説明します。人工知能を使った事業の仕組みを作る際には、前もって注意しておくべき点があります。まず、人工知能は事業に携わる人たちの偏見の影響を受けやすいので、なるべく人種や性別など様々な人がいるチームを作るのが大切です。実際に、アメリカの裁判で使われた「コンパス」という人工知能は、肌の色が白い人よりもそうでない人の再犯率を高く予想してしまい、問題になりました。また、事業を始めてから個人情報の保護対策をするのではなく、システムを作る段階から個人情報の保護について考えておく「最初から個人情報保護を考えた設計」という考え方も理解しておく必要があります。

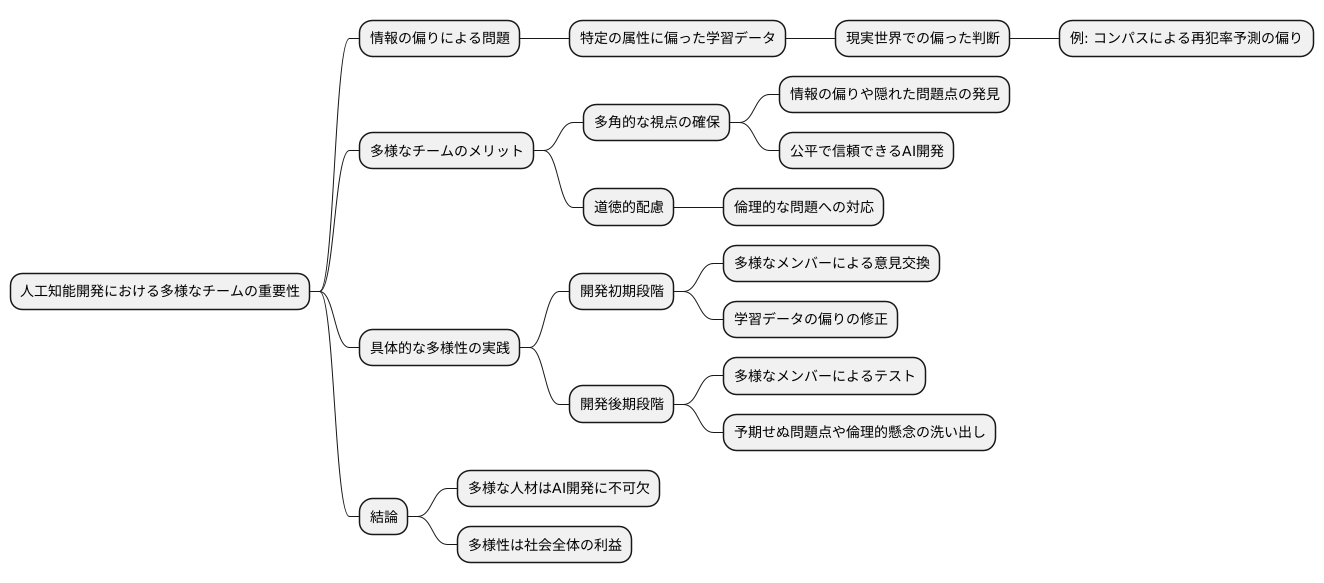

多様な視点を持つチームの重要性

人工知能を作る仕事は、様々な考えを持つ人たちが集まったチームを作ることがとても大切です。なぜなら、人工知能は、学習した情報をもとに考えたり、未来のことを予想したりするからです。もし、学習する情報に偏りがあると、その偏りが人工知能の結果にも出てしまいます。

例えば、特定の肌の色や性別だけに偏った情報で学習させた人工知能は、現実の世界でも同じように偏った判断をするかもしれません。アメリカで使われた「コンパス」という人工知能が、肌の色の濃い人たちの再犯率を高く予想してしまったことは、まさにこの問題点を明らかにしています。

様々な人材を集めたチームを作ることで、色々な角度から情報の偏りや隠れた問題点を見つけ出し、より公平で信頼できる人工知能を作ることができます。性別、肌の色、年齢、育った環境、これまでの経験など、様々な特徴を持つ人たちが集まることで、より多角的な見方ができ、人工知能の正しさだけでなく、道徳的な問題にも気を配ることができます。

具体的には、開発の初期段階で、様々な背景を持つチームメンバーが意見を出し合うことで、学習データに潜む偏りを発見し、修正することができます。また、人工知能が完成に近づいた段階でも、多様な視点を持つメンバーによるテストを行うことで、予期せぬ問題点や倫理的な懸念を洗い出すことができます。これは、人工知能を社会に広く受け入れてもらうためにも重要なプロセスです。

つまり、多様な人材がいることは、人工知能を作る仕事がうまくいくために、なくてはならないものと言えるでしょう。多様性を重視したチーム作りは、より良い人工知能を開発するだけでなく、社会全体の利益にもつながるのです。

偏見を防ぐための対策

人工知能が持つ偏りを防ぐには、様々な背景を持つ人々で開発チームを作るだけでなく、情報の集め方や使い方にも気を配ることが大切です。まず、情報を集める段階では、特定の集団に偏らないように、色々なところから情報を集める必要があります。たとえば、ある特定の地域の人々だけでなく、全国各地の人々の情報や、様々な年齢層の人の情報などを集めることが重要です。もし、集めた情報に偏りがある場合は、それを直す技術もあります。特定の特徴を持つ情報が少ない場合は、その情報を増やす技術や、情報の偏りを補正する方法を使うことで、より公平な学習データを作ることができます。

たとえば、ある画像認識の人工知能を開発するとします。学習データとして、様々な果物の画像を集めるとしましょう。もし、りんごの画像ばかりが多く、みかんの画像が少ない場合、みかんの画像を増やすことで、人工知能はりんごだけでなく、みかんも正しく認識できるようになります。また、りんごの画像の背景が白いものばかりで、みかんの画像の背景が黒いものばかりだとします。この場合、背景の色で果物を判断してしまう可能性があります。このような偏りをなくすために、背景の色を調整したり、様々な背景色の画像を追加するなど、データの偏りを補正する必要があります。

さらに、人工知能が出した結果を定期的に確認し、偏りがないか調べることも欠かせません。人工知能は常に学習を続けるため、使い始めてからも継続的に評価し、必要に応じて修正することで、偏りを最小限に抑えることができます。これは人間と同じです。人間も常に新しいことを学び、経験を通して成長していきます。人工知能も同様に、常に学習し、改善することで、より公平で正確な結果を出せるようになります。そのため、人工知能の出力結果を常に監視し、偏見が生じていないかを確認し続けることが重要です。そして、偏見が発見された場合は、速やかに対応し、修正することで、人工知能が社会にとってより良い存在となるように努める必要があります。

| 対策 | 具体例 |

|---|---|

| 多様な背景を持つ開発チーム | – |

| 多様な情報源から収集 | 全国各地、様々な年齢層 |

| 情報が少ない場合は増やす | みかんの画像が少ない場合は増やす |

| 情報の偏りを補正 | 背景の色を調整、様々な背景色の画像を追加 |

| 出力結果の定期的な確認と修正 | 偏見が生じていないか監視、発見時は修正 |

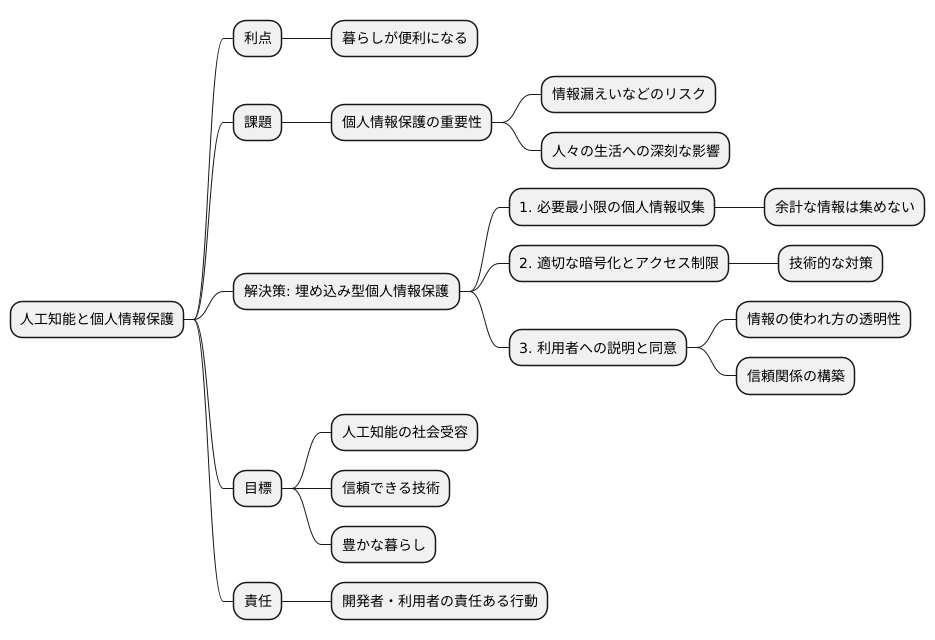

プライバシー保護の重要性

近頃、様々な分野で人工知能の活用が進み、私たちの暮らしはより便利になっています。しかし、人工知能は膨大な量の個人情報を取り扱うため、個人情報の保護は非常に大切な課題です。もし個人情報の保護をないがしろにすれば、情報漏えいなどの重大な問題を引き起こし、人々の生活に深刻な影響を与える可能性があります。だからこそ、人工知能を使った事業を行う際は、最初から個人情報の保護を念頭に置いた設計をすることが重要です。このような考え方を「埋め込み型個人情報保護」と言います。

具体的には、まず集める個人情報の範囲を必要最小限にとどめることが大切です。本当に必要な情報だけを集め、余計な情報は集めないようにすることで、情報漏えいの危険性を減らすことができます。そして、集めた情報は適切な方法で暗号化し、許可された人だけがアクセスできるように制限をかける必要があります。技術的な対策をしっかりと行うことで、情報が悪用されるリスクを減らすことができます。さらに、どのような情報をどのように使うのか利用者に分かりやすく説明し、同意を得ることも大切です。利用者自身が自分の情報の使われ方を理解し、納得した上で利用できるようにすることで、信頼関係を築くことができます。

個人情報の保護は、人工知能が社会に受け入れられ、信頼されるために欠かせない要素です。個人情報の保護を徹底することで、人工知能はより安全で信頼できる技術として、私たちの暮らしをより豊かにしてくれるでしょう。人工知能の開発や利用に携わる人は、常に個人情報の保護を最優先に考え、責任ある行動をとる必要があります。

体制構築のポイント

人工知能を使った事業を成功させるには、しっかりとした組織作りが欠かせません。そのためには、事業の大きさや目標に合わせて、誰がどんな仕事をするのか、責任の範囲はどこまでなのかをはっきりさせることが大切です。

まず、事業全体をまとめる役割の人が必要です。この人は、事業が計画通りに進んでいるか、問題が起こりそうかなどを常に把握し、うまく調整していく役割を担います。

次に、情報を扱う専門家が必要です。この専門家は、必要な情報を集め、整理し、分析して、人工知能が学習するための形にします。また、分析結果からどんなことが分かるのかを分かりやすく説明するのも大切な仕事です。

さらに、人工知能を作る技術者も必要です。この技術者は、専門家が作った情報をもとに、実際に人工知能を作り、動かしていきます。作った人工知能が正しく動くか、問題がないかを常に確認し、改善していくことも重要な仕事です。

人工知能を使う上で、倫理や法律に反することはないか、社会的に問題がないかをチェックする専門家も必要に応じて加わります。様々な視点から意見を取り入れることで、より良い人工知能の活用が可能になります。

これらの役割の人たちがお互いに協力し合い、スムーズに事業を進めていくことが成功の秘訣です。そのためにも、常に新しい知識や技術を学ぶ機会を設けることが大切です。人工知能の技術は日進月歩で進化しているので、常に学び続け、変化に対応できる組織作りが重要です。そうすることで、チーム全体の力を高め、より良い成果を生み出すことができるでしょう。

| 役割 | 主な仕事内容 |

|---|---|

| 事業責任者 | 事業全体の進捗管理、問題発生時の調整 |

| データサイエンティスト | データ収集、整理、分析、AI学習データ作成、分析結果の説明 |

| AIエンジニア | AI開発、運用、監視、改善 |

| 倫理・法務専門家 | 倫理的、法的、社会的問題のチェック |

関係者間の協力

人工知能を扱う事業を成功させるには、開発に携わる仲間内だけでなく、様々な立場の人たちとの協力が欠かせません。関係者とは、例えば情報を提供してくれる人、作った仕組みを使う人、法的な決まりを守る役割の人など、実に様々です。開発チームは、こうした関係者と積極的に話し合い、それぞれの要望や心配事をきちんと理解し、適切な対応をする必要があります。

まず、情報を提供してくれる人に対しては、その情報の使い道や、個人の情報が守られるかといった説明を丁寧に行い、同意を得ることが大切です。情報の提供なくしては事業は成り立ちませんから、信頼関係を築くことが肝要です。次に、作った仕組みを使う人に対しては、使い方や機能に関する説明会を開いたり、資料を用意するなどして、スムーズに使い始められるよう支援が必要です。使い方が分からなければせっかくの仕組みも役に立ちません。さらに、法的な決まりを守る役割の人には、法を守っていることを示す報告を行い、信頼関係を築くことが重要です。法令順守は事業を継続する上で不可欠です。

このように、様々な関係者と良好な協力関係を築くことは、事業を滞りなく進めるためだけでなく、社会全体に受け入れられるためにも非常に大切です。関係者からの意見に耳を傾け、共に協力することで、より良い結果を生み出すことができます。それぞれの立場を理解し、適切な対応を心掛けることで、事業は成功へと近づきます。関係者との協力は、単なる作業ではなく、事業成功の要と言えるでしょう。

| 関係者 | 開発チームの対応 | 目的/重要性 |

|---|---|---|

| 情報を提供してくれる人 | 情報の使い道や個人情報保護の説明、同意の取得 | 信頼関係の構築、事業の基盤 |

| 作った仕組みを使う人 | 使い方の説明会、資料提供、スムーズな利用開始の支援 | 仕組みの有効活用 |

| 法的な決まりを守る役割の人 | 法令順守の報告、信頼関係の構築 | 事業の継続、社会的な信頼 |