AIと報道:世界AI原則を読み解く

AIを知りたい

先生、『世界AI原則』って、何ですか?難しそうです。

AIエンジニア

そうだね、少し難しいけど、簡単に言うと、新聞社やテレビ局などがAIを使う時のルールブックのようなものだよ。AIが記事を勝手に作って、人の作った文章を盗んだり、間違ったことを書いたりしないようにするためのものなんだ。

AIを知りたい

なるほど。どうしてそんなルールが必要なんですか?

AIエンジニア

AIが作った文章が、誰のものか分からなくなったり、間違った情報が広まったりすると、新聞やテレビの信頼が失われてしまうよね。それを防ぐために、AIを使う人たちが守るべきルールとして『世界AI原則』を作ったんだよ。

世界AI原則とは。

人工知能に関係する言葉である『世界人工知能原則』について説明します。これは、世界中の新聞社や報道機関などの26団体が作ったもので、人工知能の発達によって起こる社会的な問題に対処するための指針です。『ChatGPT』のような文章を作る人工知能が、記事の著作権を侵害したり、報道や新聞への信頼を落とすことを心配して作られました。著作権を大切にすること、誰にでもわかるようにすること、責任をしっかり果たすことなど、8つの項目からできています。

原則策定の背景

近ごろ、人工知能(AI)の技術は、とりわけ文章を作るAIの分野で、めざましい発展を見せています。それと並んで、AIが社会全体に与える影響、中でも報道への影響について、心配の声が高まっています。記事の盗用や間違った情報の広がりといった危険性は、報道への信頼を揺るがす重大な問題です。こうした状況を背景に、世界の報道機関やメディア関係の団体が力を合わせ、AI技術の正しい使い方と倫理的な規範を示した指針をまとめました。これが「世界AI原則」です。

この原則が作られたのには、AI技術の急速な進歩に対応する狙いがあります。AIはニュースの収集や情報の分析など、様々な場面で役立つ可能性を秘めています。しかし、同時に、AIの利用によって記事の質が落ちたり、記者の仕事が奪われたりするのではないかといった不安も広がっています。「世界AI原則」は、こうしたAI技術の恩恵とリスクのバランスをどう取るべきか、方向性を示すものです。

もう一つの重要な点は、報道の信頼性を守ることです。AIが作った文章が、まるで人間が書いたかのように広まることで、読者は何が真実なのか分からなくなる恐れがあります。また、AIが特定の意見に偏った情報を作り出すことで、世論が操作される危険性も懸念されています。「世界AI原則」は、AIを利用する際に、情報の正確さや透明性を確保することを重視し、読者の信頼を損なわないようにするための基準を示しています。

「世界AI原則」は、AI技術の発展と報道の健全な発展の両立を目指すための、大きな一歩と言えるでしょう。この原則を基に、報道機関やメディア関係者が協力し、AI時代における報道のあり方を考えていくことが重要です。

| 項目 | 内容 |

|---|---|

| 背景 | AI技術の進歩に伴い、報道への影響(記事の盗用、誤情報拡散など)に対する懸念が高まっている。 |

| 目的 | AI技術の正しい使い方と倫理的な規範を示し、報道の信頼性を守ること。AIの恩恵とリスクのバランスを取る方向性を示す。 |

| 懸念点 | 記事の質の低下、記者の雇用への影響、情報の真偽の判別困難、世論操作の可能性。 |

| 「世界AI原則」の役割 | 情報の正確さや透明性を確保するための基準を示し、読者の信頼を損なわないようにする。AI技術の発展と報道の健全な発展の両立を目指す。 |

| 今後の展望 | 報道機関やメディア関係者が協力し、AI時代における報道のあり方を考えていく必要がある。 |

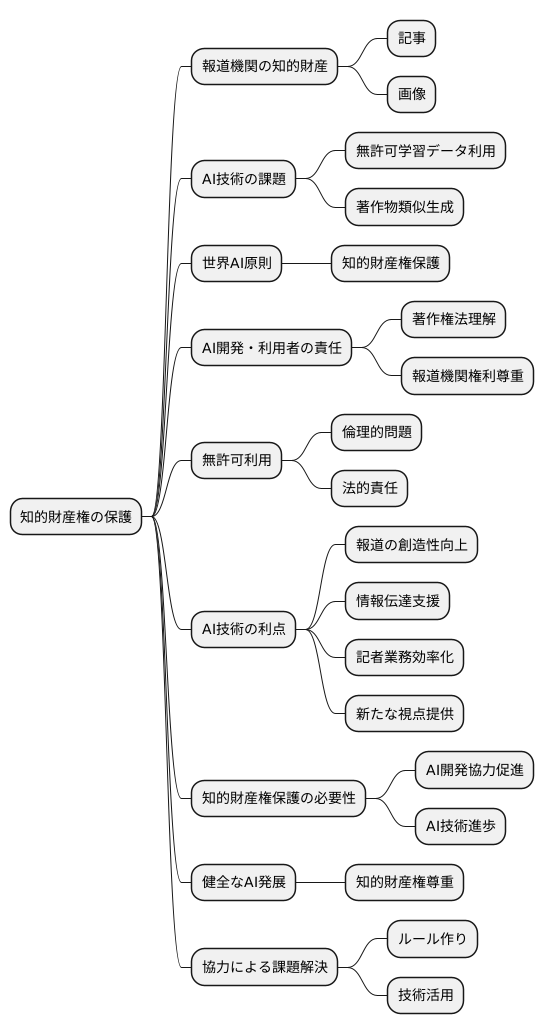

知的財産権の保護

知的財産権は、人の創造的な活動を保護し、新たな創作活動を促すために重要な仕組みです。特に、新聞や雑誌、放送といった報道機関が生み出す記事や画像は、社会に情報を伝え、公正な議論を支える基盤となるため、極めて重要な知的財産と言えます。近年、急速に発展している人工知能(以下、AI)技術は、これらの知的財産を扱う上で新たな課題を生み出しています。

「世界AI原則」では、AI開発や利用において、知的財産権の保護を中核的な要素として位置付けています。これは、AIが報道機関の作った記事や画像を、許可なく学習データとして利用したり、AIが生成した文章や画像が既存の著作物に酷似している場合、著作権侵害となる可能性があるからです。AI開発に携わる人はもちろん、AIを利用する人も、著作権法を正しく理解し、報道機関の権利を尊重する必要があります。無許可で他人の著作物を利用することは、倫理的に問題があるだけでなく、法的にも罰せられる可能性があります。

AI技術は、本来、報道の創造性を高め、より良い情報伝達を支援するためのものです。AIによって、記者は煩雑な作業から解放され、より深い取材や分析に時間を割くことができるようになります。また、AIは膨大なデータから新たな視点を、記事作成のヒントを提供することも可能です。しかし、知的財産権が適切に保護されなければ、報道機関はAI開発に協力することをためらい、AI技術の進歩は阻害されてしまうでしょう。AI技術の健全な発展のためにも、私たちは知的財産権の重要性を改めて認識し、守っていく必要があります。そのためには、AI開発者と報道機関が互いに協力し、著作物の利用に関する明確なルール作りや、新たな技術を活用した著作権保護の仕組み作りを進めていくことが重要です。

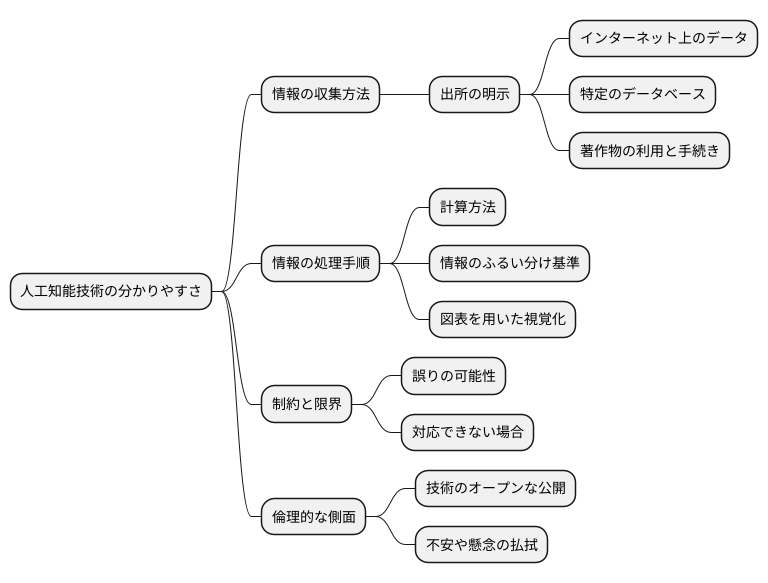

透明性の確保

人工知能技術を用いる上で、分かりやすさを保つことはとても大切です。人工知能がどのように情報を集め、どのように文章を作り上げるのか、その手順をはっきりさせる必要があります。読む側には、人工知能が作った情報がどのように作られたのかを知る権利があります。分かりやすさを高めることで、人工知能技術への理解と信頼を深め、人工知能が作り出す情報の確かさを保証することに繋がります。これは、人工知能技術を報道に役立てる上で、避けて通れない問題です。

人工知能がどのように情報を集めているのか、その出所を明らかにすることは、分かりやすさ確保の第一歩です。インターネット上の膨大なデータから、あるいは特定のデータベースから情報を集めているのか、読者がその出所をたどれるようにする必要があります。もし、著作物など、権利が保護されている情報を利用している場合は、適切な手続きを踏んでいることを示すことも重要です。

次に、人工知能がどのように情報を処理し、文章を作り上げるのか、その手順を分かりやすく説明する必要があります。どのような計算方法を用いているのか、どのような基準で情報をふるい分け、整理しているのか、専門知識がない人にも理解できる言葉で説明することが大切です。図表などを用いて、視覚的に分かりやすく示すことも効果的です。複雑な計算式や専門用語ばかりでは、読者は理解できません。

さらに、人工知能が生成する文章に、どのような制約や限界があるのかを明らかにすることも重要です。人工知能は、まだ完全ではなく、誤りを含む可能性もあります。どのような種類の誤りが起こりやすいのか、どのような場合には対応できないのか、読者にあらかじめ伝えておくことで、誤解を防ぎ、適切な利用に繋げることができます。

分かりやすさを追求することは、単に技術的な問題だけでなく、倫理的な問題でもあります。人工知能技術が社会に広く受け入れられ、信頼されるためには、技術の背後にある仕組みを隠すことなく、オープンに公開していく必要があります。そうすることで、人工知能技術に対する不安や懸念を払拭し、健全な発展に繋げることが期待できます。

説明責任の明確化

人工知能が作り出した情報に誤りがあった場合、誰が責任を持つのか、この点は人工知能を使う上で避けては通れない大切な問題です。人工知能を作った人、人工知能を使った人、あるいはそれ以外の誰かが責任を負うのか、はっきりとした決まりが必要です。責任の所在があいまいなままでは、人工知能という技術が健全に育つことを妨げてしまいます。

人工知能の判断に誤りがあった場合、まず、その人工知能を作った人は、人工知能がどのように考え、どのように答えを出すのかをきちんと説明する責任があります。人工知能を作る過程で、どのような情報を学習させたのか、どのような計算方法を用いたのかを明らかにすることで、誤りがなぜ起こったのかを分析することができます。そして、その分析結果に基づいて人工知能を改良し、より正確な情報を出力できるように努める必要があります。

一方、人工知能を使う人は、人工知能が出した答えを鵜呑みにせず、自分の知識や経験に基づいて、その答えが正しいかどうかを判断する責任があります。人工知能はあくまでも道具であり、最終的な判断は人間が行うべきです。人工知能が出した答えが明らかに間違っている場合や、何かおかしいと感じた場合は、その情報を使うのをやめる勇気が必要です。また、人工知能を使う際には、その人工知能の得意なこと、不得意なことを理解し、適切な場面で使うことが重要です。

責任の所在を明確にすることで、人々は安心して人工知能を使うことができます。安心して使えるようになれば、様々な分野で人工知能の活用が進むでしょう。人工知能が社会にとってより役立つものとなるためには、問題が起きた時に誰がどのように責任を取るのか、社会全体でよく話し合い、明確なルールを作る必要があります。これは、人工知能と共に暮らしていく社会を作る上で、なくてはならない要素です。

| 行為者 | 責任 |

|---|---|

| 人工知能を作った人 |

|

| 人工知能を使った人 |

|

正確な情報発信

人工知能は、多くの情報を処理し、速やかに記事を作成する能力を持っています。インターネット上の膨大なデータから必要な情報を集め、整理して文章にする作業は、人間が行うよりもはるかに効率的です。しかし、人工知能が作り出す情報が、常に正しいとは限りません。人工知能は、学習データに基づいて情報を生成するため、学習データに誤りや偏りがある場合、出力される情報にも同じような問題が生じることがあります。たとえば、特定の人物や団体に関する情報が偏っている場合、人工知能が生成する記事も偏ったものになる可能性があります。また、人工知能は情報の真偽を判断する能力が十分ではないため、誤った情報を事実として伝えてしまう危険性もあります。

誤った情報や偏った考えが広まることは、社会全体に大きな混乱をもたらす可能性があります。人々の判断を誤らせ、社会不安を引き起こすだけでなく、場合によっては差別や偏見を助長することもあります。そのため、報道機関は、人工知能によって作られた情報をそのまま公表するのではなく、必ず内容を確認し、正しい情報を伝える義務があります。人工知能が生成した記事は、一度人の目で確認し、事実関係に誤りがないか、表現に偏りがないかなどを注意深くチェックする必要があります。情報の出典を確認したり、専門家に意見を求めるなど、多角的な視点から検証することが重要です。

人工知能は、あくまでも補助的な道具として使うべきであり、最終的な判断は人間が行う必要があります。人工知能は情報の収集や整理、文章作成といった作業を効率化するための道具であり、それ自体が情報を発信する主体となるべきではありません。人間の知性と経験に基づいた判断こそが、正確で信頼できる報道の基盤となります。人間の知恵と人工知能の技術をうまく組み合わせることで、より質の高い報道を提供することができるでしょう。

| 項目 | 内容 |

|---|---|

| 人工知能の能力 | 多くの情報を処理し、速やかに記事を作成。インターネット上の膨大なデータから必要な情報を集め、整理して文章にする作業は人間より効率的。 |

| 人工知能の問題点 | 学習データに基づいて情報を生成するため、学習データに誤りや偏りがある場合、出力される情報にも同じような問題が生じる。情報の真偽を判断する能力が十分ではないため、誤った情報を事実として伝えてしまう危険性もある。 |

| 人工知能が生成した情報の危険性 | 誤った情報や偏った考えが広まることで、社会全体に大きな混乱をもたらす可能性がある。人々の判断を誤らせ、社会不安を引き起こすだけでなく、差別や偏見を助長することもある。 |

| 報道機関の義務 | 人工知能によって作られた情報をそのまま公表するのではなく、必ず内容を確認し、正しい情報を伝える義務がある。事実関係に誤りがないか、表現に偏りがないかなどを注意深くチェックする必要がある。情報の出典を確認したり、専門家に意見を求めるなど、多角的な視点から検証することが重要。 |

| 人工知能の適切な利用方法 | あくまでも補助的な道具として使い、最終的な判断は人間が行う。情報の収集や整理、文章作成といった作業を効率化するための道具であり、それ自体が情報を発信する主体となるべきではない。人間の知性と経験に基づいた判断こそが、正確で信頼できる報道の基盤。人間の知恵と人工知能の技術をうまく組み合わせることで、より質の高い報道を提供することができる。 |

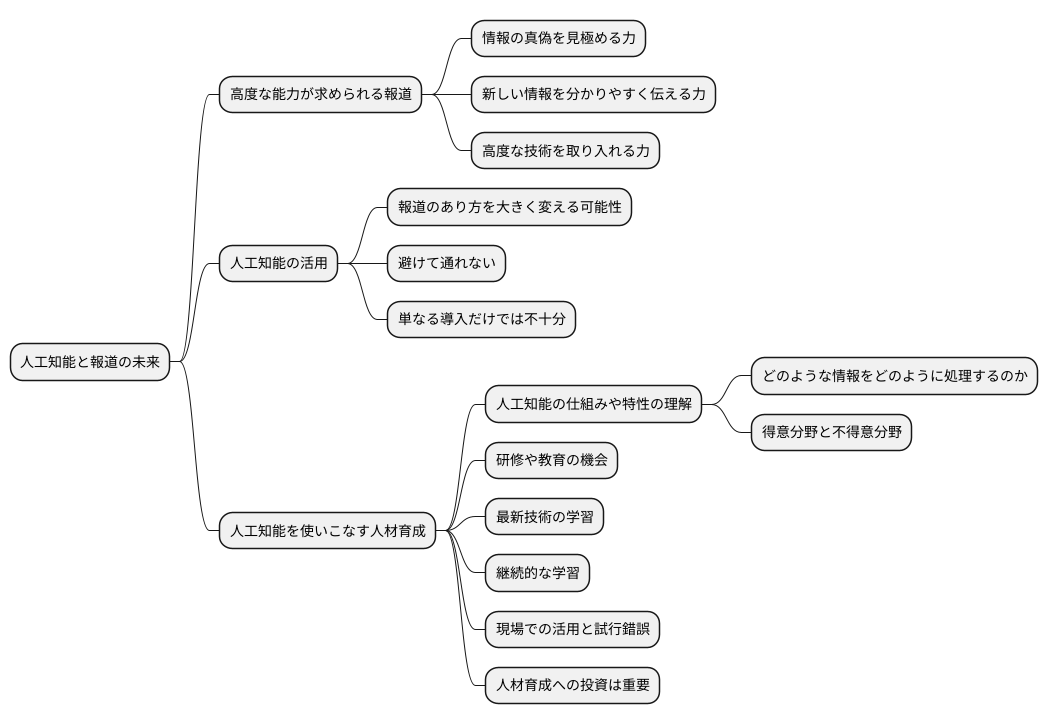

人材育成の必要性

これからの報道には、情報の真偽を見極める力や、新しい情報を分かりやすく伝える力など、これまで以上に高度な能力が求められます。そして、こうした能力を支える重要な柱となるのが、高度な技術を取り入れる力です。特に、人工知能は、報道のあり方そのものを大きく変える可能性を秘めており、その活用はもはや避けて通れないと言えるでしょう。しかし、単に人工知能を導入するだけでは、その真価を発揮することはできません。人工知能を正しく理解し、使いこなせる人材がいなければ、宝の持ち腐れになってしまうのです。

人工知能を報道に役立てるためには、まずその仕組みや特性をしっかりと理解する必要があります。人工知能は万能ではありません。どのような情報をどのように処理するのか、どのような得意分野と不得意分野があるのかを理解することで、初めて効果的に活用できるようになります。報道機関は、人工知能に関する研修や教育の機会を積極的に設け、職員の知識と技能の向上に努めるべきです。

また、人工知能技術は常に進化し続けています。そのため、一度研修を受けただけで満足するのではなく、最新の技術や活用事例を常に学び続ける姿勢が大切です。継続的な学習を通して、人工知能に関する知識や技能を常に最新の状態に保つ必要があります。そして、学んだことを実際に報道現場で活用し、試行錯誤を繰り返しながら、より効果的な活用の方法を探っていくことが重要です。人工知能を使いこなし、その利点を最大限に引き出すためには、人材育成への投資が欠かせません。これは、人工知能時代における報道の未来を切り開く、極めて重要な取り組みと言えるでしょう。