双方向RNN:過去と未来を繋ぐ

AIを知りたい

先生、「両方向あーるえぬえぬ」って、普通の「あーるえぬえぬ」と何が違うんですか?

AIエンジニア

いい質問だね。普通の「あーるえぬえぬ」は、文章を読むときみたいに、前から順番にしか学習できないんだ。でも、「両方向あーるえぬえぬ」は、前からだけでなく、後ろからも同時に学習できるんだよ。

AIを知りたい

後ろからも学習できるって、どういうことですか?

AIエンジニア

例えば、「〇〇はおいしい」という文の時、普通の「あーるえぬえぬ」は「〇〇」まで読んだ段階で「おいしい」を予測するけど、「両方向あーるえぬえぬ」は「おいしい」も知った上で「〇〇」を予測できる。だから、より深く文脈を理解できるんだ。

Bidirectional RNNとは。

人工知能でよく使われる『双方向アールエヌエヌ』という用語について説明します。普通のアールエヌエヌは、過去から未来へという一方向にしか学習できません。しかし、アールエヌエヌを二つ組み合わせることで、未来から過去へという向きにも学習できるようになります。この、両方向に学習できるようになったモデルのことを双方向アールエヌエヌと言います。

双方向RNNとは

繰り返し使える神経組織の仕組み(リカレントニューラルネットワーク、略してRNN)は、時間とともに変化する情報を扱うのが得意な、強力な深層学習の模型です。特に、音声の聞き取りや言葉の処理といった分野で目覚ましい成果を上げています。しかし、普通のRNNは、過去から未来へと一方通行でしか情報を伝えられないという弱点があります。過去の情報をもとに未来を予測するのは得意ですが、未来の情報を使って過去をより深く理解することは苦手です。

そこで登場するのが、双方向RNNです。これは、過去から未来へ進むRNNと、未来から過去へ戻るRNNを組み合わせた、いわば二刀流の仕組みを持っています。両方向からの情報をまとめることで、文脈をより豊かに理解できるようになります。

例えば、文章の中の単語の意味を理解しようとする場面を想像してみてください。普通のRNNは、その単語の前にある単語だけを見て意味を判断します。しかし、人の言葉は複雑で、前にある単語だけでなく、後ろにある単語、さらには文章全体の流れによって意味が変わることがあります。双方向RNNは、単語の前後にある情報だけでなく、文章全体の文脈も考慮に入れるので、より正確な解釈ができます。

このように、双方向RNNは、時間軸の両方向の情報を利用することで、より高度な理解力を発揮します。これは、まるで過去と未来を行き来しながら推理する名探偵のようです。過去の情報だけでなく未来の情報も知ることで、真実にたどり着くことができるのです。

| RNNの種類 | 情報の流れ | 得意なこと | 苦手なこと | 理解力 |

|---|---|---|---|---|

| 普通のRNN | 過去→未来(一方通行) | 過去の情報をもとに未来を予測 | 未来の情報を使って過去をより深く理解すること | 限定的 |

| 双方向RNN | 過去→未来、未来→過去(双方向) | 文脈をより豊かに理解 | – | 高度 |

仕組みと利点

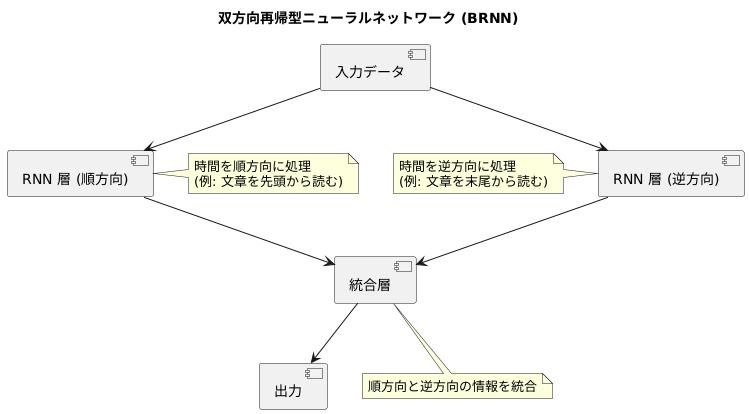

双方向再帰型ニューラルネットワーク(RNN)は、時間を考慮したデータの解析に力を発揮する、深層学習モデルの一種です。その名の通り、二つのRNN層が中心的な役割を果たします。一つ目の層は、データの先頭から末尾へと、時間的な流れに沿って情報を処理します。まるで文章を読むように、一つずつ単語を読み進めていくイメージです。二つ目の層は、一つ目の層とは逆に、データの末尾から先頭へと、時間を遡るように情報を処理します。文章で例えるなら、最後の単語から最初の単語へと逆向きに読むようなものです。

それぞれの層は、各時点のデータと、その直前の時点から受け継いだ情報を組み合わせて、新しい情報を生成します。この処理を繰り返すことで、各時点でのデータとその前後の文脈を捉えることができます。二つの層が別々に処理した情報は、その後、統合層へと送られます。統合層では、過去から未来へ、そして未来から過去への二つの流れの情報が一つにまとめられ、最終的な結果が生成されます。

このように、双方向RNNは、通常のRNNでは捉えきれない、未来の情報を活用できる点が大きな利点です。例えば、音声認識の場面を考えてみましょう。ある音の発音が不明瞭な場合、人間は、その後に続く音から、不明瞭な音が何であったかを推測することができます。双方向RNNも同様に、未来の音の情報を利用することで、より正確に音声を認識することが可能になります。また、機械翻訳では、翻訳対象の文だけでなく、前後の文脈も考慮に入れることで、より自然で正確な翻訳結果を生成することができます。まさに、文脈全体を理解した上での翻訳が可能になるのです。

応用例

双方向回帰型ニューラルネットワークは、様々な分野で活用されています。データの並び順を考慮した解析に優れているため、時系列データの処理が必要な場面で特に力を発揮します。

例えば、言葉を扱う場面では、文章の分類、感情の読み取り、言葉の翻訳といった作業に利用できます。ある製品への感想を分析する場合、文章全体の流れを捉えることで、単に単語の意味だけでなく、書き手の真意を読み解くことができます。「すごいですね」と書いた場合でも、前後の文脈から皮肉を込めた表現だと判断できるのです。言葉の翻訳においても、原文の文脈を理解することで、より自然で正確な訳文を作成できます。

また、音声の認識や合成にも利用できます。音声認識では、周囲の雑音や話し手の癖といった要素を考慮しながら、音声を正確に文字に変換できます。騒がしい場所で録音された音声でも、内容を正しく認識することが可能です。音声合成では、より自然で人間らしい音声を作り出すことができます。抑揚や間合いなどを調整することで、まるで人間が話しているかのような音声を生成できるのです。

このように、双方向回帰型ニューラルネットワークは、時系列データの複雑なパターンを学習し、高度な処理を実現できる技術です。今後、様々な分野での更なる応用が期待されます。

| 分野 | タスク | 詳細 |

|---|---|---|

| 自然言語処理 | 文章分類 | 文章全体の文脈を理解し、正確に分類 |

| 感情分析 | 文脈に基づき、皮肉などのニュアンスも理解 | |

| 機械翻訳 | 原文の文脈を理解し、自然で正確な翻訳 | |

| 音声処理 | 音声認識 | 雑音や話し手の癖を考慮し、音声を文字に変換 |

| 音声合成 | 抑揚や間合いを調整し、人間らしい音声を生成 |

通常のRNNとの比較

通常の再帰型ニューラルネットワーク(RNN)は、過去の情報だけを順番に処理していくことで学習を行います。文章で例えると、左から右へ一文字ずつ読んでいくようなイメージです。そのため、ある時点での予測は、それ以前の情報だけに基づいて行われます。しかし、多くの場合、未来の情報も考慮に入れることで、より正確な予測が可能になります。例えば、「雨」という単語の後に「が降る」という言葉が続くことで、「雨」単独では雨の有無が不明確な場合でも、雨が降ることが確定します。

この、未来の情報も利用できるよう改良されたものが、双方向RNNです。双方向RNNは、通常のRNNとは異なり、過去から未来、そして未来から過去へと、両方向に情報を伝播させる仕組みを持っています。つまり、文章で例えるなら、左から右へ読むと同時に、右から左へも読むようなものです。このように、ある時点の予測を行う際に、その時点の前後両方の情報を利用できるため、より多くの文脈情報を捉えることができます。

特に、時系列データのような、データの順番が重要な意味を持つ場合、双方向RNNは大きな効果を発揮します。例えば、株価の予測では、過去の株価の変動だけでなく、未来の経済指標なども考慮することで、より正確な予測が可能になります。また、音声認識や自然言語処理といった分野でも、前後の文脈を理解することで、より高度な認識や処理が可能になります。このように、双方向RNNは、通常のRNNでは難しかった、長期的な依存関係を捉えることで、様々なタスクにおいて高い性能を発揮します。

| RNNの種類 | 情報の流れ | 特徴 | メリット | 用途例 |

|---|---|---|---|---|

| 通常のRNN | 過去→未来 (左から右) | 過去の情報のみで予測 | – | – |

| 双方向RNN | 過去→未来、未来→過去 (左から右、右から左) | 過去と未来の情報で予測 | より正確な予測、長期的な依存関係を捉えられる | 株価予測、音声認識、自然言語処理 |

実装方法

双方向回帰型ニューラルネットワーク(RNN)は、現在広く使われている深層学習の技術であり、様々なライブラリで手軽に実装できます。例えば、TensorFlowやPyTorchといった代表的なライブラリでは、あらかじめ用意された関数やクラスを利用することで、短いプログラムで双方向RNNを構築できます。これらのライブラリは、計算を効率化する高度な技術や、微分を自動で計算する機能を備えており、学習の効率化やモデル構築を助けます。さらに、これらのライブラリには、使い方を説明した文書や、実際に操作しながら学ぶための教材も豊富に用意されているため、初心者でも比較的容易に使い始めることができます。

これらのライブラリは、画像処理に特化した計算機であるGPUを使った高速計算にも対応しているため、データ量が膨大な場合でも効率的に学習を進めることができます。

実装にあたっては、まず、データの流れが通常の方向である順方向RNNの層と、データの流れが逆方向の逆方向RNNの層をそれぞれ定義します。そして、これら二つの層の出力を組み合わせる層を、解きたい課題に合わせて適切に設定する必要があります。例えば、二つの層の出力を単純に繋げる方法や、それぞれの層の重み付き平均を取る方法などがあります。

さらに、入力データの形式も課題に合わせて調整する必要があります。例えば、文章を扱う場合は、単語を数値で表したベクトル列を入力データとします。画像を扱う場合は、画素の値を数値で表した行列を入力データとします。音声データを扱う場合は、音声信号を数値で表した波形データを入力データとします。

出力データの形式も、同様に課題に合わせて調整する必要があります。例えば、文章の分類を行う場合は、それぞれの分類に対応する確率値を出力とします。文章の生成を行う場合は、単語を数値で表したベクトル列を出力とします。

このように、ライブラリを活用することで双方向RNNの実装は容易になりますが、入力データや出力データの形式、そして順方向と逆方向RNNの層の統合方法などを、解きたい課題に合わせて適切に設定することが重要です。

| 項目 | 説明 |

|---|---|

| 双方向RNN | 順方向RNNと逆方向RNNの層を組み合わせた深層学習技術 |

| ライブラリ | TensorFlow, PyTorchなど。効率的な計算、自動微分、豊富なドキュメントと教材を提供 |

| GPU対応 | 高速計算が可能で、大量データの学習にも対応 |

| 実装手順 | 1. 順方向RNN層と逆方向RNN層を定義 2. 二つの層の出力を組み合わせる層を設定(例: 連結、重み付き平均) 3. 入力データ形式を調整 4. 出力データ形式を調整 |

| 入力データ形式 | 課題による(例: 文章→ベクトル列、画像→数値行列、音声→波形データ) |

| 出力データ形式 | 課題による (例: 分類→確率値、生成→ベクトル列) |

今後の展望

双方向再帰型ニューラルネットワーク(RNN)は、既に様々な分野で目覚ましい成果を上げており、今後ますますの発展と応用が期待されています。時系列データの解析においては、情報の時間的な前後関係を捉えることが重要です。双方向RNNは、過去の情報だけでなく未来の情報も考慮することで、より精度の高い解析を可能にします。

近年注目されているのが、注意機構(アテンションメカニズム)との組み合わせです。注意機構は、入力データのどの部分に注目すべきかを自動的に判断する仕組みです。この仕組みを双方向RNNに組み込むことで、時系列データの中から重要な情報を効率的に抽出することが可能になります。例えば、音声認識において、雑音が多い環境でも特定の音声を正確に認識したり、機械翻訳において、より自然で精度の高い翻訳を実現したりすることが期待されます。

今後の課題としては、学習アルゴリズムの効率化やモデルの軽量化が挙げられます。大規模なデータセットを用いた学習には、膨大な計算資源と時間がかかります。より効率的な学習アルゴリズムを開発することで、計算コストを削減し、学習時間を短縮することができます。また、モデルの軽量化は、スマートフォンや組み込み機器などの限られた計算資源しかない環境でも双方向RNNを利用することを可能にします。これにより、様々な機器への搭載や、リアルタイム処理が必要な用途への応用が期待されます。

他の深層学習モデルとの組み合わせも、今後の発展において重要な要素です。例えば、画像認識技術と組み合わせることで、動画の内容理解や自動運転技術への応用が期待されます。また、自然言語処理技術と組み合わせることで、文章の要約や感情分析など、より高度な言語処理が可能になります。このように、双方向RNNは様々な技術と融合することで、より複雑な問題を解決する可能性を秘めています。今後の研究開発の進展により、双方向RNNは私たちの生活をより豊かに、より便利にする技術として、様々な分野で活躍していくことが期待されます。

| 項目 | 内容 |

|---|---|

| 概要 | 双方向RNNは時系列データ解析に有効であり、過去の情報だけでなく未来の情報も考慮することで、より精度の高い解析を可能にする。 |

| 注意機構との組み合わせ | 入力データのどの部分に注目すべきかを自動的に判断する注意機構を双方向RNNに組み込むことで、時系列データの中から重要な情報を効率的に抽出することが可能になる。音声認識や機械翻訳への応用が期待される。 |

| 今後の課題 | 学習アルゴリズムの効率化、モデルの軽量化。 |

| 他のモデルとの組み合わせ | 画像認識技術との組み合わせ:動画の内容理解、自動運転技術への応用 自然言語処理技術との組み合わせ:文章の要約、感情分析など |