AI悪用への対策とは?

AIを知りたい

先生、「悪用へのセキュリティ対策」って、具体的にどんなことをするんですか?フェイクニュースとか、怖いなあって思います。

AIエンジニア

そうだね、怖いよね。例えば、偽物の動画やニュースを見破る技術を使うんだ。マイクロソフトの作った「動画の真偽を見分ける技術」や、「偽ニュースを見つける技術」みたいなものがあるんだよ。

AIを知りたい

へえー、そんな技術があるんですね。でも、悪用する人もどんどん新しい方法を考えるんじゃないですか?

AIエンジニア

その通り!まさにいたちごっこなんだ。だから、常に新しい情報に気を配り続けることが大切なんだよ。

悪用へのセキュリティ対策とは。

人工知能にまつわる言葉、『悪いことに使われるのを防ぐための対策』について説明します。役に立つ人工知能の技術は、文章を作るものなら嘘のニュース作りに、絵を作るものなら本物そっくりの偽物の動画作りに悪用されることがあります。こうした技術は論文などで広く公開されていることが多く、悪いことに使われるのを前もって防ぐのはほとんど不可能です。ですから、悪用された後どう対応するかが大切になります。マイクロソフト社の『Microsoft Video Authenticator』やSummarizeBotの『Fake News Detection』のように、偽物を見抜く技術の研究が進められており、こうした技術を使うのが効果的です。人工知能の悪用とその対策は、いたちごっこのようになっています。そのため、常に最新の情報を手に入れるように気をつけましょう。

人工知能の悪用事例

近年、技術の進歩によって人工知能は目覚しい発展を遂げ、私たちの生活に様々な恩恵をもたらしています。しかし、その便利な機能や高い能力は、同時に悪用される危険性も抱えています。人工知能が悪用されると、社会に深刻な悪影響を及ぼす可能性があるため、注意が必要です。

例えば、自然な言葉の処理技術を使った高度な文章作成機能を考えてみましょう。この技術は、まるで人間が書いたかのような自然な文章を自動で生成できます。しかし、この機能が悪用されると、真実ではないニュース記事や人々を騙すための情報が簡単に作られてしまうかもしれません。このような偽の情報が拡散されると、社会の混乱を招き、人々の判断を誤らせる危険性があります。

また、画像を作る人工知能も悪用される可能性があります。この技術は、実在しない人物の顔写真や動画を作り出すことができます。いわゆる「ディープフェイク」と呼ばれるものです。この技術が悪意のある人物に使われると、個人の評判を傷つけたり、プライバシーを侵害する深刻な事態を引き起こす可能性があります。さらに、政治的なプロパガンダや詐欺などにも悪用される恐れがあり、社会全体への影響も懸念されます。

これらは人工知能の悪用が社会にもたらす負の影響のほんの一部に過ぎません。人工知能の技術は日々進化しており、悪用の手口も巧妙化していくと予想されます。そのため、悪用を防ぐための対策を早急に講じる必要があります。人工知能の開発者だけでなく、利用者、そして社会全体で協力し、人工知能を安全に利用するためのルール作りや教育を進めていくことが重要です。

| 人工知能技術 | 悪用の例 | 悪影響 |

|---|---|---|

| 高度な文章作成 (自然言語処理) | 偽ニュース記事の作成、詐欺情報の拡散 | 社会の混乱、人々の判断ミス |

| 画像生成AI (ディープフェイク) | 偽の顔写真・動画の作成 | 評判の毀損、プライバシー侵害、政治的プロパガンダ、詐欺 |

公開モデルと悪用の関係

人工知能技術の進歩は目覚ましく、様々な分野で革新をもたらしています。多くの優れた人工知能のひな形は、研究の成果を広く共有し、技術の進歩をより速めることを目指して、論文や誰もが使える形で公開されています。誰でも自由に利用できるということは、技術の進歩を促す一方で、悪用される危険性もはらんでいるのです。

心無い者がこれらの公開されたひな形を不正に利用しようと企んだ場合、その意図を事前に見抜き、対策を立てることは大変困難です。まるで、広大な海に隠された小さな針を探すようなもので、事前に防ぐことは不可能に近いと言えるでしょう。例えば、ある人が画像を作る人工知能を手に入れたとします。その人が何の画像を作るかは、実際に作ってみなければ分かりません。もしかしたら、偽のお札を作るかもしれませんし、他人の顔写真を勝手に加工して、名誉を傷つけるかもしれません。このように、悪意を持った人がどのように人工知能を使うかを予測することは非常に難しいのです。

そのため、悪用される前に防ぐ対策よりも、悪用された後に素早く的確に対応するための対策が重要になります。具体的には、悪用された人工知能で作られた偽の情報を見分ける技術の開発や、被害を受けた人への迅速な支援体制の構築などが挙げられます。また、人工知能の開発者たちは、悪用されにくい仕組み作りを常に心がけ、技術の進歩と安全性の確保の両立を目指していく必要があります。人工知能は使い方次第で大きな力を発揮しますが、その力には責任が伴います。私たちは、人工知能の恩恵を受けながら、同時にそのリスクにも目を向け、適切な対策を講じていく必要があるでしょう。

| 項目 | 内容 |

|---|---|

| 人工知能技術の進歩 | 様々な分野で革新をもたらしている |

| 人工知能のひな形の公開 | 研究成果の共有、技術進歩の促進を目的とする一方、悪用の危険性もはらむ |

| 悪用の事前対策の困難性 | 意図の見抜きや対策が困難。例:画像生成AIの悪用(偽札作成、顔写真の加工など) |

| 事後対策の重要性 | 偽情報を見分ける技術の開発、被害者支援体制の構築など |

| 開発者の責任 | 悪用されにくい仕組み作り、技術の進歩と安全性の確保の両立 |

| まとめ | 人工知能の恩恵とリスクへの対応の必要性 |

悪用対策技術の現状

人工知能は様々な分野で革新をもたらしていますが、同時に悪用される危険性もはらんでいます。悪意ある者によって偽の情報が拡散されたり、個人のプライバシーが侵害される懸念が高まっているため、対策技術の開発が急務となっています。

現在、様々な企業や研究機関が人工知能の悪用に対抗する技術を開発しており、そのいくつかは既に実用化されています。例えば、マイクロソフト社が開発した動画の真偽を確かめる技術は、加工された動画を見破るのに役立ちます。この技術は、動画に含まれるごくわずかな不自然な動きや変化を検知することで、偽造された動画であるかどうかを判断します。特に、人の顔を人工的に作り変えたり、表情を操作する「ディープフェイク」と呼ばれる技術による偽動画の検出に効果を発揮します。

また、誤った情報を流す「偽ニュース」の検出技術も開発が進んでいます。これは、ニュース記事の内容や発信源などを分析することで、情報の信頼性を評価する技術です。大量のデータから学習することで、偽ニュースの特徴を捉え、真偽を判断します。インターネット上に氾濫する情報の真偽を見極める助けとなり、人々が誤った情報に惑わされることを防ぎます。

これらの技術は、人工知能の悪用を防ぎ、安全な利用を促進するために重要な役割を果たすと期待されています。しかし、人工知能技術は常に進化しており、悪用する側も新たな手法を開発し続けることが予想されます。そのため、悪用対策技術も継続的な改良が必要です。人工知能の進化に合わせた対策技術の開発、そして技術の倫理的な側面についての議論も、今後ますます重要になっていくでしょう。

| 対策技術 | 概要 | 対象 |

|---|---|---|

| 動画真偽検証技術 | 動画のわずかな不自然な動きや変化を検知し、偽造の有無を判断 | 加工された動画、ディープフェイク |

| 偽ニュース検出技術 | ニュース記事の内容や発信源を分析し、情報の信頼性を評価 | 偽ニュース |

いたちごっこ対策の重要性

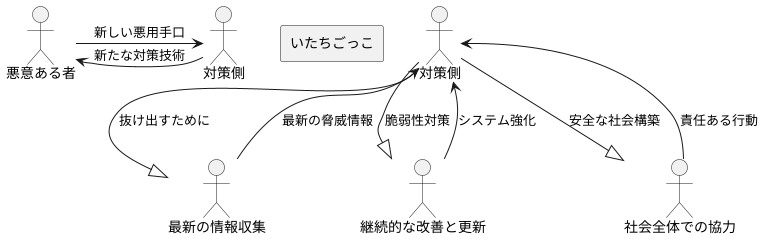

人工知能技術は目覚ましい発展を遂げ、私たちの暮らしを便利で豊かにする可能性を秘めています。しかし、その一方で、この革新的な技術は悪用される危険性も孕んでいるのです。人工知能の悪用とその対策は、まるでいたちごっこのような状況になっています。悪意を持った者は常に新しい手口を考え出し、技術を悪用しようと試みます。一方、対策を行う側は、その悪用に対抗するために、常に新たな技術を開発し続けなければなりません。

このいたちごっこから抜け出すためには、常に最新の情報収集を行うことが非常に重要です。人工知能技術は日々進化しており、それに伴い、悪用の手法も高度化、巧妙化しています。最新の脅威に関する情報を常に把握し、迅速に対応できる体制を整えることで、被害を未然に防ぐことができるのです。具体的には、人工知能技術の動向に関する学会や研究会に参加したり、専門家による講演会やセミナーを受講したりすることで、常に最新の知識を習得することが大切です。また、セキュリティ関連のニュースやウェブサイトなどを定期的にチェックし、新たな脅威に関する情報をいち早く入手することも重要です。

さらに、セキュリティ対策は一度実施すればそれで終わりというものではありません。一度構築したシステムも、時間の経過とともに新たな脆弱性が見つかる可能性があります。そのため、継続的な改善と更新が必要です。システムの脆弱性を定期的に検査し、発見された問題点には迅速な対応が必要です。また、ソフトウェアやシステムを常に最新の状態に保つことも重要です。そして、万が一、人工知能が悪用され、被害が発生した場合には、その原因を徹底的に分析し、再発防止策を講じる必要があります。

人工知能の悪用を防ぐには、社会全体での協力が不可欠です。研究者、開発者、利用者、そして政策立案者など、それぞれの立場において、人工知能技術の健全な発展と安全な利用に向けて、責任ある行動が求められます。私たちは、人工知能技術の光と影を正しく理解し、その恩恵を最大限に享受しながら、潜在的なリスクを最小限に抑える努力を続けなければなりません。いたちごっこから一歩抜け出し、安全で安心な社会を築くためには、継続的な学習と努力が不可欠なのです。

最新情報入手方法

人工知能の悪用に関する新しい情報を得続けることはとても大切です。幸いにも、そうした情報を手に入れる方法はいくつもあります。まず、大学や研究所が出している論文や専門の雑誌を読むという方法があります。これらを読むことで、人工知能の研究がどこまで進んでいるのか、どんな技術が新しく出てきているのかを知ることができます。

次に、安全を守るためのニュースサイトや個人が書いているインターネット上の日記を読むという方法もあります。これらのサイトや日記は、人工知能が悪用されて起こる最新の危険や、そうした危険から身を守る方法について、すぐ知らせてくれます。特に、悪意のある人物が人工知能をどのように使うのか、また、どのような対策があるのかといった具体的な情報が掲載されている場合もあります。

さらに、安全を守るための会合や大きな会議に参加するのも良い方法です。こうした場では、専門家が直接、最新の情報を教えてくれます。他の参加者と話し合うことで、様々な視点から意見を聞き、自分自身の考えを深めることもできます。直接会って話を聞くことで、文章だけでは分かりにくい内容も理解しやすくなります。

これらの方法をうまく組み合わせて使うことで、常に新しい知識を身につけることができます。そして、人工知能が悪用されることに対して、しっかりと準備しておくことができるのです。人工知能は日々進化しているので、常に学び続ける姿勢を持つことが大切です。そうすることで、人工知能の悪用から自分自身を守り、より安全な社会を築くことに貢献できるでしょう。

| 情報源 | メリット | 得られる情報 |

|---|---|---|

| 論文・専門誌 | 人工知能研究の進展状況や最新技術の動向を把握できる | 新技術、研究の進捗状況 |

| ニュースサイト・ブログ | 人工知能悪用の最新危険や対策を迅速に知ることができる。具体的な悪用例や対策情報も得られる場合あり。 | 最新の危険、対策方法、悪用例 |

| 会合・会議 | 専門家から直接最新情報を得られる。他の参加者との議論で多様な視点や理解を深められる。 | 最新情報、多様な視点、専門家の知見 |